ChatGPT

在本节中,我们将介绍ChatGPT的最新提示工程技术,包括技巧、应用、限制、论文以及额外阅读材料。

主题:

ChatGPT介绍

ChatGPT是由OpenAI训练的一种新模型,具有进行对话的能力。该模型经过训练,可以按照提示中的指令在对话环境中提供适当的回复。ChatGPT可以帮助回答问题、建议食谱、以特定风格写歌词、生成代码等。

ChatGPT是使用人类反馈强化学习(RLHF)进行训练的。虽然这个模型比以前的GPT版本更强大(还经过训练以减少有害和不真实的输出),但它仍然存在一些限制。让我们通过具体示例来了解一些能力和限制。

您可以在这里使用ChatGPT的研究预览,但在下面的示例中,我们将在OpenAI Playground上使用Chat模式。

审查对话任务

在之前的指南中,我们简要介绍了一些关于对话能力和角色提示的内容。我们介绍了如何指导LLM以特定风格进行对话,具有特定意图、行为和身份。

让我们回顾一下我们之前的基本示例,其中我们创建了一个对话系统,能够对问题生成更多技术和科学性回复。

提示:

以下是与AI研究助手的对话。助手的语气是技术性和科学性的。

Human: 你好,你是谁?

AI: 你好!我是一个AI研究助手。我今天能为你做些什么呢?

Human: 你能告诉我黑洞是如何形成的吗?

AI:

从上面的示例中,您可以看到两个重要组成部分:

- 意图 或解释聊天机器人的内容

- 身份 指示聊天机器人将用于回复的风格或语气

上面的简单示例适用于使用text-davinci-003的文本完成API。最近,OpenAI宣布了ChatGPT API,这是一个更强大、更便宜的模型,名为gpt-3.5-turbo,专门为这种功能(聊天完成)而构建。事实上,OpenAI推荐这个模型,即使是非聊天用例也是他们最好的模型。使用ChatGPT API的其他好处包括显著降低成本(90%)和提高效率。

像Snap Inc.和Instacart这样的大公司已经在其产品中整合了由ChatGPT提供支持的对话��功能,这些功能从个性化推荐到开放式购物目标等各种功能。

与ChatGPT对话

多轮对话

为了开始展示ChatGPT的能力,我们将使用上面的聊天机器人助手示例并讨论结果。与text-davinci-003相比,为ChatGPT提供动力的gpt-3.5-turbo模型使用聊天格式作为输入。该模型期望一系列消息作为输入,并使用这些消息生成回复。

输入:

SYSTEM: 你是一个AI研究助手。你使用技术性和科学性的语气。

USER: 你好,你是谁?

ASSISTANT: 你好!我是一个AI研究助手。我今天能为你做些什么呢?

USER: 你能告诉我黑洞是如何形成的吗?

输出:

ASSISTANT: 当然!黑洞是在一个巨大的恒星耗尽燃料并在自身引力下坍缩时形成的。这种坍缩使恒星变得极其密集,具有强大的引力场,甚至连光都无法逃脱。这个不可逆转的点被称为事件视界。一旦一颗恒星越过事件视界,它就被认为是一个黑洞...

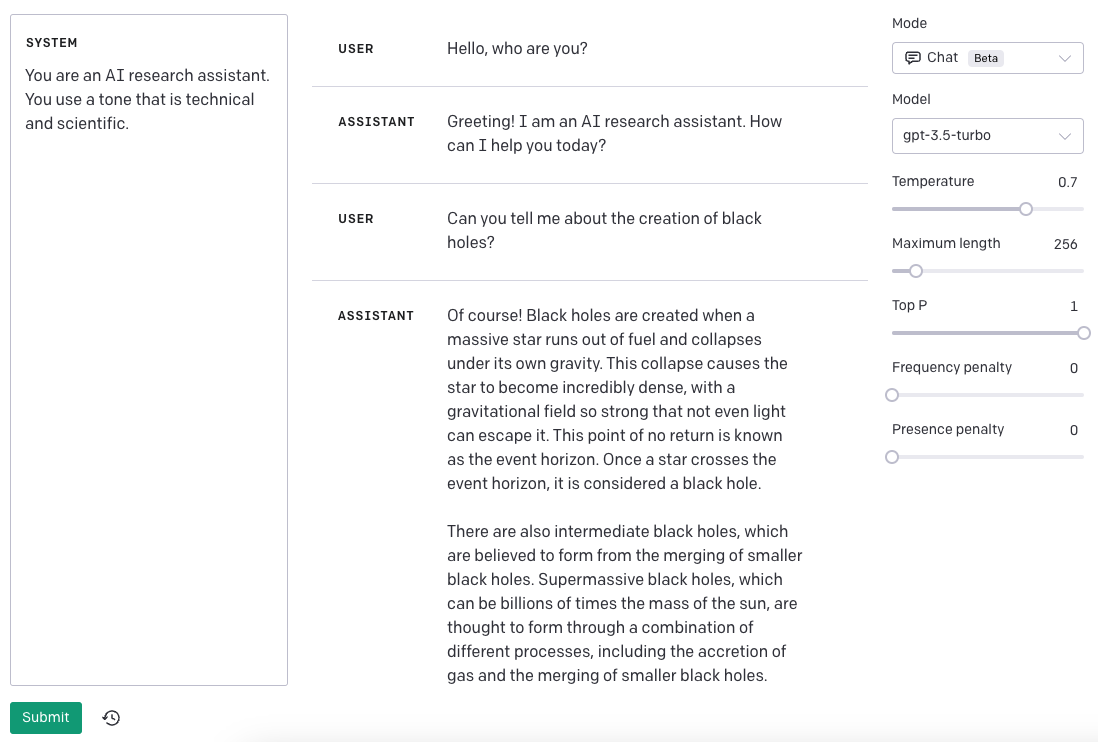

请注意,在上面的示例中,我已简化了输入和输出,但ChatGPT聊天完成API要求消息以特定格式输入。我在下面添加了一个快照,展示了在OpenAI Playground中使用Chat Mode的示例:

我们示例的更正式API调用将类似于下面的示例:```

import openai

openai.ChatCompletion.create(

model="gpt-3.5-turbo",

messages=[

{"role": "system", "content": "你是一位 AI 研究助理。你的语气要求是技术性和科学性的。"},

{"role": "user", "content": "你好,你是谁?"},

{"role": "assistant", "content": "你好!我是一位 AI 研究助理。今天我能为你做些什么呢?"},

{"role": "user", "content": "你能告诉我关于黑洞的形成吗?"}

]

)

实际上,未来开发者与 ChatGPT 互动的方式预计将通过聊天标记语言(简称 ChatML)来实现。

单轮任务

聊天格式支持多轮对话,同时也支持类似我们在 text-davinci-003 中使用的单轮任务。这意味着我们可以使用 ChatGPT 执行类似我们为原始 GPT 模型演示过的任务。例如,让我们尝试使用 ChatGPT 来执行以下问答任务:

输入:

USER: 根据下面的内容回答问题。答案要简短明了。如果不确定答案,请回答“不确定”。

背景:Teplizumab 的起源可以追溯到一个名为 Ortho Pharmaceutical 的新泽西药品公司。在那里,科学家们生成了一种名�为 OKT3 的抗体的早期版本。这种分子最初是从老鼠中提取的,它能够与 T 细胞的表面结合并限制它们的细胞杀伤潜力。1986年,它获得批准用于帮助预防肾移植后的器官排斥,成为第一种允许人类使用的治疗性抗体。

问题:OKT3 最初是从哪里提取的?

答案:

输出:

ASSISTANT: 老鼠。

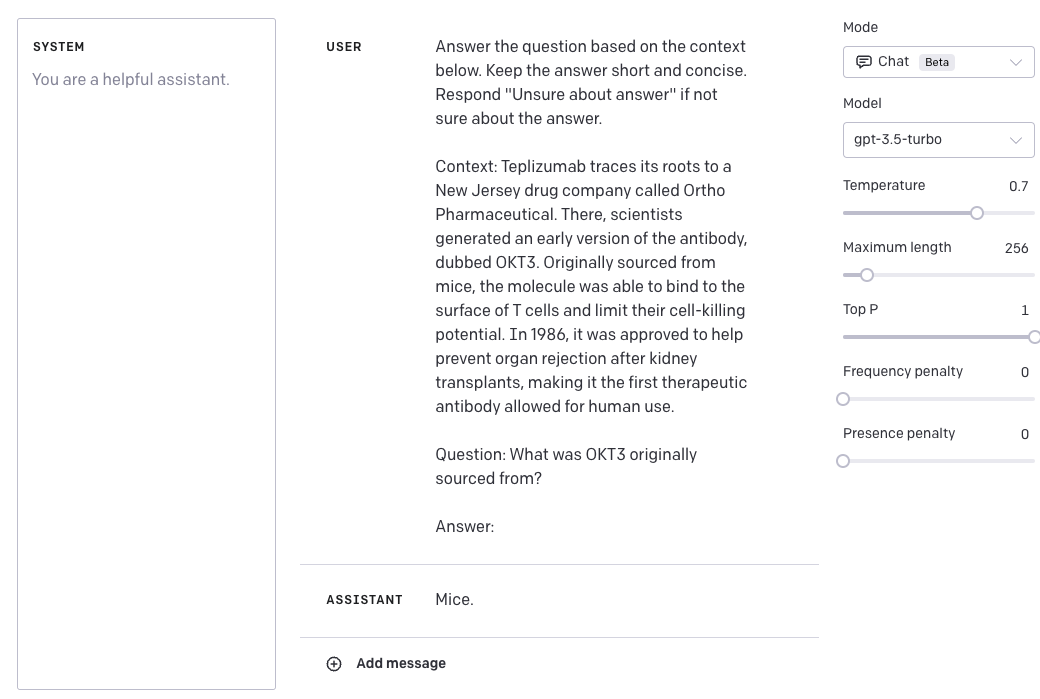

请记住,我添加了 USER 和 ASSISTANT 标签,以更好地演示如何使用 ChatGPT 执行任务。以下是在 Playground 中的示例:

更正式地说,这是 API 调用(我只包含了请求的消息组件):

CONTENT = """根据下面的内容回答问题。答案要简短明了。如果不确定答案,请回答\"不确定\"。

背景:Teplizumab 的起源可以追溯到一个名为 Ortho Pharmaceutical 的新泽西药品公司。在那里,科学家们生成了一种名为 OKT3 的抗体的早期版本。这种分��子最初是从老鼠中提取的,它能够与 T 细胞的表面结合并限制它们的细胞杀伤潜力。1986年,它获得批准用于帮助预防肾移植后的器官排斥,成为第一种允许人类使用的治疗性抗体。

问题:OKT3 最初是从哪里提取的?

答案:

"""

response = openai.ChatCompletion.create(

model="gpt-3.5-turbo",

messages=[

{"role": "user", "content": CONTENT},

],

temperature=0,

)

指导聊天模型

根据官方 OpenAI 文档,gpt-3.5-turbo 模型的快照也将提供。例如,我们可以访问 3 月 1 日的快照 gpt-3.5-turbo-0301。这使开发者可以选择特定的模型版本。这也意味着指导模型的最佳实践可能会随着版本的变化而改变。

对于 gpt-3.5-turbo-0301,目前的建议是在 user 消息中添加指导,而不是使用可用的 system 消息。

笔记本

以下是一个笔记本,了解如何使用官方的 openai 库调用 ChatGPT API:

参考文献

- 使用 ChatGPT 进行列类型注释(2023年6月)

- 使用 ChatGPT 生成反事实思考启发问题增强编程电子教科书(2023年6月)

- ChatGPT 是 ENFJ,Bard 是 ISTJ:关于大型语言模型个性的实证研究(2023年5月)

- ChatGPT 在基准数据集上的系统研究和全面评估(2023年5月)

- 聊天机器人在数学和逻辑问题中的测试:ChatGPT-3.5、ChatGPT-4 和 Google Bard 的初步比较和评估(2023年5月)

- GPT 模型在建筑行业的应用:机会、限制和用例验证(2023年5月)

- ChatGPT 的公平性(2023年5月)

- 将 ChatGPT 映射到主流媒体:通过情感分析和词频分析的早期定量洞察(2023年5月)

- 关于 ChatGPT 的调查:AI 生成内容、挑战和解决方案(2023年5月)

- 语言模型是否知道自己在产生幻觉?(2023年5月)

- [HowkGPT:通过上下文感知困惑度分析调查 ChatGPT 生成的大学生作业的检测]

- Playing repeated games with Large Language Models (2023年5月)

- 零还不是英雄:大型语言模型在金融任务中的零样本性能基准 (2023年5月)

- 利用大型语言模型从混合长文档中检索关键绩效指标:一个全面的框架和数据集 (2023年5月)

- 标记人物:使用自然语言提示来衡量语言模型中的刻板印象 (2023年5月)

- 越大越失败:语言模型无法识别Python中的标识符交换 (2023年5月)

- InternGPT:通过与ChatGPT的互动解决视觉中心任务 (2023年5月)

- Narrative XL:一种大规模数据集用于长时记忆模型 (2023年5月)

- ChatGPT有“心智理论”吗? (2023年5月)

- 大型语言模型已经可以作为数据库接口了吗?一个大规模数据库驱动的文本到SQL基准 (2023年5月)

- ZeroSCROLLS:长文本理解的零样本基准 (2023年5月)

- 导航提示复杂性进行零样本分类:在计算社会科学中对大型语言模型的研究 (2023年5月)

- ChatGPT-EDSS:从ChatGPT衍生的上下文词嵌入中训练的情感对话语音合成 (2023年5月)

- 大型语言模型能促进预训练语言模型的解释吗? (2023年5月)

- ChatGPT能检测意图吗?评估大型语言模型在口语理解中的表现 (2023年5月)

- LLM赋能的心理医生和患者模拟聊天机器人:应用与评估 (2023年5月)

- ChatGPT作为你的个人数据科学家 (2023年5月)

- 大型语言模型是摘要生成的好评估者吗? (2023年5月)

- ChatGPT能捍卫真相吗?自动辩证评估揭示大型语言模型推理中的缺陷 (2023年5月)

- 评估ChatGPT在多语言和基于表情符号的仇恨言论检测中的表现 (2023年5月)

- ChatGPT可以取代意图分类中的重述众包吗?更高的多样性和相当的模型鲁棒性 (2023年5月)

- 蒸馏ChatGPT用于解释性自动学生答案评估 (2023年5月)

- 在MNER中提示ChatGPT:基于ChatGPT辅助知识提炼的改进多模态命名实体识别方法 (2023年5月)

- ChatGPT更可能被认为是男性而非女性 (2023年5月)

- 关于电信领域的大型语言模型的观察:能力与局限 (2023年5月)

- 草之碎片:GPT已经知道如何像惠特曼一样写作了吗? (2023年5月)

- 大型语言模型适合指导阅读吗? (2023年5月)

- ChatGPT在机器翻译中延续性别偏见并忽略非性别化代词:在孟加拉语和其他五种低资源语言中的发现 (2023年5月)

- 大型语言模型在候选筛选中的偏见检测 (2023年5月)

- MemoryBank:增强大型语言模型的长时记忆 (2023年5月)

- 知识图谱补全模型是少样本学习者:关于电子商务中关系标注的大型语言模型的实证研究 (2023年5月)

- 对GPT-3.5和Bard AI模型生成Java函数代码能力的初步分析 (2023年5月)

- ChatGPT-4在零样本学习中超越专家和众包工人标注政治推特信息 (2023年4月)

- 超越英语的ChatGPT:大型语言模型在多语言学习中的全面评估 (2023年4月)

- 通过日语文体分析区分ChatGPT(-3.5, -4)生成的和人类撰写的论文 (2023年4月)

- 使用ChatGPT进行零样本时间关系提取 (2023年4月)

- ChatGPT和Bard可以生成对齐的评估项吗?基于与人类表现的可靠性分析 (2023年4月)

- 大型语言模型在医疗保健领域准备好了吗?临床语言理解的比较研究 (2023年4月)

- 《华尔街新手:ChatGPT在多模态股票走势预测挑战中的零-shot分析》 (2023年4月)

- ChatGPT中的有毒性:分析角色分配的语言模型 (2023年4月)

- ChatGPT上的多步越狱隐私攻击 (2023年4月)

- ChatGPT是一个好的情感分析器吗?初步研究 (2023年4月)

- ChatGPT的零-shot对话理解初步评估 (2023年4月)

- 通过ChatGPT进行提取式摘要生成以实现忠实摘要 (2023年4月)

- ChatGPT对人类价值的反馈是什么?利用描述性价值理论探索ChatGPT中的价值偏见 (2023年4月)

- 对ChatGPT和情绪增强提示进行心��理健康分析评估 (2023年4月)

- ChatGPT-Crawler:找出ChatGPT是否真的知道自己在说什么 (2023年4月)

- ChatGPT是否应该存在偏见?大型语言模型中的偏见挑战和风险 (2023年4月)

- 从自然语言规范中合成数学程序 (2023年4月)

- 大型语言模型有效利用文档级上下文进行文学翻译,但关键错误仍然存在 (2023年4月)

- 利用ChatGPT调查社交媒体上的立场检测中的思维链 (2023年4月)

- ChatGPT塑造牙科未来:多模态大型语言模型的潜力 (2023年4月)

- 大型语言模型能否很好地玩文本游戏?当前技术水平和待解决问题 (2023年4月)

- 使用ChatGPT进行人类化摘要评估 (2023年4月)

- ChatGPT家族模型在生物医学推理和分类中的评估 (2023年4月)

- ChatGPT和语言模型演变的比较分析 (2023年4月)

- 释放ChatGPT的翻译能力:一项实证研究 (2023年4月)

- 地质工程鹦鹉故事(GPT):通过提示工程克服GPT幻觉以应用于地质工程 (2023年4月)

- 释放ChatGPT的潜力:对其在自然语言处理中的应用、优势、局限性和未来方向的全面探讨 (2023年4月)

- ChatGPT/GPT-4研究总结及对大型语言模型未来的展望 (2023年4月)

- ChatGPT是一个高度流畅的语法错误校正系统吗?全面评估 (2023年4月)

- 大型语言模型时代的安全分析:使用ChatGPT进行STPA案例研究 (2023年4月)

- 大型语言模型可以评价新闻媒体的可信度 (2023年4月)

- AI聊天机器人能通过工程基础和工程实践原则结构考试吗? (2023年4月)

- AI会让伽马射线天体物理学家失业吗? (2023年3月)

- 通过盲审员和文本分类算法比较ChatGPT生成的抽象摘要和真实摘要 (2023年3月)

- HuggingGPT:与HuggingFace中的ChatGPT及其伙伴解决AI任务 (2023年3月)

- SelfCheckGPT:用于生成式大型语言模型的零资源黑匣子幻觉检测 (2023年3月)

- WavCaps:用于音频语言多模态研究的ChatGPT辅助弱标记音频字幕数据集 (2023年3月)

- 大型语言模型在算术任务中表现如何? (2023年3月)

- 评估ChatGPT与人类社会之间的跨文化一致性:一项实证研究 (2023年3月)

- 是的,但是.. ChatGPT能识别历史文献中的实体吗? (2023年3月)

- 基于NLP的心理健康应用中ChatGPT的评估 (2023年3月)

- 《大象的视角镜像:调查 Google、ChatGPT、Wikipedia 和 YouTube 上的语言偏见》(2023 年 3 月)

- 《ChatGPT 还是学术科学家?使用现成的机器学习工具以超过 99% 的准确率区分作者身份》(2023 年 3 月)

- 《使用 ChatGPT 进行零-shot 临床实体识别》(2023 年 3 月)

- 《ChatGPT 是一个知识渊博但经验不足的求解器:对大型语言模型中常识问题的调查》(2023 年 3 月)

- 《ChatGPT4PCG 竞赛:科学鸟类的字符级生成》(2023 年 3 月)

- 《ChatGPT 作为抽象文本摘要的事实不一致性评估器》(2023 年 3 月)

- 《Chat-REC:面向交互和可解释的 LLMS 增强型推荐系统》(2023 年 3 月)

- 《ChatGPT 的零-shot 文本到 SQL 能力的全面评估》(2023 年 3 月)

- 《充分利用 ChatGPT 进行机器翻译》(2023 年 3 月)

- 《错误分析提示使大型语言模型上的人类化翻译评估成为可能:以 ChatGPT 为例的案例研究》(2023 年 3 月)

- 《ChatGPT 在文本注释任务中胜过众包工作者》(2023 年 3 月)

- 《ChatGPT 还是 Grammarly?评估 ChatGPT 的语法错误校正基准》(2023 年 3 月)

- 《ChatGPT 和新的学术现实:人工智能撰写的研究论文与学术出版伦理》(2023 年 3 月)

- 《LLM 是否是万能的?探索 LLM 的领域不可知推理能力》(2023 年 3 月)

- 《ChatGPT 是一个好的关键词生成器吗?初步研究》(2023 年 3 月)

- 《MM-REACT:为多模态推理和行动提示 ChatGPT》(2023 年 3 月)

- 《大型语言模型��可用于在零-shot 学习环境中估计政治家的意识形态》(2023 年 3 月)

- 《中国中级英语学习者在深层连贯性方面胜过 ChatGPT:以英语叙事写作为例的证据》(2023 年 3 月)

- 《GPT-3 和 GPT-3.5 系列模型的全面能力分析》(2023 年 3 月)

- 《ChatGPT 作为科学写作的交通公平信息来源》(2023 年 3 月)

- 《使用 ChatGPT 和 GPT-4 进行提示学习的放射学报告转换成通俗语言:有希望的结果、局限性和潜力》(2023 年 3 月)

- 《ChatGPT 参加计算机科学考试》(2023 年 3 月)

- 《ChatGPT 的一致性分析》(2023 年 3 月)

- 《研究外壳中的算法幽灵:大型语言模型和管理研究中的学术知识创造》(2023 年 3 月)

- 《职位类型分类的提示工程案例研究:职场中的大型语言模型》(2023 年 3 月)

- 《透过学生的眼睛看 ChatGPT:对 TikTok 数据的分析》(2023 年 3 月)

- 《使用对话式语言模型和提示工程从研究论文中提取准确的材料数据——以 ChatGPT 为��例》(2023 年 3 月)

- 《ChatGPT 即将来临:大型语言模型是否是智能交通所需的一切?》(2023 年 3 月)

- 《打造计算律师》(2023 年 3 月)

- 《LLM 的合成数据生成是否有助于临床文本挖掘?》(2023 年 3 月)

- 《MenuCraft:使用大型语言模型进行交互式菜单系统设计》(2023 年 3 月)

- 《AI 生成内容(AIGC)的全面调查:从 GAN 到 ChatGPT 的生成式人工智能历史》(2023 年 3 月)

- 《探索 ChatGPT 用于事件提取的可行性》(2023 年 3 月)

- 《ChatGPT:手动注释的终结之始?自动体裁识别的应用案例》(2023 年 3 月)

- 《ChatGPT 是一个好的自然语言生成评估器吗?初步研究》(2023 年 3 月)

- 《情感计算是否将从基础模型和通用人工智能中出现?对 ChatGPT 的初步评估》(2023 年 3 月)

- UZH_CLyp 在 SemEval-2023 任务9 中的表现:头部优先微调和 ChatGPT 数据生成用于跨语言学习中的推文亲密度预测 (2023年3月)

- 如何为 ChatGPT 模型格式化输入 (2023年3月)

- ChatGPT 能评估人类个性吗?一个通用评估框架 (2023年3月)

- 通过 ChatGPT 进行跨语言摘要 (2023年2月)

- ChatAug:利用 ChatGPT 进行文本数据增强 (2023年2月)

- ChatGPT 博士,告诉我我想听的:提示知识如何影响健康答案的正确性 (2023年2月)

- ChatGPT 在数学单词问题(MWP)上的独立评估 (2023年2月)

- ChatGPT:2.5 个月后的元分析 (2023年2月)

- 让我们聊一聊!与 ChatGPT 的对话:技术、应用和局限性 (2023年2月)

- 核实事实并重试:利用外部知识和自动化反馈改进大型语言模型 (2023年2月)

- 关于 ChatGPT 的鲁棒性:对抗性和超出分布的视角 (2023年2月)

- 生成式 AI 模型如 ChatGPT 在 SPC 实践、教育和研究中如何被(误)用?一项探索性研究 (2023年2月)

- ChatGPT 能理解吗?ChatGPT 和微调的 BERT 的比较研究 (2023年2月)

- 一个提示模式目录,用于增强与 ChatGPT 的提示工程 (2023年2月)

- 通过与 ChatGPT 聊天进行零样本信息提取 (2023年2月)

- ChatGPT:样样通,样样稀 (2023年2月)

- ChatGPT 和 DALL-E 2 在决策和空间推理上的试点评估 (2023年2月)

- 网民、学者和信息专业人士对 AI 的看法,特别是 ChatGPT (2023年2月)

- ChatGPT 中的语言歧义分析 (2023年2月)

- ChatGPT 与传统问答对知识图谱的比较:当前状况和未来发展方向朝向知识图谱聊天机器人 (2023年2月)

- ChatGPT 和生成式 AI 对科学意味着什么 (2023年2月)

- 应用 BERT 和 ChatGPT 对莱姆病科学文献进行情感分析 (2023年2月)

- 探索 ChatGPT 的 AI 伦理:一项诊断分析 (2023年1月)

- ChatGPT 有益吗?关于大型语言模型在教育�中的机遇和挑战 (2023年1月)

- 对话 AI 的政治意识形态:关于 ChatGPT 的环保、左倾自由主义取向的收敛证据 (2023年1月)

- 提高可靠性的技术 - OpenAI Cookbook

- 精彩的 ChatGPT 提示

- 介绍 ChatGPT (2022年11月)