Llama 3

最近Meta推出了他们的新一代大型语言模型(LLMs)Llama 3。此次发布包括了预训练和指导调整模型的 80 亿和 700 亿参数。

Llama 3 架构细节

以下是关于 Llama 3 技术细节的摘要:

- 使用标准的仅解码器变压器。

- 词汇量为 128K 个标记。

- 训练序列长度为 8K 个标记。

- 应用了分组查询注意力(GQA)。

- 预训练模型包含超过 15T 个标记。

- 包括后训练,其中包括 SFT、拒绝抽样、PPO 和 DPO 的组合。

性能

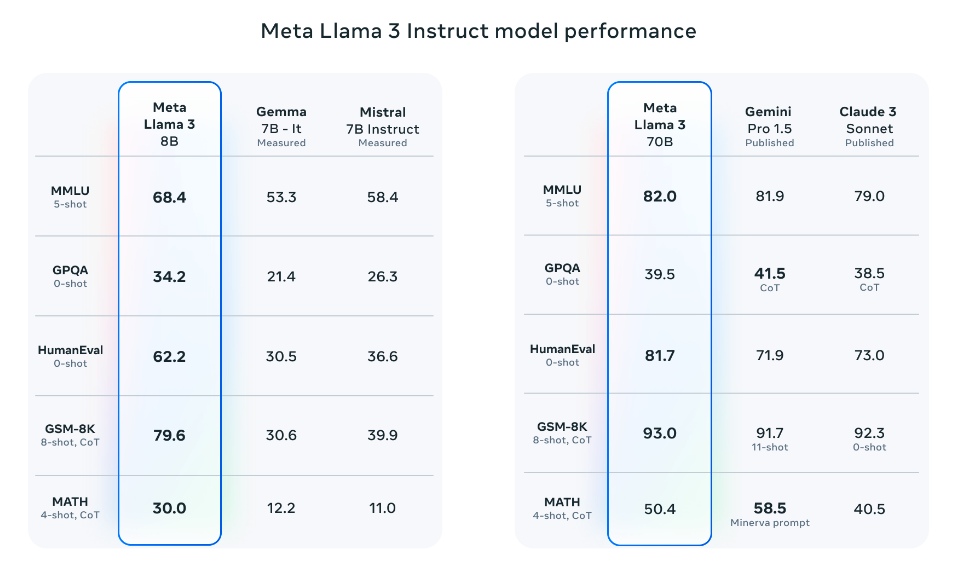

值得注意的是,Llama 3 80 亿(指导调整)的性能优于Gemma 7B和Mistral 7B Instruct。Llama 3 700 在广泛性能上优于Gemini Pro 1.5和Claude 3 Sonnet,但在与 Gemini Pro 1.5 相比的 MATH 基准测试中稍逊一筹。

来源:Meta AI

来源:Meta AI

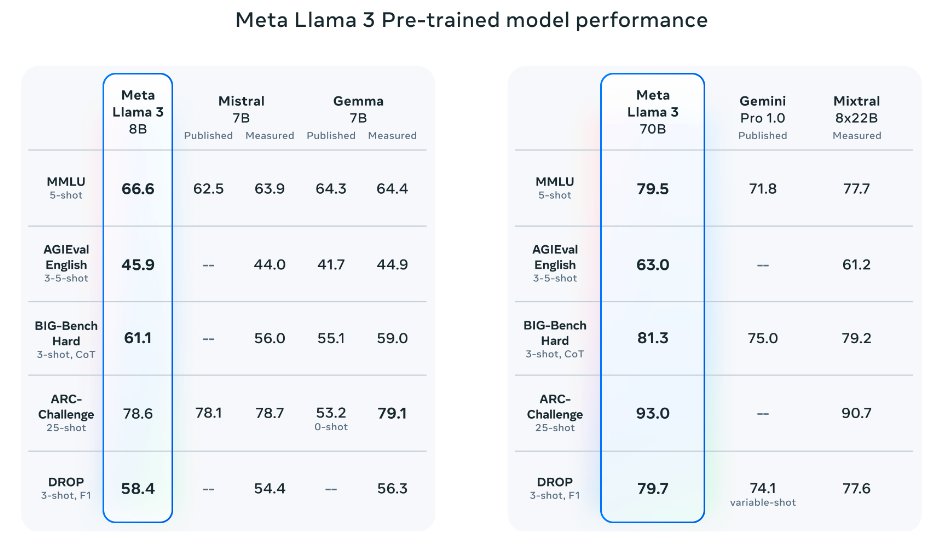

预训练模型还在 AGIEval(英语)、MMLU 和 Big-Bench Hard 等多个基准测试上胜过其他模型。

来源:Meta AI

来源:Meta AI

Llama 3 400B

Meta 还报告称他们将发布一个 400B 参数模型,目前仍在训练中,即将推出!此外,他们还在努力实现多模态支持、多语言能力和更长的上下文窗口。截至 2024 年 4 月 15 日,Llama 3 400B 的当前检查点在 MMLU 和 Big-Bench Hard 等常见基准测试上产生了以下结果:

来源:Meta AI

来源:Meta AI

关于 Llama 3 模型的许可信息可以在模型卡中找到。