scipy.special.pseudo_huber#

- scipy.special.pseudo_huber(delta, r, out=None) = <ufunc 'pseudo_huber'>#

伪Huber损失函数。

\[\mathrm{pseudo\_huber}(\delta, r) = \delta^2 \left( \sqrt{ 1 + \left( \frac{r}{\delta} \right)^2 } - 1 \right)\]- 参数:

- deltaarray_like

输入数组,指示软二次与线性损失的变化点。

- rarray_like

输入数组,可能表示残差。

- 出ndarray,可选

函数结果的可选输出数组

- 返回:

- res标量或ndarray

计算得到的伪Huber损失函数值。

参见

huber与此函数近似的类似功能

注释

像

huber一样,pseudo_huber在统计学或机器学习中经常作为鲁棒损失函数,以减少异常值的影响。与huber不同,pseudo_huber是平滑的。通常,r 表示残差,即模型预测与数据之间的差异。然后,对于 \(|r|\leq\delta\),

pseudo_huber类似于平方误差,而对于 \(|r|>\delta\),它类似于绝对误差。这样,Pseudo-Huber 损失通常在模型拟合中对于小残差(如平方误差损失函数)能够快速收敛,同时仍然减少异常值(\(|r|>\delta\))的影响,类似于绝对误差损失。由于 \(\delta\) 是平方误差和绝对误差机制之间的分界点,因此需要针对每个问题仔细调整。pseudo_huber也是凸的,这使得它适合基于梯度的优化。[1] [2]Added in version 0.15.0.

参考文献

[1]Hartley, Zisserman, “计算机视觉中的多视图几何”。2003年。剑桥大学出版社。第619页

[2]Charbonnier 等人。“计算成像中的确定性边缘保持正则化”。1997年。IEEE图像处理汇刊。6 (2): 298 - 311。

示例

导入所有必要的模块。

>>> import numpy as np >>> from scipy.special import pseudo_huber, huber >>> import matplotlib.pyplot as plt

计算

delta=1在r=2处的函数。>>> pseudo_huber(1., 2.) 1.2360679774997898

通过为 delta 提供一个列表或 NumPy 数组,计算

r=2处的函数在不同 delta 下的值。>>> pseudo_huber([1., 2., 4.], 3.) array([2.16227766, 3.21110255, 4. ])

通过提供一个列表或 NumPy 数组给 r,计算

delta=1在多个点的函数。>>> pseudo_huber(2., np.array([1., 1.5, 3., 4.])) array([0.47213595, 1. , 3.21110255, 4.94427191])

通过为 delta 和 r 提供兼容广播形状的数组,可以计算不同 delta 和 r 的函数。

>>> r = np.array([1., 2.5, 8., 10.]) >>> deltas = np.array([[1.], [5.], [9.]]) >>> print(r.shape, deltas.shape) (4,) (3, 1)

>>> pseudo_huber(deltas, r) array([[ 0.41421356, 1.6925824 , 7.06225775, 9.04987562], [ 0.49509757, 2.95084972, 22.16990566, 30.90169944], [ 0.49846624, 3.06693762, 27.37435121, 40.08261642]])

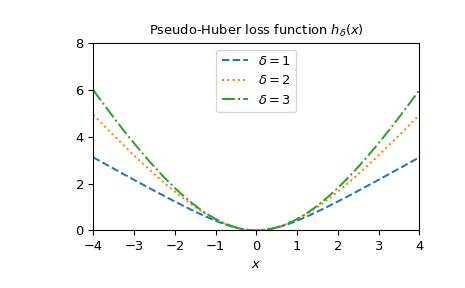

绘制不同 delta 的函数。

>>> x = np.linspace(-4, 4, 500) >>> deltas = [1, 2, 3] >>> linestyles = ["dashed", "dotted", "dashdot"] >>> fig, ax = plt.subplots() >>> combined_plot_parameters = list(zip(deltas, linestyles)) >>> for delta, style in combined_plot_parameters: ... ax.plot(x, pseudo_huber(delta, x), label=rf"$\delta={delta}$", ... ls=style) >>> ax.legend(loc="upper center") >>> ax.set_xlabel("$x$") >>> ax.set_title(r"Pseudo-Huber loss function $h_{\delta}(x)$") >>> ax.set_xlim(-4, 4) >>> ax.set_ylim(0, 8) >>> plt.show()

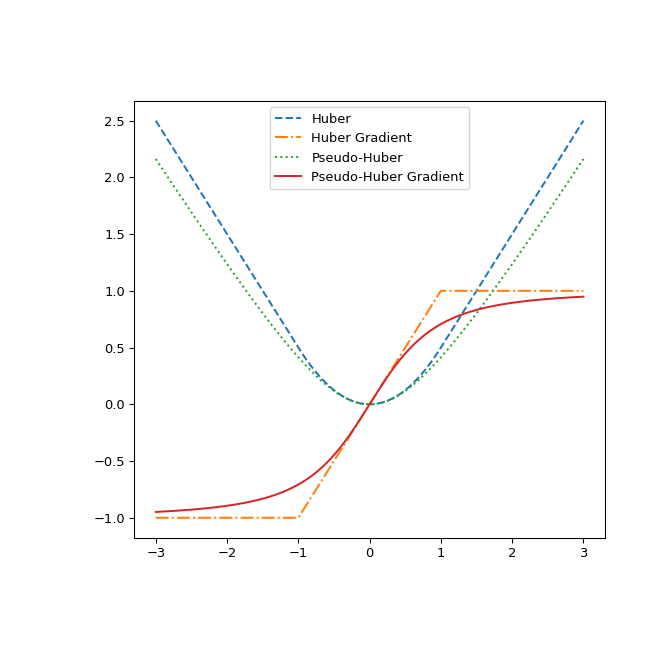

最后,通过绘制

huber和pseudo_huber及其关于 r 的梯度,来说明它们之间的区别。图示显示,pseudo_huber是连续可微的,而huber在点 \(\pm\delta\) 处不是。>>> def huber_grad(delta, x): ... grad = np.copy(x) ... linear_area = np.argwhere(np.abs(x) > delta) ... grad[linear_area]=delta*np.sign(x[linear_area]) ... return grad >>> def pseudo_huber_grad(delta, x): ... return x* (1+(x/delta)**2)**(-0.5) >>> x=np.linspace(-3, 3, 500) >>> delta = 1. >>> fig, ax = plt.subplots(figsize=(7, 7)) >>> ax.plot(x, huber(delta, x), label="Huber", ls="dashed") >>> ax.plot(x, huber_grad(delta, x), label="Huber Gradient", ls="dashdot") >>> ax.plot(x, pseudo_huber(delta, x), label="Pseudo-Huber", ls="dotted") >>> ax.plot(x, pseudo_huber_grad(delta, x), label="Pseudo-Huber Gradient", ... ls="solid") >>> ax.legend(loc="upper center") >>> plt.show()