音频分类 - Jupyter 笔记本

audio_classification_UrbanSound8K.ipynb 示例脚本展示了如何将 ClearML 集成到使用 PyTorch、TensorBoard 和 TorchVision 的 Jupyter Notebook 中,以在 UrbanSound8K 数据集上训练神经网络进行音频分类。该示例在训练和测试过程中调用 TensorBoard 方法来报告标量、音频调试样本和频谱图可视化。频谱图可视化通过调用 Matplotlib 方法绘制。该示例还展示了如何将参数连接到任务并记录它们。当脚本运行时,它会在 Audio Example 项目中创建一个名为 audio classification UrbanSound8K 的实验。

标量

准确率、学习率和训练损失标量会自动记录,同时资源利用率图表(标题为:monitor: machine)也会显示在SCALARS中。

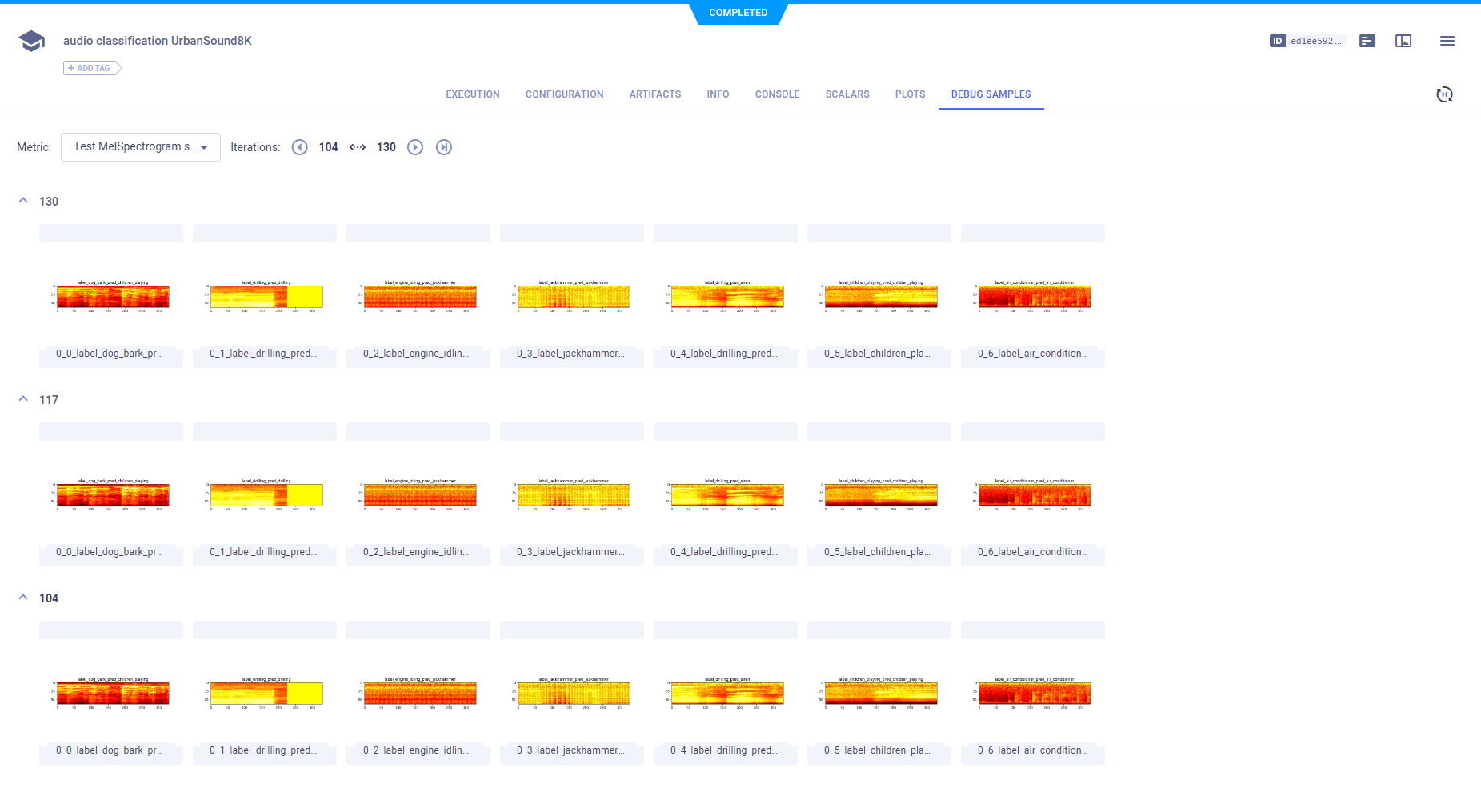

调试示例

音频样本和频谱图会自动记录并显示在DEBUG SAMPLES中。

音频样本

通过双击缩略图,您可以播放音频样本。

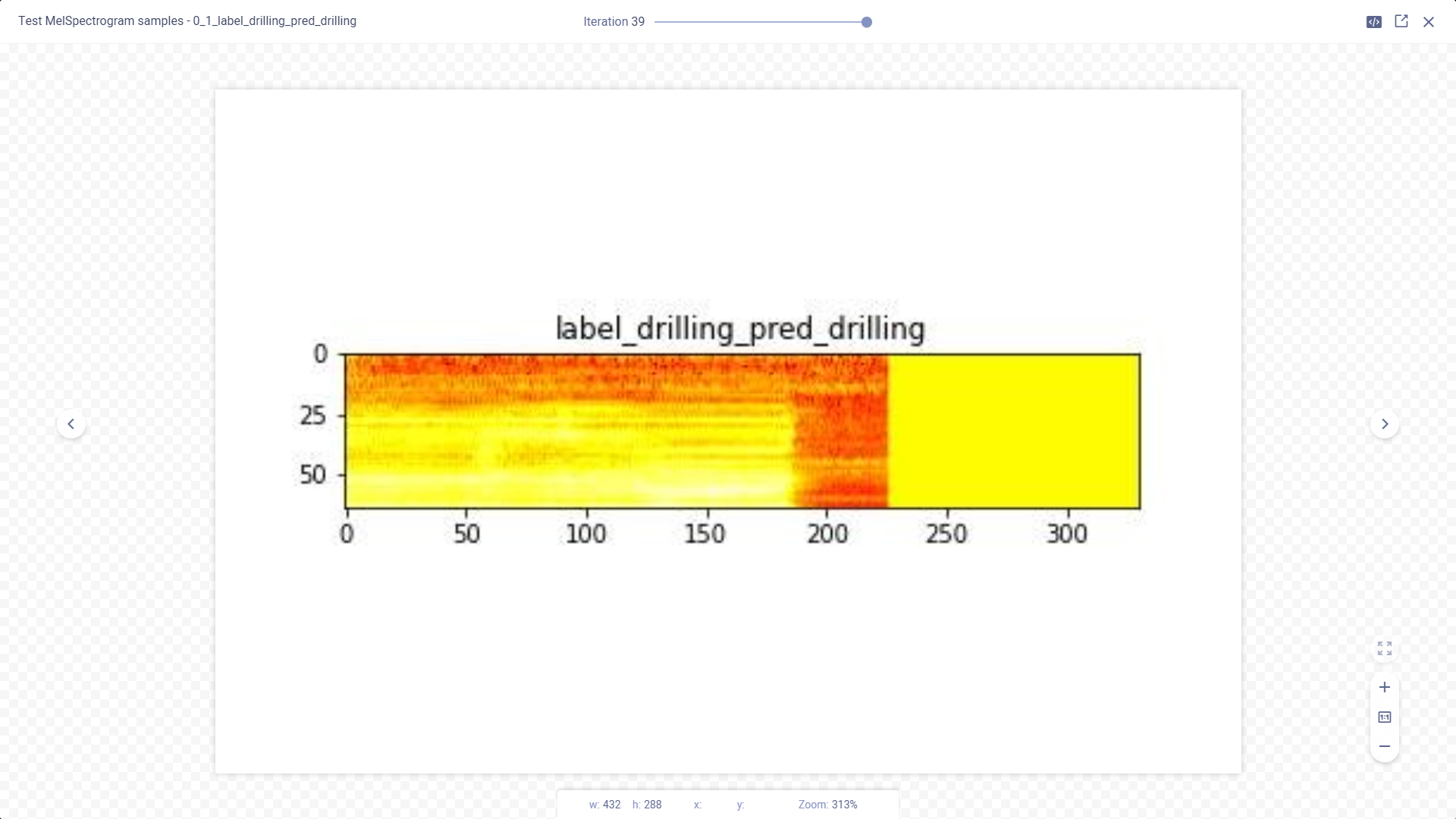

频谱图可视化

通过双击缩略图,您可以在图像查看器中查看频谱图。

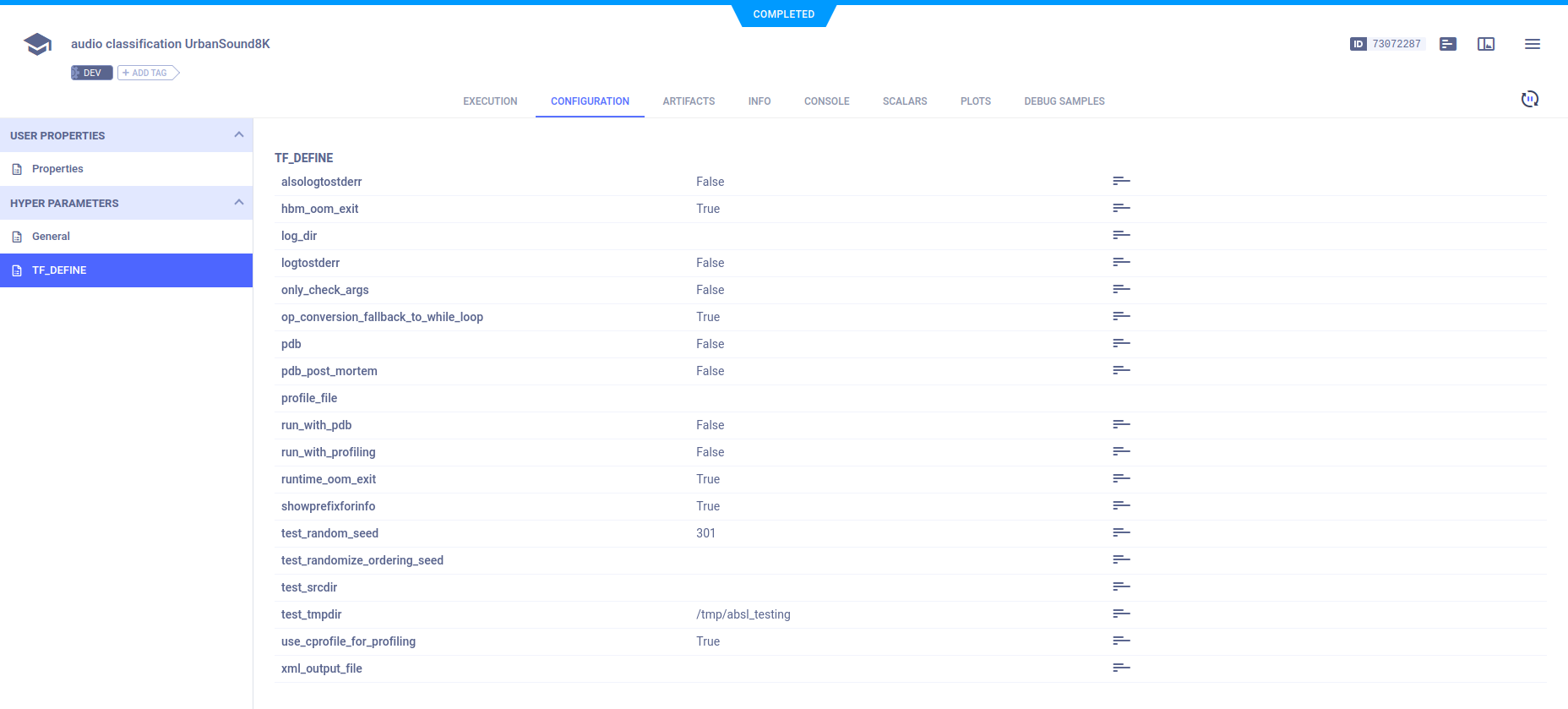

超参数

ClearML 自动记录 TensorFlow 定义。通过调用 Task.connect 方法将参数字典连接到任务来记录它。

configuration_dict = {

'number_of_epochs': 10,

'batch_size': 4,

'dropout': 0.25,

'base_lr': 0.001

}

configuration_dict = task.connect(configuration_dict) # enabling configuration override by clearml

参数字典出现在配置 > 超参数 > 常规中。

TensorFlow 定义出现在 TF_DEFINE 小节中。

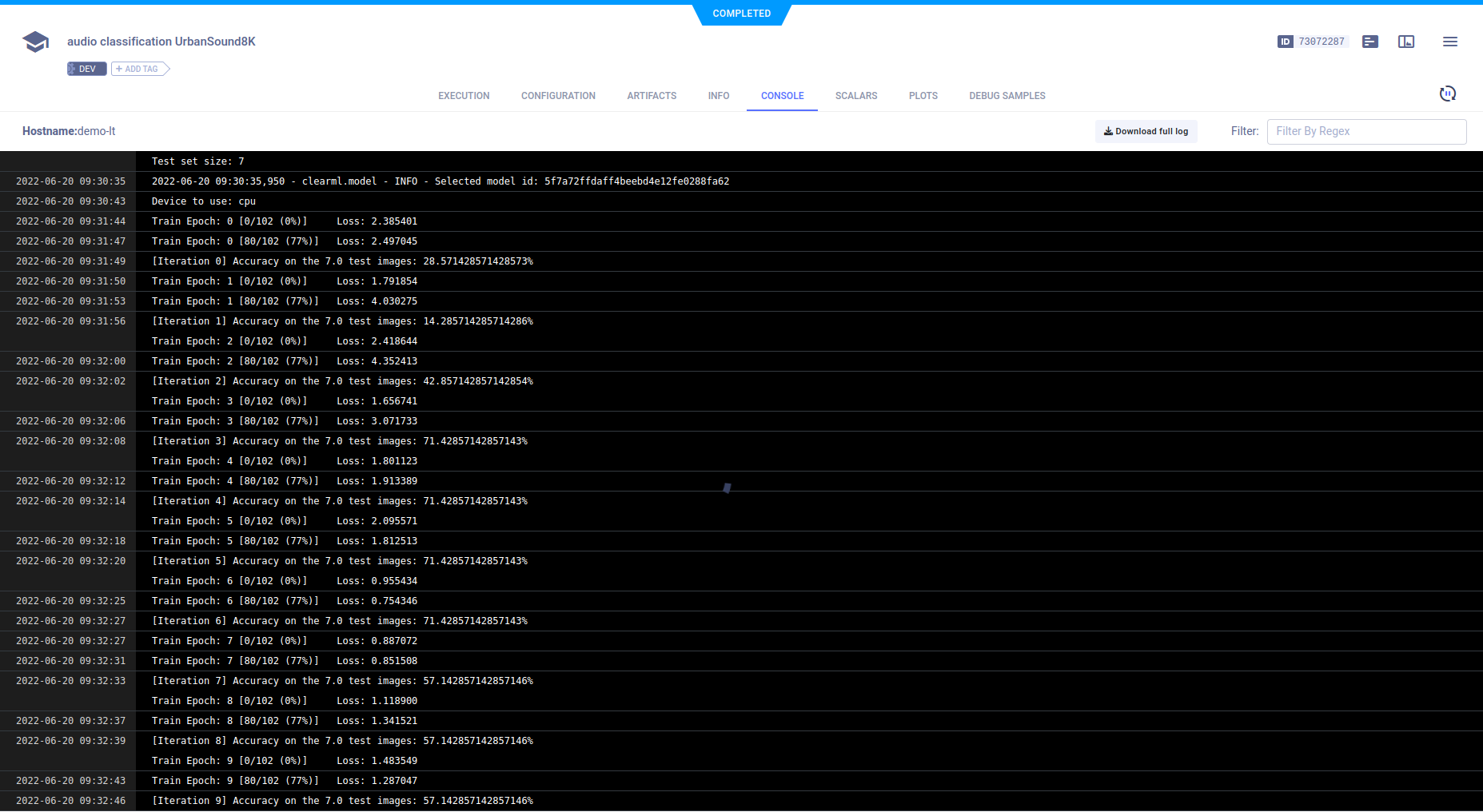

控制台

打印到控制台的训练进度文本,以及所有其他控制台输出,显示在控制台中。