ChatGPT 提示工程

在本节中,我们涵盖了ChatGPT的最新提示工程技术,包括技巧、应用、限制、论文和其他阅读材料。

主题:

ChatGPT 介绍

ChatGPT 是由 OpenAI (在新标签页中打开) 训练的一个新模型,能够以对话方式进行交互。该模型经过训练,能够根据提示中的指令在对话的上下文中提供适当的回应。ChatGPT 可以帮助回答问题、推荐食谱、以特定风格写歌词、生成代码等等。

ChatGPT 是通过人类反馈强化学习(RLHF)进行训练的。虽然这个模型比之前的 GPT 迭代版本能力更强(并且经过训练以减少有害和不真实的输出),但它仍然存在一些局限性。让我们通过具体例子来介绍一些能力和局限性。

你可以在这里使用ChatGPT的研究预览,但在下面的示例中,我们将使用OpenAI Playground上的Chat模式。

回顾对话任务

在之前的指南之一中,我们简要介绍了对话能力和角色提示。我们讨论了如何指导LLM以特定的风格、意图、行为和身份进行对话。

让我们回顾一下之前的基本示例,我们创建了一个能够生成更技术和科学响应的对话系统。

提示:

The following is a conversation with an AI research assistant. The assistant tone is technical and scientific.

Human: Hello, who are you?

AI: Greeting! I am an AI research assistant. How can I help you today?

Human: Can you tell me about the creation of black holes?

AI:从上面的例子中,你可以看到两个重要的组成部分:

- 聊天机器人的意图或解释

- 指示聊天机器人将用于回应的风格或语调的身份

上面的简单示例适用于使用text-davinci-003的文本补全API。最近,OpenAI 宣布了ChatGPT API (在新标签页中打开),这是一个更强大且更便宜的模型,名为gpt-3.5-turbo,专门为此类功能(聊天补全)构建。事实上,OpenAI推荐这是他们最好的模型,即使对于非聊天用例也是如此。使用ChatGPT API的其他好处包括显著的成本降低(90%)和效率提升。

像Snap Inc.和Instacart这样的大公司已经在他们的产品中集成了由ChatGPT驱动的对话功能,这些功能从个性化推荐到开放式购物目标不等。

与ChatGPT的对话

多轮对话

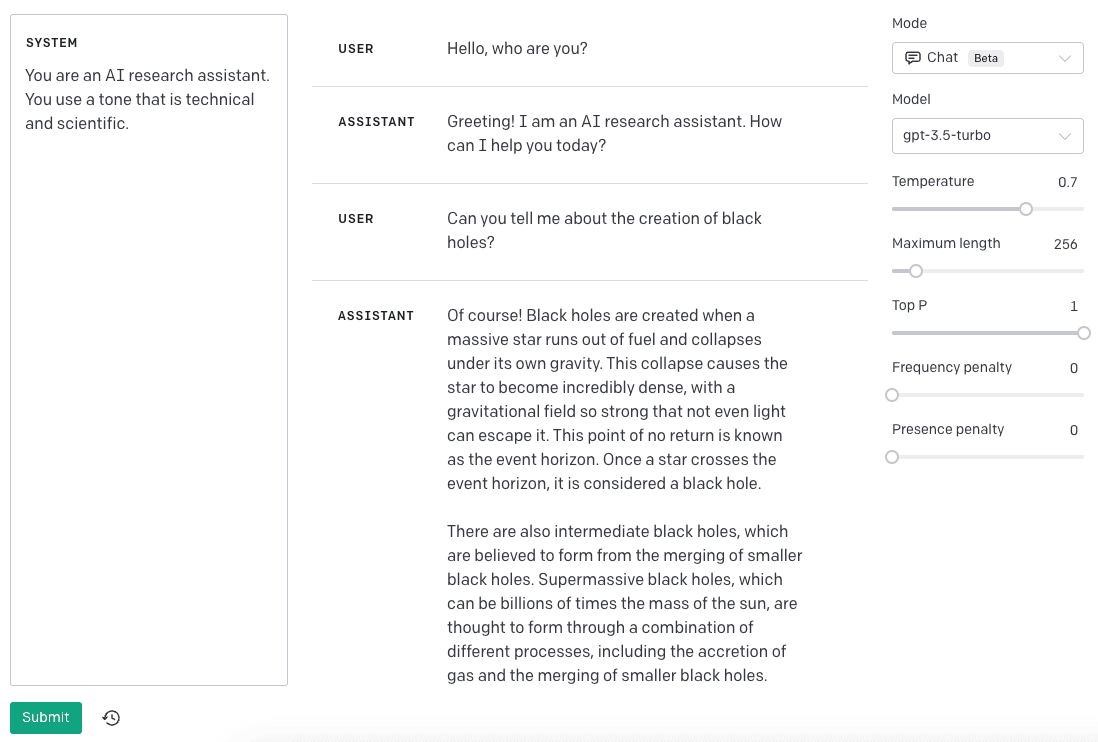

为了开始展示ChatGPT的能力,我们将使用上面的聊天机器人助手示例并讨论结果。与text-davinci-003相比,驱动ChatGPT的gpt-3.5-turbo模型使用聊天格式作为输入。该模型期望一系列消息作为输入,并使用这些消息生成响应。

输入:

SYSTEM: You are an AI research assistant. You use a tone that is technical and scientific.

USER: Hello, who are you?

ASSISTANT: Greeting! I am an AI research assistant. How can I help you today?

USER: Can you tell me about the creation of black holes?输出:

ASSISTANT: Of course! Black holes are created when a massive star runs out of fuel and collapses under its own gravity. This collapse causes the star to become incredibly dense, with a gravitational field so strong that not even light can escape it. This point of no return is known as the event horizon. Once a star crosses the event horizon, it is considered a black hole...请注意,在上面的示例中,我简化了输入和输出,但ChatGPT聊天完成API要求消息必须采用特定格式。我在下面添加了一个快照,展示了在OpenAI Playground中使用Chat Mode时此示例的样子:

对于我们示例的更正式的API调用将如下所示:

import openai

openai.ChatCompletion.create(

model="gpt-3.5-turbo",

messages=[

{"role": "system", "content": "You are an AI research assistant. You use a tone that is technical and scientific."},

{"role": "user", "content": "Hello, who are you?"},

{"role": "assistant", "content": "Greeting! I am an AI research assistant. How can I help you today?"},

{"role": "user", "content": "Can you tell me about the creation of black holes?"}

]

)事实上,未来开发者与ChatGPT的交互方式预计将通过Chat Markup Language (在新标签页中打开)(简称ChatML)来完成。

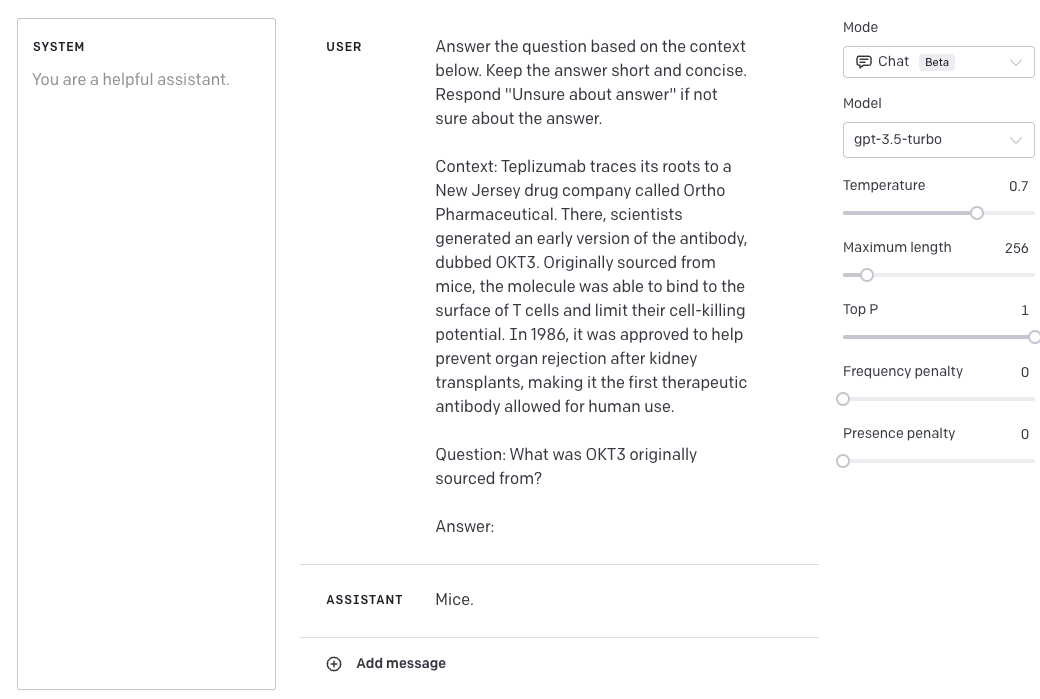

单轮任务

聊天格式支持多轮对话,但也支持类似于我们使用text-davinci-003时的单轮任务。这意味着我们可以使用ChatGPT来执行类似于我们为原始GPT模型展示的任务。例如,让我们尝试使用ChatGPT执行以下问答任务:

输入:

USER: Answer the question based on the context below. Keep the answer short and concise. Respond "Unsure about answer" if not sure about the answer.

Context: Teplizumab traces its roots to a New Jersey drug company called Ortho Pharmaceutical. There, scientists generated an early version of the antibody, dubbed OKT3. Originally sourced from mice, the molecule was able to bind to the surface of T cells and limit their cell-killing potential. In 1986, it was approved to help prevent organ rejection after kidney transplants, making it the first therapeutic antibody allowed for human use.

Question: What was OKT3 originally sourced from?

Answer:输出:

ASSISTANT: Mice.请记住,我正在添加USER和ASSISTANT标签,以更好地展示如何使用ChatGPT执行任务。以下是使用Playground的示例:

更正式地说,这是API调用(我只包含了请求的消息部分):

CONTENT = """Answer the question based on the context below. Keep the answer short and concise. Respond \"Unsure about answer\" if not sure about the answer.

Context: Teplizumab traces its roots to a New Jersey drug company called Ortho Pharmaceutical. There, scientists generated an early version of the antibody, dubbed OKT3. Originally sourced from mice, the molecule was able to bind to the surface of T cells and limit their cell-killing potential. In 1986, it was approved to help prevent organ rejection after kidney transplants, making it the first therapeutic antibody allowed for human use.

Question: What was OKT3 originally sourced from?

Answer:

"""

response = openai.ChatCompletion.create(

model="gpt-3.5-turbo",

messages=[

{"role": "user", "content": CONTENT},

],

temperature=0,

)指导聊天模型

根据OpenAI官方文档,gpt-3.5-turbo模型的快照也将可用。例如,我们可以访问3月1日的快照gpt-3.5-turbo-0301。这使得开发者可以选择特定的模型版本。这也意味着指导模型的最佳实践可能会因版本而异。

当前对于gpt-3.5-turbo-0301的建议是在user消息中添加指令,而不是在可用的system消息中添加。

笔记本

这里有一个笔记本,可以了解更多关于如何使用官方的openai库调用ChatGPT API的信息:

参考文献

- 使用ChatGPT进行列类型注释 (在新标签页中打开) (2023年6月)

- 使用ChatGPT生成的逆向思维启发问题增强编程电子教科书 (在新标签页中打开) (2023年6月)

- ChatGPT 是 ENFJ,Bard 是 ISTJ:大型语言模型个性的实证研究 (在新标签页中打开) (2023年5月)

- ChatGPT在基准数据集上的系统研究和综合评估 (在新标签页中打开) (2023年5月)

- 聊天机器人在数学和逻辑问题中的测试:ChatGPT-3.5、ChatGPT-4和Google Bard的初步比较与评估 (在新标签页中打开) (2023年5月)

- GPT模型在建筑行业中的应用:机遇、限制及一个使用案例验证 (在新标签页中打开) (2023年5月)

- ChatGPT的公平性 (在新标签页中打开) (2023年5月)

- 主流媒体中的ChatGPT映射:通过情感分析和词频分析的早期定量洞察 (在新标签页中打开) (2023年5月)

- 关于ChatGPT的调查:AI生成内容、挑战与解决方案 (在新标签页中打开) (2023年5月)

- 语言模型知道它们何时在幻觉引用吗? (在新标签页中打开) (2023年5月)

- [HowkGPT: 通过上下文感知的困惑度分析检测ChatGPT生成的大学生作业]

- 与大型语言模型玩重复游戏 (在新标签页中打开) (2023年5月)

- 零还不是英雄:评估LLMs在金融任务中的零样本性能 (在新标签页中打开) (2023年5月)

- 利用LLMs从混合长文档中检索KPI:一个全面的框架和数据集 (在新标签页中打开) (2023年5月)

- 标记人物:使用自然语言提示测量语言模型中的刻板印象 (在新标签页中打开) (2023年5月)

- 越大越容易失败:语言模型无法识别Python中的标识符交换 (在新标签页中打开) (2023年5月)

- InternGPT: 通过与ChatGPT互动超越语言解决视觉中心任务 (在新标签页中打开) (2023年5月)

- Narrative XL: 一个用于长期记忆模型的大规模数据集 (在新标签页中打开) (2023年5月)

- ChatGPT 是否具备心智理论? (在新标签页中打开) (2023年5月)

- LLM 是否已经可以作为数据库接口?一个用于大规模数据库的文本到SQL的大型基准 (在新标签页中打开) (2023年5月)

- ZeroSCROLLS: 长文本理解的零样本基准 (在新标签页中打开) (2023年5月)

- 导航提示复杂性以实现零样本分类:计算社会科学中的大型语言模型研究 (在新标签页中打开) (2023年5月)

- ChatGPT-EDSS: 基于ChatGPT上下文词嵌入训练的共情对话语音合成 (在新标签页中打开) (2023年5月)

- LLMs 能否促进预训练语言模型的解释? (在新标签页中打开) (2023年5月)

- ChatGPT 能否检测意图?评估大型语言模型在口语理解中的应用 (在新标签页中打开) (2023年5月)

- LLM-empowered Chatbots for Psychiatrist and Patient Simulation: Application and Evaluation (在新标签页中打开) (2023年5月)

- ChatGPT 作为您的个人数据科学家 (在新标签页中打开) (2023年5月)

- 大型语言模型是否适合作为抽象摘要的评估者? (在新标签页中打开) (2023年5月)

- ChatGPT能捍卫真理吗?自动辩证评估揭示了LLMs在推理中的不足 (在新标签页中打开) (2023年5月)

- 评估ChatGPT在多语言和基于表情符号的仇恨言论检测中的表现 (在新标签页中打开) (2023年5月)

- ChatGPT 替代众包改写用于意图分类:更高的多样性和可比的模型鲁棒性 (在新标签页中打开) (2023年5月)

- Distilling ChatGPT for Explainable Automated Student Answer Assessment (在新标签页中打开) (2023年5月)

- Prompt ChatGPT In MNER: 基于ChatGPT辅助精炼知识的改进多模态命名实体识别方法 (在新标签页中打开) (2023年5月)

- ChatGPT 更可能被视为男性而非女性 (在新标签页中打开) (2023年5月)

- 关于电信领域大语言模型的观察:能力与限制 (在新标签页中打开) (2023年5月)

- Bits of Grass: GPT 是否已经知道如何像惠特曼那样写作? (在新标签页中打开) (2023年5月)

- 大型语言模型适合用于引导阅读吗? (在新标签页中打开) (2023年5月)

- ChatGPT 在机器翻译中延续性别偏见并忽略非性别代词:在孟加拉语和其他五种低资源语言中的发现 (在新标签页中打开) (2023年5月)

- BAD: 大语言模型在候选人筛选背景下的偏见检测 (在新标签页中打开) (2023年5月)

- MemoryBank: 增强大型语言模型的长期记忆 (在新标签页中打开) (2023年5月)

- 知识图谱补全模型是少样本学习者:基于LLMs的电子商务关系标注实证研究 (在新标签页中打开) (2023年5月)

- 关于GPT-3.5和Bard AI模型在Java函数代码生成能力的初步分析 (在新标签页中打开) (2023年5月)

- ChatGPT-4 在零样本学习下标注政治推特消息方面优于专家和众包工作者 (在新标签页中打开) (2023年4月)

- ChatGPT 超越英语:迈向多语言学习中大型语言模型的全面评估 (在新标签页中打开) (2023年4月)

- 通过日本文体分析区分ChatGPT(-3.5, -4)生成的和人类撰写的论文 (在新标签页中打开) (2023年4月)

- Zero-shot Temporal Relation Extraction with ChatGPT (在新标签页中打开) (2023年4月)

- ChatGPT和Bard能否生成一致的评估项目?与人类表现的可靠性分析 (在新标签页中打开) (2023年4月)

- 大型语言模型是否已准备好用于医疗保健?临床语言理解的比较研究 (在新标签页中打开) (2023年4月)

- 华尔街新手:ChatGPT在多模态股票走势预测挑战中的零样本分析 (在新标签页中打开) (2023年4月)

- Toxicity in ChatGPT: 分析角色分配语言模型 (在新标签页中打开) (2023年4月)

- 多步骤越狱隐私攻击对ChatGPT (在新标签页中打开) (2023年4月)

- ChatGPT 是一个好的情感分析器吗?初步研究 (在新标签页中打开) (2023年4月)

- ChatGPT在零样本对话理解中的初步评估 (在新标签页中打开) (2023年4月)

- 通过ChatGPT进行抽取式摘要以生成忠实摘要 (在新标签页中打开) (2023年4月)

- ChatGPT 关于人类价值观的返回内容是什么?使用描述性价值理论探索 ChatGPT 中的价值偏见 (在新标签页中打开) (2023年4月)

- 关于ChatGPT和情感增强提示在心理健康分析中的评估 (在新标签页中打开) (2023年4月)

- ChatGPT-Crawler: 找出ChatGPT是否真的知道它在说什么 (在新标签页中打开) (2023年4月)

- ChatGPT 应该有偏见吗?大型语言模型中偏见的挑战与风险 (在新标签页中打开) (2023年4月)

- 从自然语言规范合成数学程序 (在新标签页中打开) (2023年4月)

- 大型语言模型有效地利用文档级上下文进行文学翻译,但关键错误仍然存在 (在新标签页中打开) (2023年4月)

- 调查使用ChatGPT进行社交媒体立场检测的思维链 (在新标签页中打开) (2023年4月)

- ChatGPT 塑造牙科未来:多模态大型语言模型的潜力 (在新标签页中打开) (2023年4月)

- 大型语言模型能玩好文字游戏吗?当前的最新技术和开放问题 (在新标签页中打开) (2023年4月)

- 使用ChatGPT进行类似人类的摘要评估 (在新标签页中打开) (2023年4月)

- 评估ChatGPT系列模型在生物医学推理和分类中的应用 (在新标签页中打开) (2023年4月)

- CHATGPT与语言模型演进的比较分析 (在新标签页中打开) (2023年4月)

- 释放ChatGPT翻译能力的实证研究 (在新标签页中打开) (2023年4月)

- 岩土工程鹦鹉故事(GPT):通过提示工程克服GPT在岩土工程应用中的幻觉(在新标签页中打开)(2023年4月)

- 解锁ChatGPT的潜力:全面探索其在自然语言处理中的应用、优势、局限性和未来方向 (在新标签页中打开) (2023年4月)

- ChatGPT/GPT-4研究总结及对未来大型语言模型的展望 (在新标签页中打开) (2023年4月)

- ChatGPT 是一个高度流畅的语法错误纠正系统吗?一项全面评估 (在新标签页中打开) (2023年4月)

- 大型语言模型时代的安全分析:使用ChatGPT进行STPA的案例研究 (在新标签页中打开) (2023年4月)

- 大型语言模型可以评估新闻媒体的可信度 (在新标签页中打开) (2023年4月)

- 人工智能聊天机器人能否通过工程基础(FE)和工程原理与实践(PE)结构考试?(在新标签页中打开)(2023年4月)

- 人工智能会让伽马射线天体物理学家失业吗? (在新标签页中打开) (2023年3月)

- 通过盲审评审员和文本分类算法比较ChatGPT生成的摘要与真实摘要 (在新标签页中打开) (2023年3月)

- HuggingGPT: 使用ChatGPT及其在HuggingFace中的朋友们解决AI任务 (在新标签页中打开) (2023年3月)

- SelfCheckGPT: 生成式大型语言模型的无资源黑箱幻觉检测 (在新标签页中打开) (2023年3月)

- WavCaps: 一个由ChatGPT辅助的弱标签音频字幕数据集,用于音频-语言多模态研究 (在新标签页中打开) (2023年3月)

- 大型语言模型在算术任务中的表现如何? (在新标签页中打开) (2023年3月)

- 评估ChatGPT与人类社会之间的跨文化一致性:一项实证研究 (在新标签页中打开) (2023年3月)

- 是的,但是.. ChatGPT 能否识别历史文档中的实体? (在新标签页中打开) (2023年3月)

- 评估ChatGPT在基于NLP的心理健康应用中的应用 (在新标签页中打开) (2023年3月)

- 大象的透视镜:调查Google、ChatGPT、Wikipedia和YouTube上的语言偏见 (在新标签页中打开) (2023年3月)

- ChatGPT 还是学术科学家?使用现成的机器学习工具以超过 99% 的准确率区分作者身份 (在新标签页中打开) (2023年3月)

- 使用ChatGPT进行零样本临床实体识别 (在新标签页中打开) (2023年3月)

- ChatGPT 是一个知识渊博但经验不足的解决者:大型语言模型中的常识问题调查 (在新标签页中打开) (2023年3月)

- ChatGPT4PCG 竞赛:科学鸟类角色化关卡生成 (在新标签页中打开) (2023年3月)

- ChatGPT作为抽象文本摘要的事实不一致性评估器 (在新标签页中打开) (2023年3月)

- Chat-REC: 迈向交互式和可解释的LLMs增强推荐系统 (在新标签页中打开) (2023年3月)

- ChatGPT的零样本文本到SQL能力的全面评估 (在新标签页中打开) (2023年3月)

- 充分利用ChatGPT进行机器翻译 (在新标签页中打开) (2023年3月)

- 错误分析提示使大型语言模型能够进行类似人类的翻译评估:以ChatGPT为例 (在新标签页中打开) (2023年3月)

- ChatGPT 在文本注释任务中表现优于众包工作者 (在新标签页中打开) (2023年3月)

- ChatGPT 还是 Grammarly?在语法错误纠正基准上评估 ChatGPT (在新标签页中打开) (2023年3月)

- ChatGPT 与新的学术现实:AI 撰写的研究论文与学术出版中大语言模型的伦理 (在新标签页中打开) (2023年3月)

- LLMs 是万能的吗?:探索 LLMs 的领域无关推理能力 (在新标签页中打开) (2023年3月)

- ChatGPT 是一个好的关键词生成器吗?初步研究 (在新标签页中打开) (2023年3月)

- MM-REACT: 提示ChatGPT进行多模态推理和行动 (在新标签页中打开) (2023年3月)

- 大型语言模型可用于在零样本学习环境中估计政治家的意识形态 (在新标签页中打开) (2023年3月)

- 中国中级英语学习者在深度连贯性上超越了ChatGPT:来自英语叙事写作的证据 (在新标签页中打开) (2023年3月)

- GPT-3和GPT-3.5系列模型的综合能力分析 (在新标签页中打开) (2023年3月)

- ChatGPT 作为科学写作的交通公平信息来源 (在新标签页中打开) (2023年3月)

- 使用ChatGPT和GPT-4通过提示学习将放射学报告翻译成通俗语言:有希望的结果、局限性和潜力 (在新标签页中打开) (2023年3月)

- ChatGPT 参加计算机科学考试 (在新标签页中打开) (2023年3月)

- ChatGPT的一致性分析 (在新标签页中打开) (2023年3月)

- 研究壳中的算法幽灵:大型语言模型与管理研究中的学术知识创造 (在新标签页中打开) (2023年3月)

- 工作场所中的大型语言模型:关于工作类型分类的提示工程案例研究 (在新标签页中打开) (2023年3月)

- 从学生的视角看ChatGPT:TikTok数据分析 (在新标签页中打开) (2023年3月)

- 使用对话语言模型和提示工程从研究论文中提取准确的材料数据 -- ChatGPT示例 (在新标签页中打开) (2023年3月)

- ChatGPT即将到来:大型语言模型是否足以满足智能交通的需求? (在新标签页中打开) (2023年3月)

- 制作一个计算律师 (在新标签页中打开) (2023年3月)

- LLM的合成数据生成是否有助于临床文本挖掘? (在新标签页中打开) (2023年3月)

- MenuCraft: 使用大型语言模型进行交互式菜单系统设计 (在新标签页中打开) (2023年3月)

- AI生成内容(AIGC)的综合调查:从GAN到ChatGPT的生成AI历史 (在新标签页中打开) (2023年3月)

- 探索ChatGPT用于事件提取的可行性 (在新标签页中打开)

- ChatGPT: 手动注释的终结开始?自动流派识别的用例 (在新标签页中打开) (2023年3月)

- ChatGPT 是一个好的自然语言生成评估器吗?初步研究 (在新标签页中打开) (2023年3月)

- 情感计算会从基础模型和通用人工智能中涌现吗?对ChatGPT的首次评估 (在新标签页中打开) (2023年3月)

- UZH_CLyp 在 SemEval-2023 任务 9 中:用于跨语言学习的头优先微调和 ChatGPT 数据生成在推文亲密性预测中的应用 (在新标签页中打开) (2023年3月)

- 如何格式化输入到ChatGPT模型 (在新标签页中打开) (2023年3月)

- ChatGPT 能否评估人类个性?一个通用评估框架 (在新标签页中打开) (2023年3月)

- 通过ChatGPT进行跨语言摘要 (在新标签页中打开) (2023年2月)

- ChatAug: 利用ChatGPT进行文本数据增强 (在新标签页中打开) (2023年2月)

- Dr ChatGPT,告诉我我想听的:提示知识如何影响健康答案的正确性 (在新标签页中打开) (2023年2月)

- ChatGPT在数学应用题(MWP)上的独立评估(在新标签页中打开)(2023年2月)

- ChatGPT: 2.5个月后的元分析 (在新标签页中打开) (2023年2月)

- 让我们聊聊!与ChatGPT的对话:技术、应用和限制 (在新标签页中打开) (2023年2月)

- 检查事实并重试:利用外部知识和自动反馈改进大型语言模型 (在新标签页中打开) (2023年2月)

- 关于ChatGPT的鲁棒性:对抗性和分布外视角 (在新标签页中打开) (2023年2月)

- 生成式AI模型如ChatGPT如何在SPC实践、教育和研究中被(误)使用?一项探索性研究 (在新标签页中打开) (2023年2月)

- ChatGPT 也能理解吗?ChatGPT 与微调 BERT 的比较研究 (在新标签页中打开) (2023年2月)

- A Prompt Pattern Catalog to Enhance Prompt Engineering with ChatGPT (在新标签页中打开) (2023年2月)

- 通过与ChatGPT聊天进行零样本信息提取 (在新标签页中打开) (2023年2月)

- ChatGPT: 万事通,无一精 (在新标签页中打开) (2023年2月)

- ChatGPT和DALL-E 2在决策制定和空间推理上的初步评估 (在新标签页中打开) (2023年2月)

- 网民、院士和信息专业人士对人工智能的看法,特别是关于ChatGPT (在新标签页中打开) (2023年2月)

- ChatGPT中的语言歧义分析 (在新标签页中打开) (2023年2月)

- ChatGPT 与传统知识图谱问答的对比:知识图谱聊天机器人的现状与未来方向 (在新标签页中打开) (2023年2月)

- ChatGPT和生成式AI对科学意味着什么 (在新标签页中打开) (2023年2月)

- 应用BERT和ChatGPT对科学文献中莱姆病的情感分析 (在新标签页中打开) (2023年2月)

- 探索ChatGPT的AI伦理:诊断分析 (在新标签页中打开) (2023年1月)

- ChatGPT 对教育有益吗?关于大型语言模型在教育中的机遇与挑战 (在新标签页中打开) (2023年1月)

- 对话式AI的政治意识形态:关于ChatGPT亲环境、左翼自由意志主义倾向的趋同证据 (在新标签页中打开) (2023年1月)

- 提高可靠性的技术 - OpenAI Cookbook (在新标签页中打开)

- Awesome ChatGPT Prompts (在新标签页中打开)

- 介绍ChatGPT (在新标签页中打开) (2022年11月)