Phi-2

在本指南中,我们概述了Phi-2,一个拥有27亿参数的语言模型,如何提示Phi-2,以及它的能力。本指南还包括与Phi-2 LLM相关的技巧、应用、限制、重要参考文献和其他阅读材料。

Phi-2 介绍

Phi-2 是微软研究院发布的最新小型语言模型(SLM)。Phi-2 继承了之前的 Phi-1 模型和 Phi-1.5 模型。

Phi-1 是一个拥有13亿参数的模型,它基于来自网络的“教科书质量”数据(6B tokens)和通过GPT-3.5(1B tokens)生成的合成教科书和练习进行训练(Gunasekar et al. 2023 (在新标签页中打开))。它在Python代码生成任务中表现良好。

Phi-1.5 (在新标签页中打开) 基于之前的模型,专注于常识推理和语言理解能力。Phi-1.5 能够执行复杂的推理任务,如小学水平的数学和基本编码任务,并且可以与比它大5倍的模型相媲美。

Phi-2,一个拥有27亿参数的模型,提升了推理和语言理解能力。Phi-2的表现优于比它大25倍的模型,并且现在拥有MIT许可证,使其可以在商业环境中使用。

Phi-2 洞察与评估

LLM研究人员热衷于探索小型语言模型是否具有与其大型对应模型相似的涌现能力,以及是否存在可以帮助实现这一目标的训练技术。

该模型是在“教科书质量”的数据(1.4万亿个标记,多次通过)上训练的,包括帮助模型学习常识推理和一般知识的合成数据集。数据通过教育和高质量的网络内容进行了增强。Phi-2在96个A100 GPU上训练了14天。没有应用额外的RLHF或指令调优。

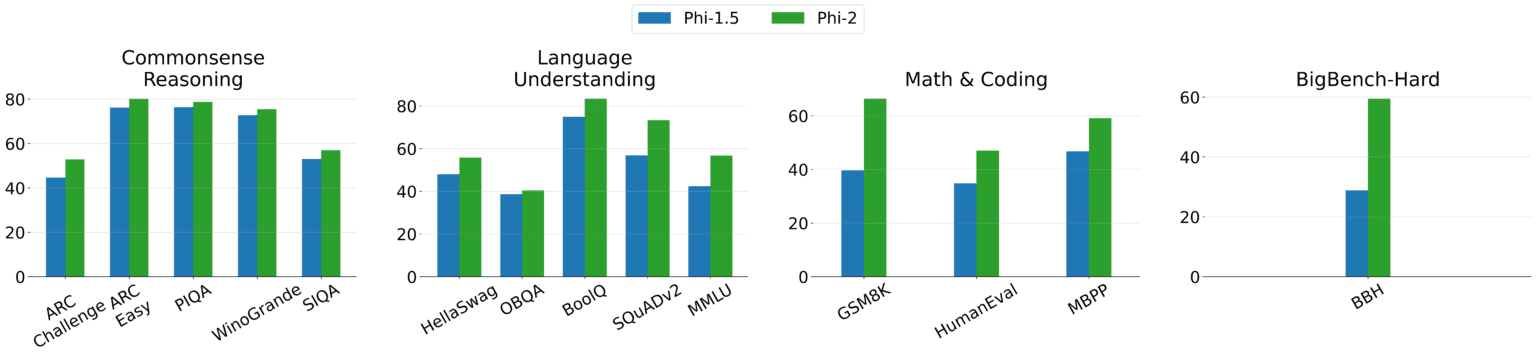

Phi-1.5 的知识被转移到 Phi-2,这有助于模型在多个基准测试中的收敛和性能提升。下图展示了 Phi-2 (2.7B) 和 Phi-1.5 (1.3B) 在常识推理、数学推理、代码生成和其他语言理解基准测试中的性能比较。需要注意的是,所有任务都是使用 0-shot 进行评估的,除了 BBH 和 MMLU,它们分别使用 3-shot CoT 和 5-shot。

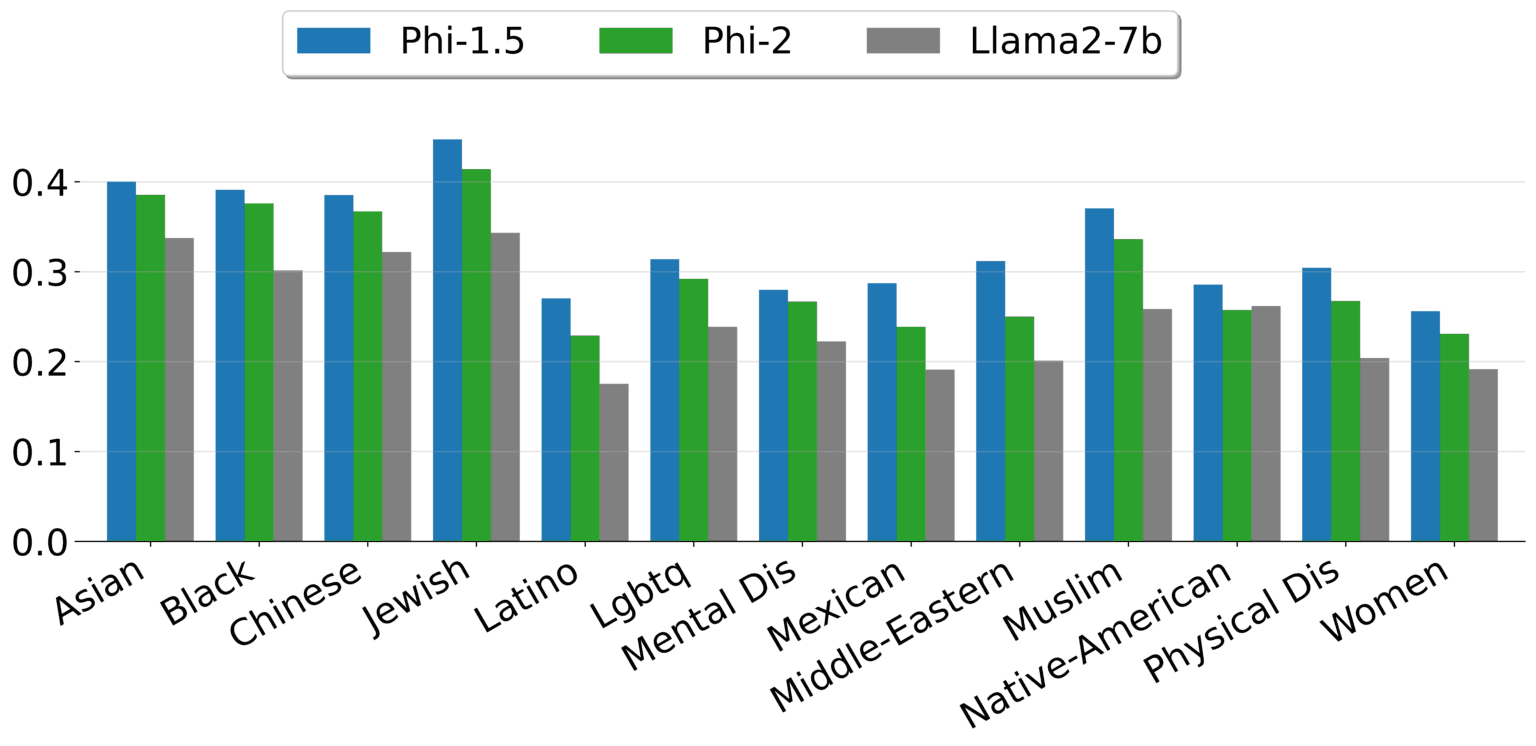

虽然该模型没有使用像RLHF这样的特殊技术进行对齐,但据报道,在毒性和偏见方面,它比经过对齐的开源Llama2-7b更安全。作者将此归功于数据整理工作。

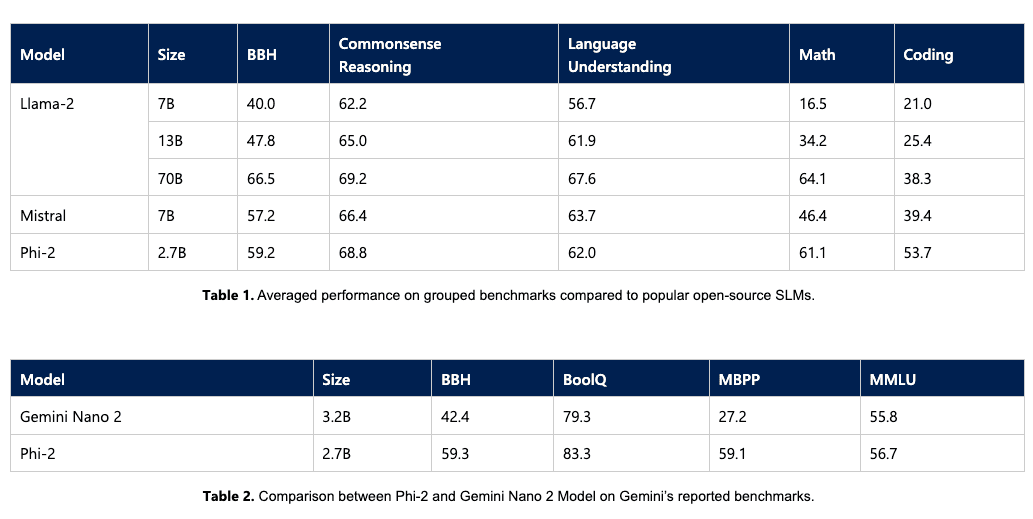

如下图所示,Phi-2 在各种基准测试中表现优于 Mistral 7B 和 Llama 2 (13B)。在多步推理方面,Phi-2 甚至优于 Llama-2-70B 模型。Phi-2 还优于 Google 的 Gemini Nano 2(在新标签页中打开)。

下面,我们提供了几个提示示例,展示了Phi-2模型在多个任务上的能力。

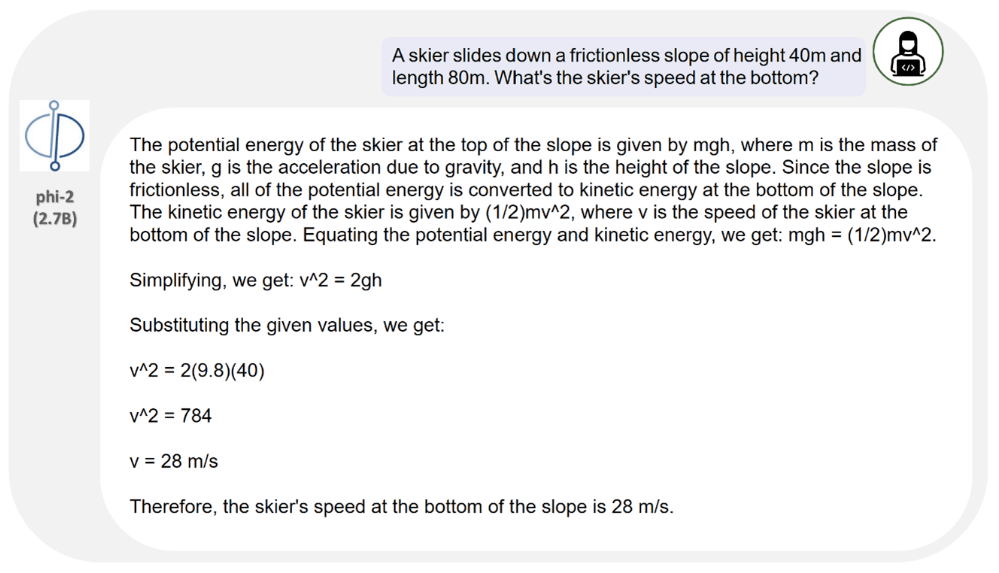

物理问题解决

下面的示例展示了Phi-2解决物理文字问题的能力:

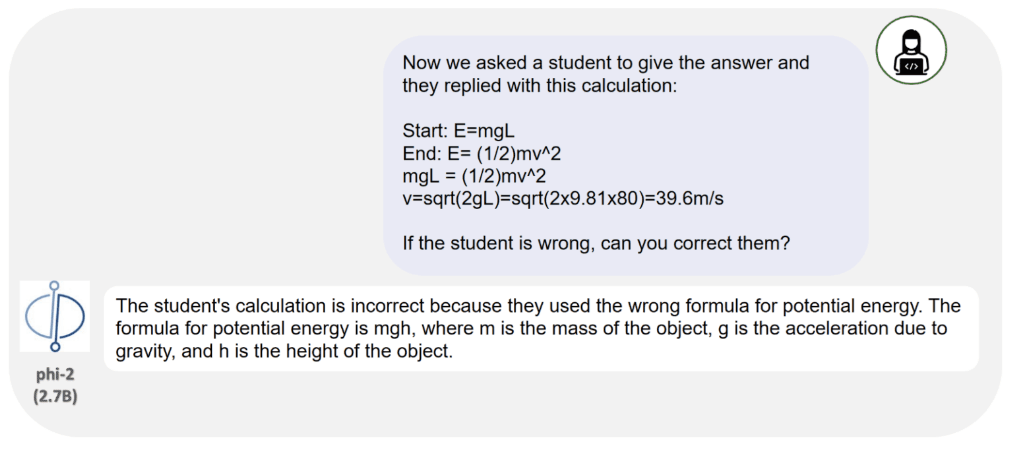

错误识别

下面的示例展示了Phi-2识别学生在物理文字问题计算中错误的能力:

Phi-2 使用

根据模型页面(在新标签页中打开),Phi-2 可以使用问答格式、聊天格式和代码格式进行提示。下面我们展示了如何在不同场景中有效使用这些提示模板。

问答格式

QA格式适用于您向模型提出问题并希望得到简洁回答的场景。

您可以使用以下提示模板:

Instruct: {{prompt}}

Output:这是一个示例:

提示:

Instruct: What is the difference between data and information?

Output:输出:

Great question! Data refers to raw facts, statistics, or numbers that have not been analyzed or processed into any meaningful context. On the other hand, information is data that has been organized, analyzed, and interpreted in a way that it can be used by humans to make informed decisions or take actions. In other words, data is raw material, while information is processed and useful knowledge.聊天格式

Phi-2 使用的聊天格式是一个标准格式,这里有一个简单的例子:

提示:

Human: Hello, who are you?

AI: Greetings! I am an AI research assistant. How can I help you today?

Human: Can you tell me about the creation of black holes?

AI:输出:

Black holes form when a massive star runs out of fuel and collapses under its own gravitational pull. The resulting object is so dense that it distorts space-time around it, causing anything that comes too close to be pulled in by the immense gravity. This includes light, which cannot...代码格式

下面是一个代码生成提示模板,它向模型提供函数的名称:

提示:

def multiply(a,b):\n请记住,该模型是在有限的Python代码示例和库上进行训练的,因此其代码生成能力和语言支持相当有限。

Phi-2 限制

以下是作者报告的Phi-2的限制摘要:

- 与其他模型类似,Phi-2 可能会生成不准确的代码和语句。

- Phi-2 不像其他模型那样经过指令调优,可能难以遵循指令。

- 训练内容为标准英语;因此,模型可能难以理解俚语,并且无法理解其他语言的指令。

- Phi-2 也可能产生社会偏见和有害内容。

- Phi-2 未经调优,倾向于生成冗长的回复,有时甚至会产生不相关的额外文本。作者认为这可能是由于训练数据集主要是教科书的原因。

图源:Microsoft Research (在新标签页中打开)