邻域注意力变换器

该模型目前处于维护模式,我们不接受任何更改其代码的新PR。

如果您在运行此模型时遇到任何问题,请重新安装支持此模型的最后一个版本:v4.40.2。

您可以通过运行以下命令来执行此操作:pip install -U transformers==4.40.2。

概述

NAT 是由 Ali Hassani、Steven Walton、Jiachen Li、Shen Li 和 Humphrey Shi 在 Neighborhood Attention Transformer 中提出的。

它是一种基于邻域注意力的分层视觉变换器,邻域注意力是一种滑动窗口自注意力模式。

论文的摘要如下:

我们提出了邻域注意力(NA),这是第一个高效且可扩展的视觉滑动窗口注意力机制。 NA是一种逐像素操作,将自注意力(SA)定位到最近的相邻像素,因此与SA的二次复杂度相比,具有线性的时间和空间复杂度。滑动窗口模式使得NA的感受野能够增长而无需额外的像素移动,并且与Swin Transformer的窗口自注意力(WSA)不同,它保持了平移等变性。我们开发了NATTEN(邻域注意力扩展),这是一个带有高效C++和CUDA内核的Python包,它使得NA的运行速度比Swin的WSA快40%,同时使用的内存减少了25%。我们进一步提出了邻域注意力Transformer(NAT),这是一种基于NA的新层次Transformer设计,提升了图像分类和下游视觉任务的性能。NAT的实验结果具有竞争力;NAT-Tiny在ImageNet上达到了83.2%的top-1准确率,在MS-COCO上达到了51.4%的mAP,在ADE20K上达到了48.4%的mIoU,与类似大小的Swin模型相比,ImageNet准确率提高了1.9%,COCO mAP提高了1.0%,ADE20K mIoU提高了2.6%。

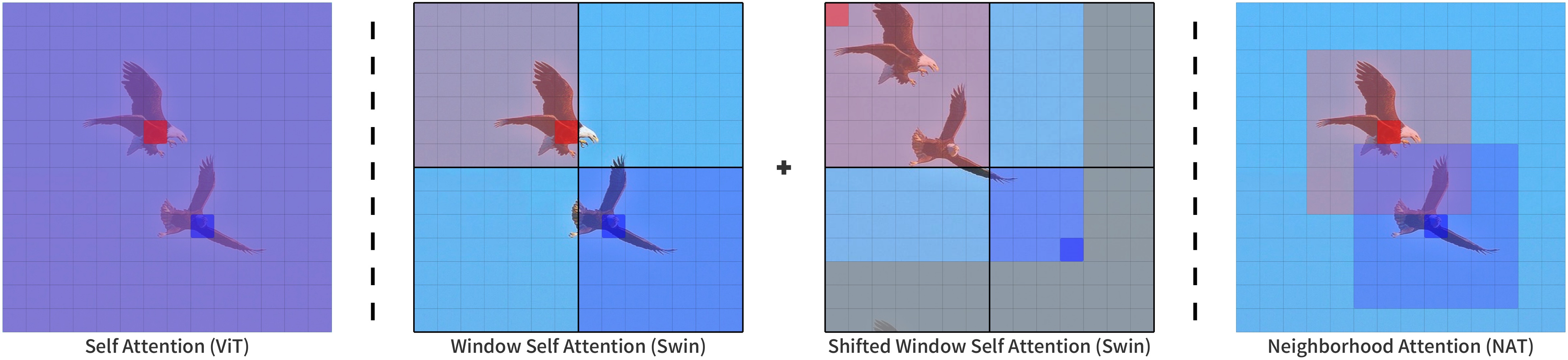

Neighborhood Attention compared to other attention patterns.

Taken from the original paper.

Neighborhood Attention compared to other attention patterns.

Taken from the original paper. 该模型由Ali Hassani贡献。 原始代码可以在这里找到。

使用提示

- 可以使用AutoImageProcessor API来为模型准备图像。

- NAT 可以用作骨干。当

output_hidden_states = True时, 它将输出hidden_states和reshaped_hidden_states。reshaped_hidden_states的形状为(batch, num_channels, height, width),而不是(batch_size, height, width, num_channels)。

备注:

- NAT依赖于NATTEN的邻域注意力实现。

你可以通过参考shi-labs.com/natten安装预构建的Linux轮子,

或者通过运行

pip install natten在你的系统上构建。 请注意,后者可能需要一些时间来编译。NATTEN目前还不支持Windows设备。 - 目前仅支持4的补丁大小。

资源

一份官方的Hugging Face和社区(由🌎表示)资源列表,帮助您开始使用NAT。

- NatForImageClassification 由这个 示例脚本 和 笔记本 支持。

- 另请参阅:图像分类任务指南

如果您有兴趣提交资源以包含在此处,请随时打开一个 Pull Request,我们将进行审核!理想情况下,资源应展示一些新内容,而不是重复现有资源。

NatConfig

类 transformers.NatConfig

< source >( patch_size = 4 num_channels = 3 embed_dim = 64 depths = [3, 4, 6, 5] num_heads = [2, 4, 8, 16] kernel_size = 7 mlp_ratio = 3.0 qkv_bias = True hidden_dropout_prob = 0.0 attention_probs_dropout_prob = 0.0 drop_path_rate = 0.1 hidden_act = 'gelu' initializer_range = 0.02 layer_norm_eps = 1e-05 layer_scale_init_value = 0.0 out_features = None out_indices = None **kwargs )

参数

- patch_size (

int, 可选, 默认为 4) — 每个补丁的大小(分辨率)。注意:目前仅支持大小为4的补丁。 - num_channels (

int, optional, 默认为 3) — 输入通道的数量。 - embed_dim (

int, optional, defaults to 64) — 补丁嵌入的维度. - depths (

List[int], optional, defaults to[3, 4, 6, 5]) — 编码器每一层的层数。 - num_heads (

List[int], optional, defaults to[2, 4, 8, 16]) — Transformer编码器每一层中的注意力头数。 - kernel_size (

int, optional, defaults to 7) — 邻域注意力核大小。 - mlp_ratio (

float, optional, defaults to 3.0) — MLP隐藏维度与嵌入维度的比率。 - qkv_bias (

bool, optional, defaults toTrue) — 是否应该向查询、键和值添加可学习的偏置。 - hidden_dropout_prob (

float, optional, 默认为 0.0) — 嵌入层和编码器中所有全连接层的 dropout 概率。 - attention_probs_dropout_prob (

float, optional, 默认为 0.0) — 注意力概率的丢弃比例。 - drop_path_rate (

float, optional, 默认为 0.1) — 随机深度率. - hidden_act (

str或function, 可选, 默认为"gelu") — 编码器中的非线性激活函数(函数或字符串)。如果是字符串,支持"gelu","relu","selu"和"gelu_new". - initializer_range (

float, 可选, 默认为 0.02) — 用于初始化所有权重矩阵的截断正态初始化器的标准差。 - layer_norm_eps (

float, optional, defaults to 1e-05) — 层归一化层使用的epsilon值。 - layer_scale_init_value (

float, optional, 默认为 0.0) — 层比例的初始值。如果 <=0 则禁用。 - out_features (

List[str], 可选) — 如果用作骨干网络,输出特征的列表。可以是"stem","stage1","stage2"等。 (取决于模型有多少个阶段)。如果未设置且out_indices已设置,将默认为相应的阶段。如果未设置且out_indices也未设置,将默认为最后一个阶段。必须与stage_names属性中定义的顺序相同。 - out_indices (

List[int], 可选) — 如果用作骨干网络,输出特征的索引列表。可以是0、1、2等(取决于模型有多少个阶段)。如果未设置且out_features已设置,将默认为相应的阶段。 如果未设置且out_features也未设置,将默认为最后一个阶段。必须与stage_names属性中定义的顺序相同。

这是用于存储NatModel配置的配置类。它用于根据指定的参数实例化一个Nat模型,定义模型架构。使用默认值实例化配置将产生类似于shi-labs/nat-mini-in1k-224架构的配置。

配置对象继承自PretrainedConfig,可用于控制模型输出。阅读PretrainedConfig的文档以获取更多信息。

示例:

>>> from transformers import NatConfig, NatModel

>>> # Initializing a Nat shi-labs/nat-mini-in1k-224 style configuration

>>> configuration = NatConfig()

>>> # Initializing a model (with random weights) from the shi-labs/nat-mini-in1k-224 style configuration

>>> model = NatModel(configuration)

>>> # Accessing the model configuration

>>> configuration = model.configNatModel

类 transformers.NatModel

< source >( config add_pooling_layer = True )

参数

- config (NatConfig) — 包含模型所有参数的模型配置类。 使用配置文件初始化不会加载与模型相关的权重,只会加载配置。查看 from_pretrained() 方法以加载模型权重。

裸的Nat模型转换器输出原始隐藏状态,没有任何特定的头部。 这个模型是PyTorch torch.nn.Module 的子类。将其用作常规的PyTorch模块,并参考PyTorch文档以获取与一般使用和行为相关的所有信息。

前进

< source >( pixel_values: typing.Optional[torch.FloatTensor] = None output_attentions: typing.Optional[bool] = None output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None ) → transformers.models.deprecated.nat.modeling_nat.NatModelOutput 或 tuple(torch.FloatTensor)

参数

- pixel_values (

torch.FloatTensorof shape(batch_size, num_channels, height, width)) — 像素值。像素值可以使用AutoImageProcessor获取。详情请参见ViTImageProcessor.call()。 - output_attentions (

bool, 可选) — 是否返回所有注意力层的注意力张量。有关更多详细信息,请参见返回张量下的attentions。 - output_hidden_states (

bool, 可选) — 是否返回所有层的隐藏状态。有关更多详细信息,请参阅返回张量下的hidden_states。 - return_dict (

bool, 可选) — 是否返回一个ModelOutput而不是一个普通的元组。

返回

transformers.models.deprecated.nat.modeling_nat.NatModelOutput 或 tuple(torch.FloatTensor)

一个 transformers.models.deprecated.nat.modeling_nat.NatModelOutput 或一个由 torch.FloatTensor 组成的元组(如果传递了 return_dict=False 或当 config.return_dict=False 时),包含根据配置(NatConfig)和输入的各种元素。

-

last_hidden_state (

torch.FloatTensor形状为(batch_size, sequence_length, hidden_size)) — 模型最后一层输出的隐藏状态序列。 -

pooler_output (

torch.FloatTensor形状为(batch_size, hidden_size), 可选, 当传递add_pooling_layer=True时返回) — 最后一层隐藏状态的平均池化。 -

hidden_states (

tuple(torch.FloatTensor), 可选, 当传递output_hidden_states=True或当config.output_hidden_states=True时返回) — 由torch.FloatTensor组成的元组(一个用于嵌入层的输出,一个用于每个阶段的输出),形状为(batch_size, sequence_length, hidden_size)。模型在每层输出处的隐藏状态加上初始嵌入输出。

-

attentions (

tuple(torch.FloatTensor), 可选, 当传递output_attentions=True或当config.output_attentions=True时返回) — 由torch.FloatTensor组成的元组(每个阶段一个),形状为(batch_size, num_heads, sequence_length, sequence_length)。注意力权重在注意力 softmax 之后,用于计算自注意力头中的加权平均值。

-

reshaped_hidden_states (

tuple(torch.FloatTensor), 可选, 当传递output_hidden_states=True或当config.output_hidden_states=True时返回) — 由torch.FloatTensor组成的元组(一个用于嵌入层的输出,一个用于每个阶段的输出),形状为(batch_size, hidden_size, height, width)。模型在每层输出处的隐藏状态加上初始嵌入输出,重新调整为包含空间维度。

NatModel 的 forward 方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from transformers import AutoImageProcessor, NatModel

>>> import torch

>>> from datasets import load_dataset

>>> dataset = load_dataset("huggingface/cats-image", trust_remote_code=True)

>>> image = dataset["test"]["image"][0]

>>> image_processor = AutoImageProcessor.from_pretrained("shi-labs/nat-mini-in1k-224")

>>> model = NatModel.from_pretrained("shi-labs/nat-mini-in1k-224")

>>> inputs = image_processor(image, return_tensors="pt")

>>> with torch.no_grad():

... outputs = model(**inputs)

>>> last_hidden_states = outputs.last_hidden_state

>>> list(last_hidden_states.shape)

[1, 7, 7, 512]NatForImageClassification

类 transformers.NatForImageClassification

< source >( config )

参数

- config (NatConfig) — 包含模型所有参数的模型配置类。 使用配置文件初始化不会加载与模型相关的权重,只会加载配置。查看 from_pretrained() 方法以加载模型权重。

带有图像分类头部的Nat模型转换器(在[CLS]标记的最终隐藏状态之上的线性层),例如用于ImageNet。

该模型是一个PyTorch torch.nn.Module 子类。将其作为常规的PyTorch模块使用,并参考PyTorch文档以获取与一般使用和行为相关的所有信息。

前进

< source >( pixel_values: typing.Optional[torch.FloatTensor] = None labels: typing.Optional[torch.LongTensor] = None output_attentions: typing.Optional[bool] = None output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None ) → transformers.models.deprecated.nat.modeling_nat.NatImageClassifierOutput 或 tuple(torch.FloatTensor)

参数

- pixel_values (

torch.FloatTensorof shape(batch_size, num_channels, height, width)) — 像素值。像素值可以使用AutoImageProcessor获取。详情请参见ViTImageProcessor.call()。 - output_attentions (

bool, 可选) — 是否返回所有注意力层的注意力张量。有关更多详细信息,请参见返回张量下的attentions。 - output_hidden_states (

bool, 可选) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量下的hidden_states。 - return_dict (

bool, 可选) — 是否返回一个ModelOutput而不是一个普通的元组。 - labels (

torch.LongTensor形状为(batch_size,), 可选) — 用于计算图像分类/回归损失的标签。索引应在[0, ..., config.num_labels - 1]范围内。如果config.num_labels == 1,则计算回归损失(均方损失),如果config.num_labels > 1,则计算分类损失(交叉熵)。

返回

transformers.models.deprecated.nat.modeling_nat.NatImageClassifierOutput 或 tuple(torch.FloatTensor)

一个 transformers.models.deprecated.nat.modeling_nat.NatImageClassifierOutput 或一个由

torch.FloatTensor 组成的元组(如果传递了 return_dict=False 或当 config.return_dict=False 时),包含各种

元素,具体取决于配置(NatConfig)和输入。

-

loss (

torch.FloatTensor形状为(1,),可选,当提供labels时返回) — 分类(或回归,如果 config.num_labels==1)损失。 -

logits (

torch.FloatTensor形状为(batch_size, config.num_labels)) — 分类(或回归,如果 config.num_labels==1)得分(在 SoftMax 之前)。 -

hidden_states (

tuple(torch.FloatTensor),可选,当传递output_hidden_states=True或当config.output_hidden_states=True时返回) — 由torch.FloatTensor组成的元组(一个用于嵌入的输出 + 一个用于每个阶段的输出),形状为(batch_size, sequence_length, hidden_size)。模型在每层输出处的隐藏状态加上初始嵌入输出。

-

attentions (

tuple(torch.FloatTensor),可选,当传递output_attentions=True或当config.output_attentions=True时返回) — 由torch.FloatTensor组成的元组(每个阶段一个),形状为(batch_size, num_heads, sequence_length, sequence_length)。注意力 softmax 后的注意力权重,用于计算自注意力头中的加权平均值。

-

reshaped_hidden_states (

tuple(torch.FloatTensor),可选,当传递output_hidden_states=True或当config.output_hidden_states=True时返回) — 由torch.FloatTensor组成的元组(一个用于嵌入的输出 + 一个用于每个阶段的输出),形状为(batch_size, hidden_size, height, width)。模型在每层输出处的隐藏状态加上初始嵌入输出,重新调整为包含空间维度。

NatForImageClassification 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from transformers import AutoImageProcessor, NatForImageClassification

>>> import torch

>>> from datasets import load_dataset

>>> dataset = load_dataset("huggingface/cats-image", trust_remote_code=True)

>>> image = dataset["test"]["image"][0]

>>> image_processor = AutoImageProcessor.from_pretrained("shi-labs/nat-mini-in1k-224")

>>> model = NatForImageClassification.from_pretrained("shi-labs/nat-mini-in1k-224")

>>> inputs = image_processor(image, return_tensors="pt")

>>> with torch.no_grad():

... logits = model(**inputs).logits

>>> # model predicts one of the 1000 ImageNet classes

>>> predicted_label = logits.argmax(-1).item()

>>> print(model.config.id2label[predicted_label])

tiger cat