ResNet

概述

ResNet模型由何凯明、张翔宇、任少卿和孙剑在《深度残差学习用于图像识别》中提出。我们的实现遵循了Nvidia所做的小改动,我们在瓶颈的3x3卷积中应用stride=2进行下采样,而不是在第一个1x1卷积中。这通常被称为“ResNet v1.5”。

ResNet引入了残差连接,它们允许训练具有前所未有层数(多达1000层)的网络。ResNet赢得了2015年ILSVRC和COCO竞赛,这是深度计算机视觉领域的一个重要里程碑。

论文的摘要如下:

更深的神经网络更难训练。我们提出了一个残差学习框架,以简化比之前使用的网络更深的网络的训练。我们明确地将层重新表述为学习与层输入相关的残差函数,而不是学习无参考的函数。我们提供了全面的实证证据,表明这些残差网络更容易优化,并且可以从显著增加的深度中获得更高的准确性。在ImageNet数据集上,我们评估了深度高达152层的残差网络---比VGG网络深8倍,但复杂度仍然较低。这些残差网络的集成在ImageNet测试集上实现了3.57%的错误率。这一结果在ILSVRC 2015分类任务中获得了第一名。我们还对CIFAR-10进行了100层和1000层的分析。 表示的深度对于许多视觉识别任务至关重要。仅仅由于我们极深的表示,我们在COCO目标检测数据集上获得了28%的相对改进。深度残差网络是我们提交给ILSVRC和COCO 2015竞赛的基础,我们在ImageNet检测、ImageNet定位、COCO检测和COCO分割任务中也获得了第一名。

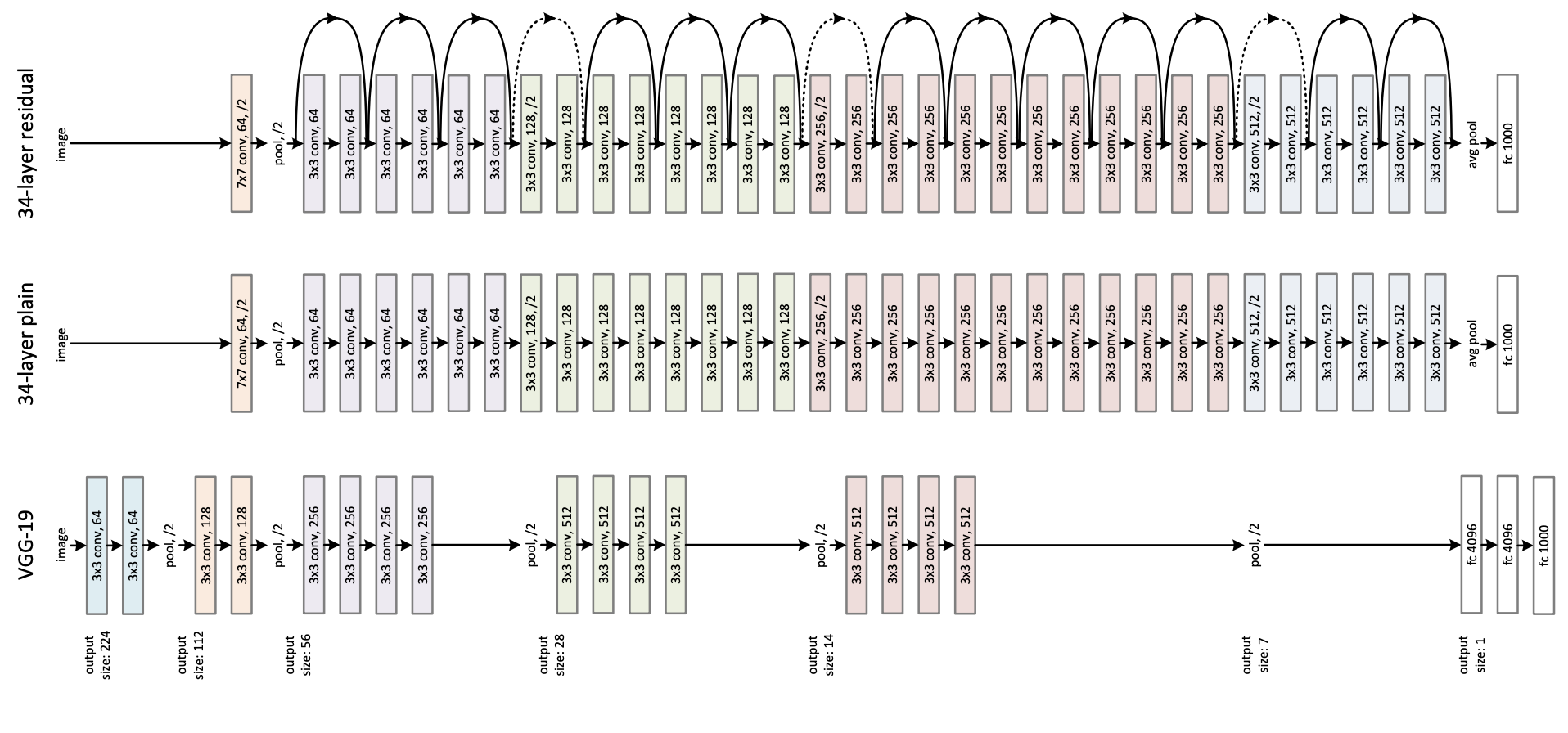

下图展示了ResNet的架构。取自原始论文。

该模型由Francesco贡献。该模型的TensorFlow版本由amyeroberts添加。原始代码可以在这里找到。

资源

一份官方的 Hugging Face 和社区(由🌎表示)资源列表,帮助您开始使用 ResNet。

- ResNetForImageClassification 由这个 示例脚本 和 笔记本 支持。

- 另请参阅:图像分类任务指南

如果您有兴趣提交资源以包含在此处,请随时打开一个 Pull Request,我们将进行审核!理想情况下,资源应展示一些新内容,而不是重复现有资源。

ResNetConfig

类 transformers.ResNetConfig

< source >( num_channels = 3 embedding_size = 64 hidden_sizes = [256, 512, 1024, 2048] depths = [3, 4, 6, 3] layer_type = 'bottleneck' hidden_act = 'relu' downsample_in_first_stage = False downsample_in_bottleneck = False out_features = None out_indices = None **kwargs )

参数

- num_channels (

int, optional, defaults to 3) — 输入通道的数量。 - embedding_size (

int, optional, defaults to 64) — 嵌入层的维度(隐藏大小)。 - hidden_sizes (

List[int], optional, defaults to[256, 512, 1024, 2048]) — 每个阶段的维度(隐藏大小)。 - depths (

List[int], optional, defaults to[3, 4, 6, 3]) — 每个阶段的深度(层数)。 - layer_type (

str, 可选, 默认为"bottleneck") — 使用的层类型,可以是"basic"(用于较小的模型,如 resnet-18 或 resnet-34)或"bottleneck"(用于较大的模型,如 resnet-50 及以上)。 - hidden_act (

str, 可选, 默认为"relu") — 每个块中的非线性激活函数。如果是字符串,支持"gelu","relu","selu"和"gelu_new"。 - downsample_in_first_stage (

bool, 可选, 默认为False) — 如果为True,第一阶段将使用stride为 2 来下采样输入。 - downsample_in_bottleneck (

bool, 可选, 默认为False) — 如果为True,ResNetBottleNeckLayer 中的第一个 1x1 卷积将使用stride为 2 来下采样输入。 - out_features (

List[str], 可选) — 如果用作骨干网络,输出特征的列表。可以是"stem"、"stage1"、"stage2"等。 (取决于模型有多少个阶段)。如果未设置且out_indices已设置,将默认为相应的阶段。如果未设置且out_indices也未设置,将默认为最后一个阶段。必须与stage_names属性中定义的顺序相同。 - out_indices (

List[int], 可选) — 如果用作骨干网络,输出特征的索引列表。可以是0、1、2等(取决于模型有多少个阶段)。如果未设置且out_features已设置,将默认为相应的阶段。 如果未设置且out_features也未设置,将默认为最后一个阶段。必须与stage_names属性中定义的顺序相同。

这是用于存储ResNetModel配置的配置类。它用于根据指定的参数实例化ResNet模型,定义模型架构。使用默认值实例化配置将产生与ResNet microsoft/resnet-50架构类似的配置。

配置对象继承自PretrainedConfig,可用于控制模型输出。阅读PretrainedConfig的文档以获取更多信息。

示例:

>>> from transformers import ResNetConfig, ResNetModel

>>> # Initializing a ResNet resnet-50 style configuration

>>> configuration = ResNetConfig()

>>> # Initializing a model (with random weights) from the resnet-50 style configuration

>>> model = ResNetModel(configuration)

>>> # Accessing the model configuration

>>> configuration = model.configResNetModel

类 transformers.ResNetModel

< source >( config )

参数

- config (ResNetConfig) — 包含模型所有参数的模型配置类。 使用配置文件初始化不会加载与模型相关的权重,只会加载配置。查看 from_pretrained() 方法以加载模型权重。

裸ResNet模型输出原始特征,没有任何特定的头部。 此模型是PyTorch torch.nn.Module 的子类。将其用作常规的PyTorch模块,并参考PyTorch文档以获取与一般使用和行为相关的所有信息。

前进

< source >( pixel_values: Tensor output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None ) → transformers.modeling_outputs.BaseModelOutputWithPoolingAndNoAttention 或 tuple(torch.FloatTensor)

参数

- pixel_values (

torch.FloatTensorof shape(batch_size, num_channels, height, width)) — 像素值。像素值可以使用AutoImageProcessor获取。详情请参见 ConvNextImageProcessor.call(). - output_hidden_states (

bool, 可选) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量下的hidden_states。 - return_dict (

bool, 可选) — 是否返回一个ModelOutput而不是一个普通的元组。

返回

transformers.modeling_outputs.BaseModelOutputWithPoolingAndNoAttention 或 tuple(torch.FloatTensor)

一个 transformers.modeling_outputs.BaseModelOutputWithPoolingAndNoAttention 或一个由

torch.FloatTensor 组成的元组(如果传递了 return_dict=False 或当 config.return_dict=False 时),包含各种

元素,具体取决于配置(ResNetConfig)和输入。

-

last_hidden_state (

torch.FloatTensor形状为(batch_size, num_channels, height, width)) — 模型最后一层输出的隐藏状态序列。 -

pooler_output (

torch.FloatTensor形状为(batch_size, hidden_size)) — 在空间维度上进行池化操作后的最后一层隐藏状态。 -

hidden_states (

tuple(torch.FloatTensor), 可选, 当传递了output_hidden_states=True或当config.output_hidden_states=True时返回) — 由torch.FloatTensor组成的元组(一个用于嵌入层的输出,如果模型有嵌入层,+ 一个用于每一层的输出)形状为(batch_size, num_channels, height, width)。模型在每一层输出的隐藏状态加上可选的初始嵌入输出。

ResNetModel 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from transformers import AutoImageProcessor, ResNetModel

>>> import torch

>>> from datasets import load_dataset

>>> dataset = load_dataset("huggingface/cats-image", trust_remote_code=True)

>>> image = dataset["test"]["image"][0]

>>> image_processor = AutoImageProcessor.from_pretrained("microsoft/resnet-50")

>>> model = ResNetModel.from_pretrained("microsoft/resnet-50")

>>> inputs = image_processor(image, return_tensors="pt")

>>> with torch.no_grad():

... outputs = model(**inputs)

>>> last_hidden_states = outputs.last_hidden_state

>>> list(last_hidden_states.shape)

[1, 2048, 7, 7]ResNetForImageClassification

类 transformers.ResNetForImageClassification

< source >( config )

参数

- config (ResNetConfig) — 包含模型所有参数的模型配置类。 使用配置文件初始化不会加载与模型相关的权重,只会加载配置。查看 from_pretrained() 方法以加载模型权重。

ResNet模型,顶部带有图像分类头(在池化特征之上的线性层),例如用于ImageNet。

该模型是一个PyTorch torch.nn.Module 子类。将其用作常规的PyTorch模块,并参考PyTorch文档以获取与一般使用和行为相关的所有信息。

前进

< source >( pixel_values: typing.Optional[torch.FloatTensor] = None labels: typing.Optional[torch.LongTensor] = None output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None ) → transformers.modeling_outputs.ImageClassifierOutputWithNoAttention 或 tuple(torch.FloatTensor)

参数

- pixel_values (

torch.FloatTensorof shape(batch_size, num_channels, height, width)) — 像素值。像素值可以使用AutoImageProcessor获取。详情请参见 ConvNextImageProcessor.call(). - output_hidden_states (

bool, 可选) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量下的hidden_states。 - return_dict (

bool, 可选) — 是否返回一个ModelOutput而不是一个普通的元组。 - labels (

torch.LongTensorof shape(batch_size,), optional) — 用于计算图像分类/回归损失的标签。索引应在[0, ..., config.num_labels - 1]范围内。如果config.num_labels > 1,则计算分类损失(交叉熵)。

返回

transformers.modeling_outputs.ImageClassifierOutputWithNoAttention 或 tuple(torch.FloatTensor)

一个 transformers.modeling_outputs.ImageClassifierOutputWithNoAttention 或一个包含各种元素的

torch.FloatTensor 元组(如果传递了 return_dict=False 或当 config.return_dict=False 时),具体取决于配置(ResNetConfig)和输入。

- loss (

torch.FloatTensor形状为(1,),可选,当提供labels时返回) — 分类(或回归,如果 config.num_labels==1)损失。 - logits (

torch.FloatTensor形状为(batch_size, config.num_labels)) — 分类(或回归,如果 config.num_labels==1)得分(在 SoftMax 之前)。 - hidden_states (

tuple(torch.FloatTensor),可选,当传递output_hidden_states=True或当config.output_hidden_states=True时返回) —torch.FloatTensor元组(一个用于嵌入层的输出,如果模型有嵌入层,+ 一个用于每个阶段的输出)形状为(batch_size, num_channels, height, width)。模型在每个阶段输出的隐藏状态(也称为特征图)。

ResNetForImageClassification 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from transformers import AutoImageProcessor, ResNetForImageClassification

>>> import torch

>>> from datasets import load_dataset

>>> dataset = load_dataset("huggingface/cats-image", trust_remote_code=True)

>>> image = dataset["test"]["image"][0]

>>> image_processor = AutoImageProcessor.from_pretrained("microsoft/resnet-50")

>>> model = ResNetForImageClassification.from_pretrained("microsoft/resnet-50")

>>> inputs = image_processor(image, return_tensors="pt")

>>> with torch.no_grad():

... logits = model(**inputs).logits

>>> # model predicts one of the 1000 ImageNet classes

>>> predicted_label = logits.argmax(-1).item()

>>> print(model.config.id2label[predicted_label])

tiger catTFResNetModel

类 transformers.TFResNetModel

< source >( config: ResNetConfig **kwargs )

参数

- config (ResNetConfig) — 包含模型所有参数的模型配置类。 使用配置文件初始化不会加载与模型相关的权重,只会加载配置。查看 from_pretrained() 方法以加载模型权重。

裸ResNet模型输出原始特征,没有任何特定的头部。 该模型是TensorFlow keras.layers.Layer 的子类。将其用作 常规的TensorFlow模块,并参考TensorFlow文档以获取与一般使用和行为相关的所有信息。

调用

< source >( pixel_values: Tensor output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None training: bool = False ) → transformers.modeling_tf_outputs.TFBaseModelOutputWithPoolingAndNoAttention 或 tuple(tf.Tensor)

参数

- pixel_values (

tf.Tensorof shape(batch_size, num_channels, height, width)) — 像素值。像素值可以使用AutoImageProcessor获取。详情请参见 ConvNextImageProcessor.call(). - output_hidden_states (

bool, optional) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量下的hidden_states。 - return_dict (

bool, 可选) — 是否返回一个 ModelOutput 而不是一个普通的元组。

返回

transformers.modeling_tf_outputs.TFBaseModelOutputWithPoolingAndNoAttention 或 tuple(tf.Tensor)

一个 transformers.modeling_tf_outputs.TFBaseModelOutputWithPoolingAndNoAttention 或一个 tf.Tensor 的元组(如果

return_dict=False 被传递或当 config.return_dict=False 时)包含各种元素,取决于

配置 (ResNetConfig) 和输入。

-

last_hidden_state (

tf.Tensor形状为(batch_size, num_channels, height, width)) — 模型最后一层输出的隐藏状态序列。 -

pooler_output (

tf.Tensor形状为(batch_size, hidden_size)) — 在空间维度上进行池化操作后的最后一层隐藏状态。 -

hidden_states (

tuple(tf.Tensor), 可选, 当output_hidden_states=True被传递或当config.output_hidden_states=True时返回) —tf.Tensor的元组(一个用于嵌入层的输出,如果模型有嵌入层,+ 一个用于 每层的输出)形状为(batch_size, num_channels, height, width)。模型在每层输出时的隐藏状态加上可选的初始嵌入输出。

TFResNetModel 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from transformers import AutoImageProcessor, TFResNetModel

>>> from datasets import load_dataset

>>> dataset = load_dataset("huggingface/cats-image", trust_remote_code=True)

>>> image = dataset["test"]["image"][0]

>>> image_processor = AutoImageProcessor.from_pretrained("microsoft/resnet-50")

>>> model = TFResNetModel.from_pretrained("microsoft/resnet-50")

>>> inputs = image_processor(image, return_tensors="tf")

>>> outputs = model(**inputs)

>>> last_hidden_states = outputs.last_hidden_state

>>> list(last_hidden_states.shape)

[1, 2048, 7, 7]TFResNetForImageClassification

类 transformers.TFResNetForImageClassification

< source >( config: ResNetConfig **kwargs )

参数

- config (ResNetConfig) — 包含模型所有参数的模型配置类。 使用配置文件初始化不会加载与模型相关的权重,只会加载配置。查看 from_pretrained() 方法以加载模型权重。

ResNet模型,顶部带有图像分类头(在池化特征之上的线性层),例如用于ImageNet。

该模型是一个 TensorFlow keras.layers.Layer 的子类。将其用作常规的 TensorFlow 模块,并参考 TensorFlow 文档以获取与一般使用和行为相关的所有信息。

调用

< source >( pixel_values: Tensor = None labels: Tensor = None output_hidden_states: bool = None return_dict: bool = None training: bool = False ) → transformers.modeling_tf_outputs.TFImageClassifierOutputWithNoAttention 或 tuple(tf.Tensor)

参数

- pixel_values (

tf.Tensorof shape(batch_size, num_channels, height, width)) — 像素值。像素值可以使用AutoImageProcessor获取。详情请参见 ConvNextImageProcessor.call(). - output_hidden_states (

bool, 可选) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量下的hidden_states。 - return_dict (

bool, 可选) — 是否返回一个ModelOutput而不是一个普通的元组。 - labels (

tf.Tensor形状为(batch_size,), 可选) — 用于计算图像分类/回归损失的标签。索引应在[0, ..., config.num_labels - 1]范围内。如果config.num_labels > 1,则计算分类损失(交叉熵)。

返回

transformers.modeling_tf_outputs.TFImageClassifierOutputWithNoAttention 或 tuple(tf.Tensor)

一个 transformers.modeling_tf_outputs.TFImageClassifierOutputWithNoAttention 或一个 tf.Tensor 元组(如果

return_dict=False 被传递或当 config.return_dict=False 时)包含各种元素,具体取决于

配置 (ResNetConfig) 和输入。

- loss (

tf.Tensor形状为(1,), 可选, 当提供labels时返回) — 分类(或回归,如果 config.num_labels==1)损失。 - logits (

tf.Tensor形状为(batch_size, config.num_labels)) — 分类(或回归,如果 config.num_labels==1)得分(在 SoftMax 之前)。 - hidden_states (

tuple(tf.Tensor), 可选, 当传递output_hidden_states=True或当config.output_hidden_states=True时返回) —tf.Tensor元组(一个用于嵌入层的输出,如果模型有嵌入层,+ 一个用于 每个阶段的输出)形状为(batch_size, num_channels, height, width)。模型在每个阶段输出的隐藏状态(也称为 特征图)。

TFResNetForImageClassification 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from transformers import AutoImageProcessor, TFResNetForImageClassification

>>> import tensorflow as tf

>>> from datasets import load_dataset

>>> dataset = load_dataset("huggingface/cats-image", trust_remote_code=True)

>>> image = dataset["test"]["image"][0]

>>> image_processor = AutoImageProcessor.from_pretrained("microsoft/resnet-50")

>>> model = TFResNetForImageClassification.from_pretrained("microsoft/resnet-50")

>>> inputs = image_processor(image, return_tensors="tf")

>>> logits = model(**inputs).logits

>>> # model predicts one of the 1000 ImageNet classes

>>> predicted_label = int(tf.math.argmax(logits, axis=-1))

>>> print(model.config.id2label[predicted_label])

tiger catFlaxResNetModel

类 transformers.FlaxResNetModel

< source >( config: ResNetConfig input_shape = (1, 224, 224, 3) seed: int = 0 dtype: dtype =

参数

- config (ResNetConfig) — 包含模型所有参数的模型配置类。 使用配置文件初始化不会加载与模型相关的权重,只会加载配置。查看 from_pretrained() 方法以加载模型权重。

- dtype (

jax.numpy.dtype, optional, defaults tojax.numpy.float32) — The data type of the computation. Can be one ofjax.numpy.float32,jax.numpy.float16(on GPUs) andjax.numpy.bfloat16(on TPUs).这可以用于在GPU或TPU上启用混合精度训练或半精度推理。如果指定,所有计算将使用给定的

dtype执行。请注意,这仅指定了计算的数据类型,并不影响模型参数的数据类型。

基本的ResNet模型输出原始特征,顶部没有任何特定的头部。

该模型继承自FlaxPreTrainedModel。请查看超类文档,了解库为其所有模型实现的通用方法(如下载、保存和从PyTorch模型转换权重)。

该模型也是一个 flax.linen.Module 子类。将其作为 常规的 Flax linen 模块使用,并参考 Flax 文档以获取与一般使用和行为相关的所有信息。

最后,该模型支持JAX的固有特性,例如:

__call__

< source >( pixel_values params: dict = None train: bool = False output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None ) → transformers.modeling_flax_outputs.FlaxBaseModelOutputWithPoolingAndNoAttention 或 tuple(torch.FloatTensor)

返回

transformers.modeling_flax_outputs.FlaxBaseModelOutputWithPoolingAndNoAttention 或 tuple(torch.FloatTensor)

一个 transformers.modeling_flax_outputs.FlaxBaseModelOutputWithPoolingAndNoAttention 或一个由

torch.FloatTensor 组成的元组(如果传递了 return_dict=False 或当 config.return_dict=False 时),包含各种

元素,具体取决于配置(

- last_hidden_state (

jnp.ndarray形状为(batch_size, num_channels, height, width)) — 模型最后一层输出的隐藏状态序列。 - pooler_output (

jnp.ndarray形状为(batch_size, hidden_size)) — 在空间维度上进行池化操作后的最后一层隐藏状态。 - hidden_states (

tuple(jnp.ndarray), 可选, 当传递了output_hidden_states=True或当config.output_hidden_states=True时返回) — 由jnp.ndarray组成的元组(一个用于嵌入层的输出,如果模型有嵌入层,+ 一个 用于每一层的输出)形状为(batch_size, num_channels, height, width)。模型在每一层输出处的隐藏状态加上可选的初始嵌入输出。

FlaxResNetPreTrainedModel 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from transformers import AutoImageProcessor, FlaxResNetModel

>>> from PIL import Image

>>> import requests

>>> url = "http://images.cocodataset.org/val2017/000000039769.jpg"

>>> image = Image.open(requests.get(url, stream=True).raw)

>>> image_processor = AutoImageProcessor.from_pretrained("microsoft/resnet-50")

>>> model = FlaxResNetModel.from_pretrained("microsoft/resnet-50")

>>> inputs = image_processor(images=image, return_tensors="np")

>>> outputs = model(**inputs)

>>> last_hidden_states = outputs.last_hidden_stateFlaxResNetForImageClassification

类 transformers.FlaxResNetForImageClassification

< source >( config: ResNetConfig input_shape = (1, 224, 224, 3) seed: int = 0 dtype: dtype =

参数

- config (ResNetConfig) — 包含模型所有参数的模型配置类。 使用配置文件初始化不会加载与模型相关的权重,只会加载配置。查看 from_pretrained() 方法以加载模型权重。

- dtype (

jax.numpy.dtype, optional, defaults tojax.numpy.float32) — The data type of the computation. Can be one ofjax.numpy.float32,jax.numpy.float16(on GPUs) andjax.numpy.bfloat16(on TPUs).这可以用于在GPU或TPU上启用混合精度训练或半精度推理。如果指定,所有计算将使用给定的

dtype执行。请注意,这仅指定了计算的数据类型,并不影响模型参数的数据类型。

ResNet模型,顶部带有图像分类头(在池化特征之上的线性层),例如用于ImageNet。

该模型继承自FlaxPreTrainedModel。请查看超类文档,了解库为其所有模型实现的通用方法(如下载、保存和从PyTorch模型转换权重)。

该模型也是一个 flax.linen.Module 子类。将其作为 常规的 Flax linen 模块使用,并参考 Flax 文档以获取与一般使用和行为相关的所有信息。

最后,该模型支持JAX的固有特性,例如:

__call__

< source >( pixel_values params: dict = None train: bool = False output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None ) → transformers.modeling_flax_outputs.FlaxImageClassifierOutputWithNoAttention 或 tuple(torch.FloatTensor)

返回

transformers.modeling_flax_outputs.FlaxImageClassifierOutputWithNoAttention 或 tuple(torch.FloatTensor)

一个 transformers.modeling_flax_outputs.FlaxImageClassifierOutputWithNoAttention 或一个由 torch.FloatTensor 组成的元组(如果传递了 return_dict=False 或当 config.return_dict=False 时),包含各种元素,具体取决于配置(

- logits (

jnp.ndarray形状为(batch_size, config.num_labels)) — 分类(或回归,如果 config.num_labels==1)得分(在 SoftMax 之前)。 - hidden_states (

tuple(jnp.ndarray), 可选, 当传递output_hidden_states=True或当config.output_hidden_states=True时返回): 由jnp.ndarray组成的元组(一个用于嵌入层的输出,如果模型有嵌入层,+ 一个用于每个阶段的输出)形状为(batch_size, num_channels, height, width)。模型在每个阶段输出的隐藏状态(也称为特征图)。

FlaxResNetPreTrainedModel 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from transformers import AutoImageProcessor, FlaxResNetForImageClassification

>>> from PIL import Image

>>> import jax

>>> import requests

>>> url = "http://images.cocodataset.org/val2017/000000039769.jpg"

>>> image = Image.open(requests.get(url, stream=True).raw)

>>> image_processor = AutoImageProcessor.from_pretrained("microsoft/resnet-50")

>>> model = FlaxResNetForImageClassification.from_pretrained("microsoft/resnet-50")

>>> inputs = image_processor(images=image, return_tensors="np")

>>> outputs = model(**inputs)

>>> logits = outputs.logits

>>> # model predicts one of the 1000 ImageNet classes

>>> predicted_class_idx = jax.numpy.argmax(logits, axis=-1)

>>> print("Predicted class:", model.config.id2label[predicted_class_idx.item()])