UPerNet

概述

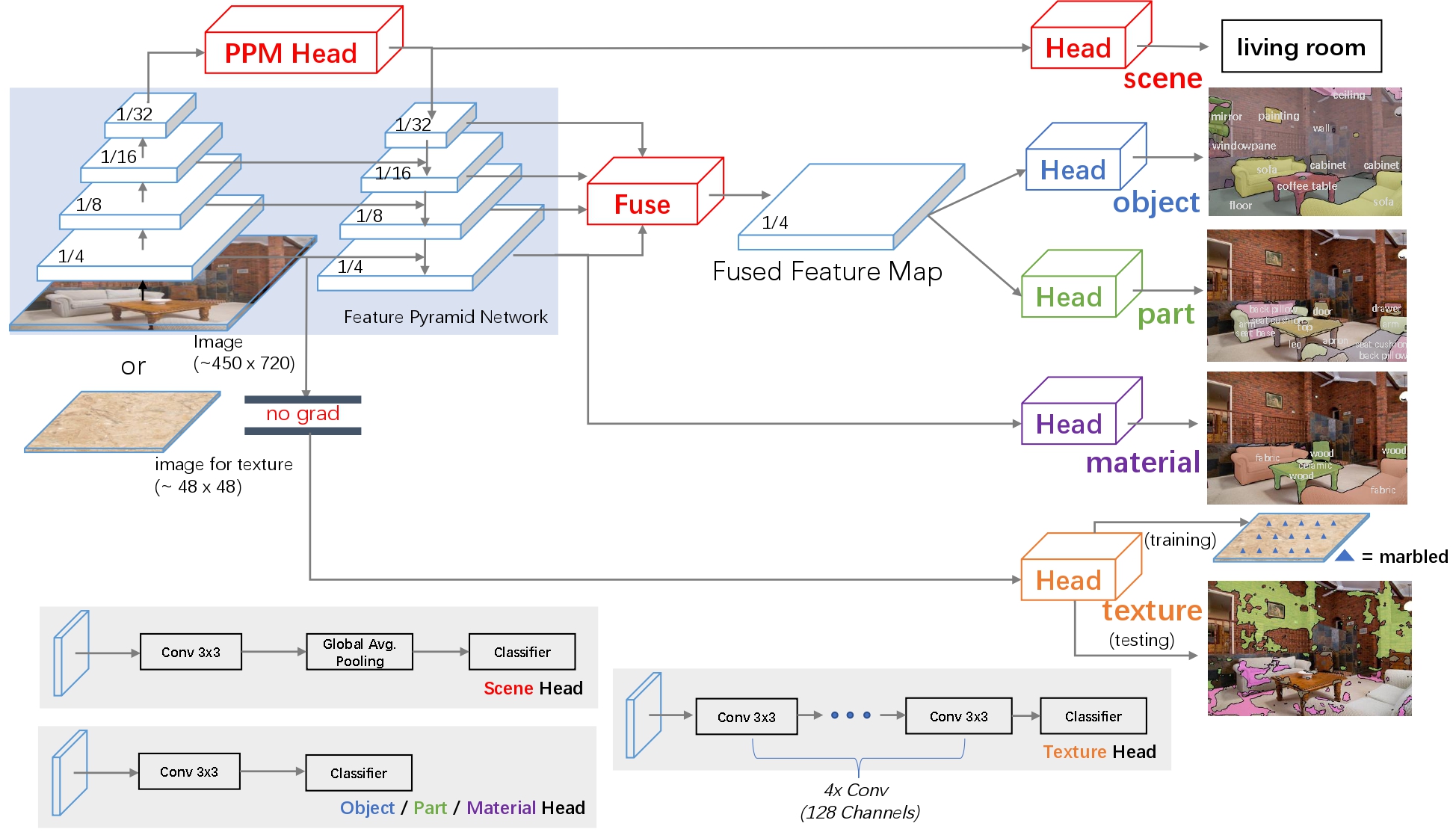

UPerNet模型由Tete Xiao、Yingcheng Liu、Bolei Zhou、Yuning Jiang和Jian Sun在《Unified Perceptual Parsing for Scene Understanding》中提出。UPerNet是一个通用框架,能够有效地从图像中分割出广泛的概念,利用任何视觉骨干网络,如ConvNeXt或Swin。

论文的摘要如下:

人类在多个层次上识别视觉世界:我们毫不费力地对场景进行分类并检测其中的物体,同时还能识别物体的纹理和表面以及它们的不同组成部分。在本文中,我们研究了一项名为统一感知解析的新任务,该任务要求机器视觉系统从给定图像中识别尽可能多的视觉概念。我们开发了一个名为UPerNet的多任务框架和一种训练策略,以从异构图像注释中学习。我们在统一感知解析上对我们的框架进行了基准测试,并表明它能够有效地从图像中分割出广泛的概念。训练后的网络进一步应用于发现自然场景中的视觉知识。

UPerNet framework. Taken from the original paper.

UPerNet framework. Taken from the original paper. 该模型由nielsr贡献。原始代码基于OpenMMLab的mmsegmentation 这里。

使用示例

UPerNet 是一个用于语义分割的通用框架。它可以与任何视觉骨干网络一起使用,如下所示:

from transformers import SwinConfig, UperNetConfig, UperNetForSemanticSegmentation

backbone_config = SwinConfig(out_features=["stage1", "stage2", "stage3", "stage4"])

config = UperNetConfig(backbone_config=backbone_config)

model = UperNetForSemanticSegmentation(config)要使用另一个视觉骨干网络,比如ConvNeXt,只需使用适当的骨干网络实例化模型:

from transformers import ConvNextConfig, UperNetConfig, UperNetForSemanticSegmentation

backbone_config = ConvNextConfig(out_features=["stage1", "stage2", "stage3", "stage4"])

config = UperNetConfig(backbone_config=backbone_config)

model = UperNetForSemanticSegmentation(config)请注意,这将随机初始化模型的所有权重。

资源

一份官方的Hugging Face和社区(由🌎表示)资源列表,帮助您开始使用UPerNet。

- UPerNet的演示笔记本可以在这里找到。

- UperNetForSemanticSegmentation 由这个 示例脚本 和 笔记本 支持。

- 另请参阅:语义分割任务指南

如果您有兴趣提交资源以包含在此处,请随时打开一个 Pull Request,我们将进行审核!理想情况下,资源应展示一些新内容,而不是重复现有资源。

UperNetConfig

类 transformers.UperNetConfig

< source >( backbone_config = 无 backbone = 无 use_pretrained_backbone = 假 use_timm_backbone = 假 backbone_kwargs = 无 hidden_size = 512 initializer_range = 0.02 pool_scales = [1, 2, 3, 6] use_auxiliary_head = 真 auxiliary_loss_weight = 0.4 auxiliary_in_channels = 384 auxiliary_channels = 256 auxiliary_num_convs = 1 auxiliary_concat_input = 假 loss_ignore_index = 255 **kwargs )

参数

- backbone_config (

PretrainedConfig或dict, 可选, 默认为ResNetConfig()) — 骨干模型的配置。 - backbone (

str, 可选) — 当backbone_config为None时使用的骨干网络名称。如果use_pretrained_backbone为True,这将从timm或transformers库加载相应的预训练权重。如果use_pretrained_backbone为False,这将加载骨干网络的配置并使用该配置初始化具有随机权重的骨干网络。 - use_pretrained_backbone (

bool, optional,False) — 是否使用预训练的权重作为骨干网络。 - use_timm_backbone (

bool, optional,False) — 是否从timm库加载backbone。如果为False,则从transformers库加载backbone。 - backbone_kwargs (

dict, 可选) — 从检查点加载时传递给AutoBackbone的关键字参数 例如{'out_indices': (0, 1, 2, 3)}。如果设置了backbone_config,则不能指定此参数。 - hidden_size (

int, optional, defaults to 512) — 卷积层中的隐藏单元数量。 - initializer_range (

float, optional, 默认为 0.02) — 用于初始化所有权重矩阵的 truncated_normal_initializer 的标准差。 - pool_scales (

Tuple[int], 可选, 默认为[1, 2, 3, 6]) — 在最后一个特征图上应用的池化金字塔模块中使用的池化比例。 - use_auxiliary_head (

bool, optional, defaults toTrue) — 是否在训练期间使用辅助头。 - auxiliary_loss_weight (

float, optional, defaults to 0.4) — 辅助头的交叉熵损失的权重。 - auxiliary_channels (

int, optional, 默认为 256) — 辅助头中使用的通道数。 - auxiliary_num_convs (

int, optional, defaults to 1) — 在辅助头中使用的卷积层数量。 - auxiliary_concat_input (

bool, optional, defaults toFalse) — 是否在分类层之前将辅助头的输出与输入连接起来。 - loss_ignore_index (

int, 可选, 默认为 255) — 损失函数忽略的索引。

这是用于存储UperNetForSemanticSegmentation配置的配置类。它用于根据指定的参数实例化一个UperNet模型,定义模型架构。使用默认值实例化配置将产生与UperNet openmmlab/upernet-convnext-tiny架构类似的配置。

配置对象继承自PretrainedConfig,可用于控制模型输出。阅读PretrainedConfig的文档以获取更多信息。

示例:

>>> from transformers import UperNetConfig, UperNetForSemanticSegmentation

>>> # Initializing a configuration

>>> configuration = UperNetConfig()

>>> # Initializing a model (with random weights) from the configuration

>>> model = UperNetForSemanticSegmentation(configuration)

>>> # Accessing the model configuration

>>> configuration = model.configUperNetForSemanticSegmentation

类 transformers.UperNetForSemanticSegmentation

< source >( config )

参数

- 这个 模型是一个 PyTorch [torch.nn.Module](https —//pytorch.org/docs/stable/nn.html#torch.nn.Module) 子类。使用

- it 作为一个常规的 PyTorch 模块,并参考 PyTorch 文档以获取与一般使用相关的所有事项和 —

- 行为。 — config (UperNetConfig): 包含模型所有参数的模型配置类。 使用配置文件初始化不会加载与模型相关的权重,只会加载配置。查看 from_pretrained() 方法以加载模型权重。

UperNet框架利用任何视觉骨干网络,例如用于ADE20k、CityScapes。

前进

< source >( pixel_values: typing.Optional[torch.Tensor] = None output_attentions: typing.Optional[bool] = None output_hidden_states: typing.Optional[bool] = None labels: typing.Optional[torch.Tensor] = None return_dict: typing.Optional[bool] = None ) → transformers.modeling_outputs.SemanticSegmenterOutput 或 tuple(torch.FloatTensor)

参数

- pixel_values (

torch.FloatTensorof shape(batch_size, num_channels, height, width)) — 像素值。默认情况下,如果您提供了填充,它将被忽略。像素值可以使用 AutoImageProcessor获取。详情请参见SegformerImageProcessor.call(). - output_attentions (

bool, 可选) — 是否返回所有注意力层的注意力张量,如果主干网络有这些张量。有关更多详细信息,请参见返回张量下的attentions。 - output_hidden_states (

bool, 可选) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量中的hidden_states。 - return_dict (

bool, 可选) — 是否返回一个 ModelOutput 而不是一个普通的元组。 - labels (

torch.LongTensorof shape(batch_size, height, width), optional) — 用于计算损失的真实语义分割图。索引应在[0, ..., config.num_labels - 1]范围内。如果config.num_labels > 1,则计算分类损失(交叉熵)。

返回

transformers.modeling_outputs.SemanticSegmenterOutput 或 tuple(torch.FloatTensor)

一个 transformers.modeling_outputs.SemanticSegmenterOutput 或一个由

torch.FloatTensor 组成的元组(如果传递了 return_dict=False 或当 config.return_dict=False 时),包含各种

元素,具体取决于配置(UperNetConfig)和输入。

-

loss (

torch.FloatTensor形状为(1,),可选,当提供labels时返回) — 分类(或回归,如果 config.num_labels==1)损失。 -

logits (

torch.FloatTensor形状为(batch_size, config.num_labels, logits_height, logits_width)) — 每个像素的分类分数。返回的 logits 不一定与作为输入传递的

pixel_values大小相同。这是 为了避免在用户需要将 logits 调整回原始图像大小时进行两次插值并损失一些质量。您应始终检查 logits 的形状并根据需要调整大小。 -

hidden_states (

tuple(torch.FloatTensor),可选,当传递output_hidden_states=True或当config.output_hidden_states=True时返回) — 由torch.FloatTensor组成的元组(一个用于嵌入层的输出,如果模型有嵌入层,+ 一个用于每层的输出)形状为(batch_size, patch_size, hidden_size)。模型在每层输出处的隐藏状态加上可选的初始嵌入输出。

-

attentions (

tuple(torch.FloatTensor),可选,当传递output_attentions=True或当config.output_attentions=True时返回) — 由torch.FloatTensor组成的元组(每层一个)形状为(batch_size, num_heads, patch_size, sequence_length)。注意力权重在注意力 softmax 之后,用于计算自注意力头中的加权平均值。

UperNetForSemanticSegmentation 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from transformers import AutoImageProcessor, UperNetForSemanticSegmentation

>>> from PIL import Image

>>> from huggingface_hub import hf_hub_download

>>> image_processor = AutoImageProcessor.from_pretrained("openmmlab/upernet-convnext-tiny")

>>> model = UperNetForSemanticSegmentation.from_pretrained("openmmlab/upernet-convnext-tiny")

>>> filepath = hf_hub_download(

... repo_id="hf-internal-testing/fixtures_ade20k", filename="ADE_val_00000001.jpg", repo_type="dataset"

... )

>>> image = Image.open(filepath).convert("RGB")

>>> inputs = image_processor(images=image, return_tensors="pt")

>>> outputs = model(**inputs)

>>> logits = outputs.logits # shape (batch_size, num_labels, height, width)

>>> list(logits.shape)

[1, 150, 512, 512]