OWLv2

概述

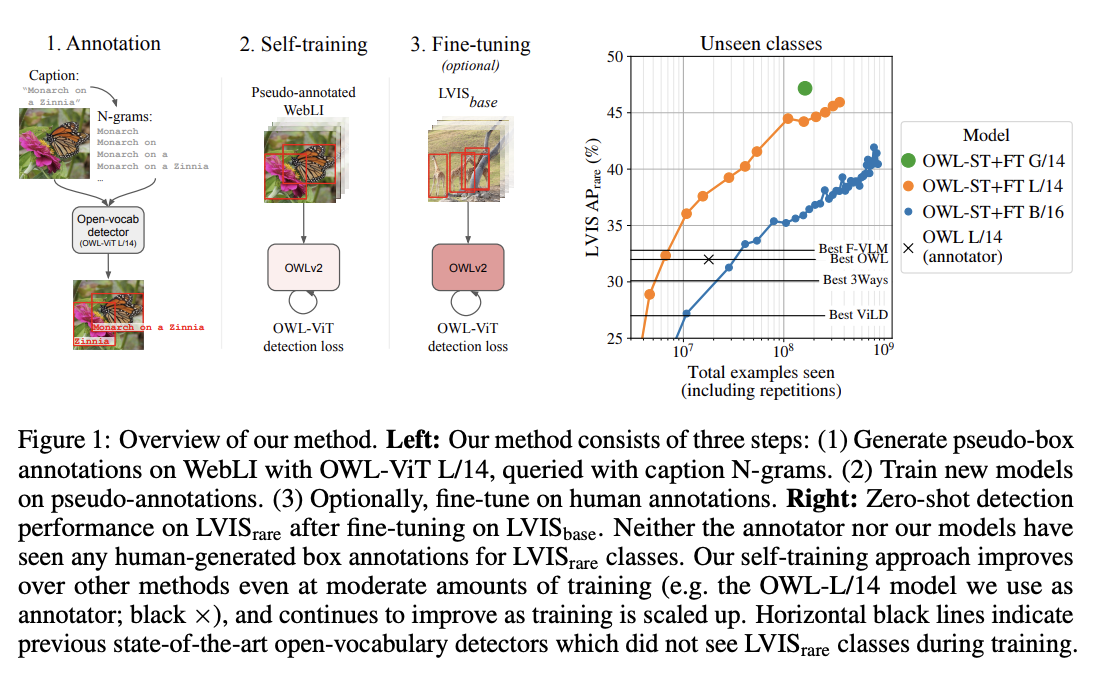

OWLv2 是由 Matthias Minderer、Alexey Gritsenko 和 Neil Houlsby 在 Scaling Open-Vocabulary Object Detection 中提出的。OWLv2 通过自训练扩展了 OWL-ViT,使用现有的检测器在图像-文本对上生成伪框注释。这使得在零样本目标检测方面取得了比之前最先进技术更大的进展。

论文的摘要如下:

开放词汇对象检测从预训练的视觉语言模型中受益匪浅,但仍然受到可用检测训练数据量的限制。虽然可以通过使用网络图像-文本对作为弱监督来扩展检测训练数据,但尚未达到与图像级预训练相当的规模。在这里,我们通过自训练扩展检测数据,自训练使用现有的检测器在图像-文本对上生成伪框注释。扩展自训练的主要挑战包括标签空间的选择、伪注释过滤和训练效率。我们提出了OWLv2模型和OWL-ST自训练方案,以应对这些挑战。OWLv2在可比的训练规模(约1000万个示例)下已经超越了之前最先进的开放词汇检测器的性能。然而,通过OWL-ST,我们可以扩展到超过10亿个示例,从而带来进一步的显著改进:使用L/14架构,OWL-ST将LVIS稀有类别的AP从31.2%提高到44.6%(相对改进43%),这些类别模型没有看到任何人类框注释。OWL-ST为开放世界定位解锁了网络规模的训练,类似于图像分类和语言建模所见的规模。

OWLv2 high-level overview. Taken from the original paper.

OWLv2 high-level overview. Taken from the original paper. 使用示例

OWLv2 与其前身 OWL-ViT 一样,是一个零样本文本条件目标检测模型。OWL-ViT 使用 CLIP 作为其多模态骨干网络,使用类似 ViT 的 Transformer 获取视觉特征,并使用因果语言模型获取文本特征。为了将 CLIP 用于检测,OWL-ViT 移除了视觉模型的最终令牌池化层,并在每个 Transformer 输出令牌上附加了一个轻量级的分类和边界框头。通过用从文本模型获得的类名嵌入替换固定的分类层权重,实现了开放词汇分类。作者首先从头开始训练 CLIP,并使用二分匹配损失在标准检测数据集上对分类和边界框头进行端到端微调。每张图像可以使用一个或多个文本查询来执行零样本文本条件目标检测。

Owlv2ImageProcessor 可以用于调整(或重新缩放)和归一化模型的图像,而 CLIPTokenizer 用于编码文本。Owlv2Processor 将 Owlv2ImageProcessor 和 CLIPTokenizer 包装成一个实例,以便同时编码文本和准备图像。以下示例展示了如何使用 Owlv2Processor 和 Owlv2ForObjectDetection 执行对象检测。

>>> import requests

>>> from PIL import Image

>>> import torch

>>> from transformers import Owlv2Processor, Owlv2ForObjectDetection

>>> processor = Owlv2Processor.from_pretrained("google/owlv2-base-patch16-ensemble")

>>> model = Owlv2ForObjectDetection.from_pretrained("google/owlv2-base-patch16-ensemble")

>>> url = "http://images.cocodataset.org/val2017/000000039769.jpg"

>>> image = Image.open(requests.get(url, stream=True).raw)

>>> texts = [["a photo of a cat", "a photo of a dog"]]

>>> inputs = processor(text=texts, images=image, return_tensors="pt")

>>> outputs = model(**inputs)

>>> # Target image sizes (height, width) to rescale box predictions [batch_size, 2]

>>> target_sizes = torch.Tensor([image.size[::-1]])

>>> # Convert outputs (bounding boxes and class logits) to Pascal VOC Format (xmin, ymin, xmax, ymax)

>>> results = processor.post_process_object_detection(outputs=outputs, target_sizes=target_sizes, threshold=0.1)

>>> i = 0 # Retrieve predictions for the first image for the corresponding text queries

>>> text = texts[i]

>>> boxes, scores, labels = results[i]["boxes"], results[i]["scores"], results[i]["labels"]

>>> for box, score, label in zip(boxes, scores, labels):

... box = [round(i, 2) for i in box.tolist()]

... print(f"Detected {text[label]} with confidence {round(score.item(), 3)} at location {box}")

Detected a photo of a cat with confidence 0.614 at location [341.67, 23.39, 642.32, 371.35]

Detected a photo of a cat with confidence 0.665 at location [6.75, 51.96, 326.62, 473.13]资源

- 一个关于使用OWLv2进行零样本和单样本(图像引导)目标检测的演示笔记本可以在这里找到。

- 零样本目标检测任务指南

OWLv2的架构与OWL-ViT相同,但目标检测头现在还包括一个物体分类器,它预测一个预测框包含物体(与背景相对)的(与查询无关的)可能性。物体得分可以用于独立于文本查询对预测进行排序或过滤。 OWLv2的使用与OWL-ViT相同,但使用了新的、更新的图像处理器(Owlv2ImageProcessor)。

Owlv2Config

类 transformers.Owlv2Config

< source >( text_config = None vision_config = None projection_dim = 512 logit_scale_init_value = 2.6592 return_dict = True **kwargs )

参数

- text_config (

dict, optional) — 用于初始化 Owlv2TextConfig 的配置选项字典。 - vision_config (

dict, 可选) — 用于初始化 Owlv2VisionConfig 的配置选项字典. - projection_dim (

int, optional, 默认为 512) — 文本和视觉投影层的维度. - logit_scale_init_value (

float, optional, 默认为 2.6592) — logit_scale 参数的初始值。默认值按照原始 OWLv2 实现使用。 - return_dict (

bool, 可选, 默认为True) — 模型是否应返回字典。如果False,则返回一个元组。 - kwargs (可选) — 关键字参数字典。

Owlv2Config 是用于存储 Owlv2Model 配置的配置类。它用于根据指定的参数实例化一个 OWLv2 模型,定义文本模型和视觉模型的配置。使用默认值实例化配置将产生与 OWLv2 google/owlv2-base-patch16 架构相似的配置。

配置对象继承自PretrainedConfig,可用于控制模型输出。阅读PretrainedConfig的文档以获取更多信息。

from_text_vision_configs

< source >( text_config: typing.Dict vision_config: typing.Dict **kwargs ) → Owlv2Config

从owlv2文本模型配置和owlv2视觉模型配置实例化一个Owlv2Config(或派生类)。

Owlv2TextConfig

类 transformers.Owlv2TextConfig

< source >( vocab_size = 49408 hidden_size = 512 intermediate_size = 2048 num_hidden_layers = 12 num_attention_heads = 8 max_position_embeddings = 16 hidden_act = 'quick_gelu' layer_norm_eps = 1e-05 attention_dropout = 0.0 initializer_range = 0.02 initializer_factor = 1.0 pad_token_id = 0 bos_token_id = 49406 eos_token_id = 49407 **kwargs )

参数

- vocab_size (

int, 可选, 默认为 49408) — OWLv2 文本模型的词汇表大小。定义了在调用 Owlv2TextModel 时传递的inputs_ids可以表示的不同标记的数量。 - hidden_size (

int, optional, 默认为 512) — 编码器层和池化层的维度。 - intermediate_size (

int, optional, 默认为 2048) — Transformer 编码器中“中间”(即前馈)层的维度。 - num_hidden_layers (

int, optional, 默认为 12) — Transformer 编码器中的隐藏层数量。 - num_attention_heads (

int, optional, 默认为 8) — Transformer 编码器中每个注意力层的注意力头数量。 - max_position_embeddings (

int, optional, 默认为 16) — 此模型可能使用的最大序列长度。通常将其设置为较大的值以防万一(例如,512 或 1024 或 2048)。 - hidden_act (

str或function, 可选, 默认为"quick_gelu") — 编码器和池化器中的非线性激活函数(函数或字符串)。如果是字符串,支持"gelu","relu","selu"和"gelu_new""quick_gelu". - layer_norm_eps (

float, optional, defaults to 1e-05) — 层归一化层使用的epsilon值。 - attention_dropout (

float, optional, defaults to 0.0) — 注意力概率的丢弃比率。 - initializer_range (

float, 可选, 默认为 0.02) — 用于初始化所有权重矩阵的截断正态初始化器的标准差。 - initializer_factor (

float, 可选, 默认为 1.0) — 用于初始化所有权重矩阵的因子(应保持为1,内部用于初始化测试)。 - pad_token_id (

int, optional, defaults to 0) — 输入序列中填充标记的id. - bos_token_id (

int, optional, defaults to 49406) — 输入序列中开始序列标记的id. - eos_token_id (

int, optional, defaults to 49407) — 输入序列中结束序列标记的id。

这是用于存储Owlv2TextModel配置的配置类。它用于根据指定的参数实例化Owlv2文本编码器,定义模型架构。使用默认值实例化配置将产生与Owlv2 google/owlv2-base-patch16架构类似的配置。

配置对象继承自PretrainedConfig,可用于控制模型输出。阅读PretrainedConfig的文档以获取更多信息。

示例:

>>> from transformers import Owlv2TextConfig, Owlv2TextModel

>>> # Initializing a Owlv2TextModel with google/owlv2-base-patch16 style configuration

>>> configuration = Owlv2TextConfig()

>>> # Initializing a Owlv2TextConfig from the google/owlv2-base-patch16 style configuration

>>> model = Owlv2TextModel(configuration)

>>> # Accessing the model configuration

>>> configuration = model.configOwlv2VisionConfig

类 transformers.Owlv2VisionConfig

< source >( hidden_size = 768 intermediate_size = 3072 num_hidden_layers = 12 num_attention_heads = 12 num_channels = 3 image_size = 768 patch_size = 16 hidden_act = 'quick_gelu' layer_norm_eps = 1e-05 attention_dropout = 0.0 initializer_range = 0.02 initializer_factor = 1.0 **kwargs )

参数

- hidden_size (

int, optional, 默认为 768) — 编码器层和池化层的维度。 - intermediate_size (

int, optional, 默认为 3072) — Transformer 编码器中“中间”(即前馈)层的维度。 - num_hidden_layers (

int, optional, 默认为 12) — Transformer 编码器中的隐藏层数量。 - num_attention_heads (

int, optional, defaults to 12) — Transformer编码器中每个注意力层的注意力头数。 - num_channels (

int, optional, defaults to 3) — 输入图像中的通道数。 - image_size (

int, optional, 默认为 768) — 每张图像的尺寸(分辨率)。 - patch_size (

int, optional, defaults to 16) — 每个补丁的大小(分辨率)。 - hidden_act (

str或function, 可选, 默认为"quick_gelu") — 编码器和池化器中的非线性激活函数(函数或字符串)。如果是字符串,支持"gelu","relu","selu"和"gelu_new""quick_gelu". - layer_norm_eps (

float, optional, defaults to 1e-05) — 层归一化层使用的epsilon值。 - attention_dropout (

float, optional, defaults to 0.0) — 注意力概率的丢弃比率。 - initializer_range (

float, 可选, 默认为 0.02) — 用于初始化所有权重矩阵的截断正态初始化器的标准差。 - initializer_factor (

float, 可选, 默认为 1.0) — 用于初始化所有权重矩阵的因子(应保持为1,内部用于初始化测试)。

这是用于存储Owlv2VisionModel配置的配置类。它用于根据指定的参数实例化OWLv2图像编码器,定义模型架构。使用默认值实例化配置将产生与OWLv2 google/owlv2-base-patch16架构类似的配置。

配置对象继承自PretrainedConfig,可用于控制模型输出。阅读PretrainedConfig的文档以获取更多信息。

示例:

>>> from transformers import Owlv2VisionConfig, Owlv2VisionModel

>>> # Initializing a Owlv2VisionModel with google/owlv2-base-patch16 style configuration

>>> configuration = Owlv2VisionConfig()

>>> # Initializing a Owlv2VisionModel model from the google/owlv2-base-patch16 style configuration

>>> model = Owlv2VisionModel(configuration)

>>> # Accessing the model configuration

>>> configuration = model.configOwlv2ImageProcessor

类 transformers.Owlv2ImageProcessor

< source >( do_rescale: bool = True rescale_factor: typing.Union[int, float] = 0.00392156862745098 do_pad: bool = True do_resize: bool = True size: typing.Dict[str, int] = None resample: Resampling =

参数

- do_rescale (

bool, 可选, 默认为True) — 是否通过指定的比例rescale_factor重新缩放图像。可以在preprocess方法中被do_rescale覆盖。 - rescale_factor (

int或float, 可选, 默认为1/255) — 如果重新缩放图像,则使用的缩放因子。可以在preprocess方法中被rescale_factor覆盖。 - do_pad (

bool, 可选, 默认为True) — 是否将图像填充为正方形,底部和右侧填充灰色像素。可以在preprocess方法中通过do_pad覆盖此设置。 - do_resize (

bool, 可选, 默认为True) — 控制是否将图像的(高度,宽度)尺寸调整为指定的size。可以在preprocess方法中通过do_resize进行覆盖。 - size (

Dict[str, int]可选, 默认为{"height" -- 960, "width": 960}): 调整图像的大小。可以在preprocess方法中通过size覆盖此设置。 - resample (

PILImageResampling, 可选, 默认为Resampling.BILINEAR) — 如果调整图像大小,使用的重采样方法。可以在preprocess方法中通过resample覆盖此设置。 - do_normalize (

bool, 可选, 默认为True) — 是否对图像进行归一化。可以在preprocess方法中通过do_normalize参数进行覆盖。 - image_mean (

float或List[float], 可选, 默认为OPENAI_CLIP_MEAN) — 如果对图像进行归一化,则使用的均值。这是一个浮点数或与图像通道数长度相同的浮点数列表。可以通过preprocess方法中的image_mean参数进行覆盖。 - image_std (

float或List[float], 可选, 默认为OPENAI_CLIP_STD) — 如果对图像进行归一化,则使用的标准差。这是一个浮点数或与图像通道数长度相同的浮点数列表。可以在preprocess方法中通过image_std参数进行覆盖。

构建一个OWLv2图像处理器。

预处理

< source >( images: typing.Union[ForwardRef('PIL.Image.Image'), numpy.ndarray, ForwardRef('torch.Tensor'), typing.List[ForwardRef('PIL.Image.Image')], typing.List[numpy.ndarray], typing.List[ForwardRef('torch.Tensor')]] do_pad: bool = None do_resize: bool = None size: typing.Dict[str, int] = None do_rescale: bool = None rescale_factor: float = None do_normalize: bool = None image_mean: typing.Union[float, typing.List[float], NoneType] = None image_std: typing.Union[float, typing.List[float], NoneType] = None return_tensors: typing.Union[str, transformers.utils.generic.TensorType, NoneType] = None data_format: ChannelDimension =

参数

- 图像 (

ImageInput) — 要预处理的图像。期望输入单个或批量的图像,像素值范围在0到255之间。如果传入的图像像素值在0到1之间,请设置do_rescale=False. - do_pad (

bool, 可选, 默认为self.do_pad) — 是否将图像填充为正方形,并在底部和右侧填充灰色像素。 - do_resize (

bool, optional, defaults toself.do_resize) — 是否调整图像大小. - size (

Dict[str, int], 可选, 默认为self.size) — 调整图像的大小。 - do_rescale (

bool, optional, defaults toself.do_rescale) — 是否将图像值缩放到 [0 - 1] 之间。 - rescale_factor (

float, optional, defaults toself.rescale_factor) — 如果do_rescale设置为True,则用于重新缩放图像的重新缩放因子。 - do_normalize (

bool, optional, defaults toself.do_normalize) — 是否对图像进行归一化处理。 - image_mean (

float或List[float], 可选, 默认为self.image_mean) — 图像均值. - image_std (

float或List[float], 可选, 默认为self.image_std) — 图像标准差. - return_tensors (

str或TensorType, 可选) — 返回的张量类型。可以是以下之一:- 未设置:返回一个

np.ndarray列表。 TensorType.TENSORFLOW或'tf':返回一个类型为tf.Tensor的批次。TensorType.PYTORCH或'pt':返回一个类型为torch.Tensor的批次。TensorType.NUMPY或'np':返回一个类型为np.ndarray的批次。TensorType.JAX或'jax':返回一个类型为jax.numpy.ndarray的批次。

- 未设置:返回一个

- data_format (

ChannelDimension或str, 可选, 默认为ChannelDimension.FIRST) — 输出图像的通道维度格式。可以是以下之一:"channels_first"或ChannelDimension.FIRST: 图像格式为 (num_channels, height, width)。"channels_last"或ChannelDimension.LAST: 图像格式为 (height, width, num_channels)。- 未设置:使用输入图像的通道维度格式。

- input_data_format (

ChannelDimension或str, 可选) — 输入图像的通道维度格式。如果未设置,则从输入图像推断通道维度格式。可以是以下之一:"channels_first"或ChannelDimension.FIRST: 图像格式为 (num_channels, height, width)。"channels_last"或ChannelDimension.LAST: 图像格式为 (height, width, num_channels)。"none"或ChannelDimension.NONE: 图像格式为 (height, width)。

预处理一张图像或一批图像。

post_process_object_detection

< source >( outputs threshold: float = 0.1 target_sizes: typing.Union[transformers.utils.generic.TensorType, typing.List[typing.Tuple]] = None ) → List[Dict]

将OwlViTForObjectDetection的原始输出转换为最终边界框,格式为(左上角x,左上角y,右下角x,右下角y)。

post_process_image_guided_detection

< source >( outputs threshold = 0.0 nms_threshold = 0.3 target_sizes = None ) → List[Dict]

参数

- 输出 (

OwlViTImageGuidedObjectDetectionOutput) — 模型的原始输出。 - threshold (

float, optional, defaults to 0.0) — 用于过滤预测框的最小置信度阈值。 - nms_threshold (

float, optional, defaults to 0.3) — 用于非最大抑制重叠框的IoU阈值。 - target_sizes (

torch.Tensor, 可选) — 形状为 (batch_size, 2) 的张量,其中每个条目是批次中相应图像的 (高度, 宽度)。如果设置,预测的归一化边界框将重新缩放到目标大小。如果留空为 None,预测将不会进行反归一化。

返回

List[Dict]

一个字典列表,每个字典包含模型预测的批次中图像的分数、标签和框。所有标签都设置为None,因为OwlViTForObjectDetection.image_guided_detection执行一次性目标检测。

将OwlViTForObjectDetection.image_guided_detection()的输出转换为COCO API所期望的格式。

Owlv2Processor

类 transformers.Owlv2Processor

< source >( image_processor tokenizer **kwargs )

参数

- image_processor (Owlv2ImageProcessor) — 图像处理器是一个必需的输入。

- tokenizer ([

CLIPTokenizer,CLIPTokenizerFast]) — tokenizer 是一个必需的输入。

构建一个Owlv2处理器,它将Owlv2ImageProcessor和CLIPTokenizer/CLIPTokenizerFast包装成一个单一的处理器,该处理器继承了图像处理器和分词器的功能。有关更多信息,请参见__call__()和decode()。

此方法将其所有参数转发给CLIPTokenizerFast的batch_decode()。请参考该方法的文档字符串以获取更多信息。

此方法将其所有参数转发给CLIPTokenizerFast的decode()。请参考该方法的文档字符串以获取更多信息。

此方法将其所有参数转发给OwlViTImageProcessor.post_process_one_shot_object_detection。

请参阅此方法的文档字符串以获取更多信息。

此方法将其所有参数转发给OwlViTImageProcessor.post_process_object_detection()。请参考该方法的文档字符串以获取更多信息。

Owlv2Model

类 transformers.Owlv2Model

< source >( config: Owlv2Config )

参数

- config (

Owvl2Config) — 包含模型所有参数的模型配置类。 使用配置文件初始化不会加载与模型相关的权重,只会加载配置。查看 from_pretrained() 方法以加载模型权重。

该模型继承自PreTrainedModel。请查看超类文档以了解库为其所有模型实现的通用方法(如下载或保存、调整输入嵌入的大小、修剪头部等)。

该模型也是一个PyTorch torch.nn.Module 子类。 将其作为常规的PyTorch模块使用,并参考PyTorch文档以获取与一般使用和行为相关的所有信息。

前进

< source >( input_ids: typing.Optional[torch.LongTensor] = None pixel_values: typing.Optional[torch.FloatTensor] = None attention_mask: typing.Optional[torch.Tensor] = None return_loss: typing.Optional[bool] = None output_attentions: typing.Optional[bool] = None output_hidden_states: typing.Optional[bool] = None return_base_image_embeds: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None ) → transformers.models.owlv2.modeling_owlv2.Owlv2Output 或 tuple(torch.FloatTensor)

参数

- input_ids (

torch.LongTensorof shape(batch_size, sequence_length)) — 词汇表中输入序列标记的索引。可以使用AutoTokenizer获取索引。详情请参见 PreTrainedTokenizer.encode() 和 PreTrainedTokenizer.call()。什么是输入 ID? - pixel_values (

torch.FloatTensorof shape(batch_size, num_channels, height, width)) — 像素值. - attention_mask (

torch.Tensorof shape(batch_size, sequence_length), optional) — 用于避免在填充标记索引上执行注意力的掩码。掩码值在[0, 1]中选择:- 1 表示 未掩码 的标记,

- 0 表示 掩码 的标记。 什么是注意力掩码?

- return_loss (

bool, optional) — 是否返回对比损失。 - output_attentions (

bool, 可选) — 是否返回所有注意力层的注意力张量。有关更多详细信息,请参见返回张量下的attentions。 - output_hidden_states (

bool, 可选) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量下的hidden_states。 - return_base_image_embeds (

bool, optional) — 是否返回基础图像嵌入。 - return_dict (

bool, 可选) — 是否返回一个 ModelOutput 而不是一个普通的元组。

返回

transformers.models.owlv2.modeling_owlv2.Owlv2Output 或 tuple(torch.FloatTensor)

一个 transformers.models.owlv2.modeling_owlv2.Owlv2Output 或一个由

torch.FloatTensor 组成的元组(如果传递了 return_dict=False 或当 config.return_dict=False 时),包含各种

元素,取决于配置(

- loss (

torch.FloatTensor形状为(1,),可选,当return_loss为True时返回) — 图像-文本相似度的对比损失。 - logits_per_image (

torch.FloatTensor形状为(image_batch_size, text_batch_size)) —image_embeds和text_embeds之间的缩放点积分数。这表示图像-文本 相似度分数。 - logits_per_text (

torch.FloatTensor形状为(text_batch_size, image_batch_size)) —text_embeds和image_embeds之间的缩放点积分数。这表示文本-图像 相似度分数。 - text_embeds (

torch.FloatTensor形状为(batch_size * num_max_text_queries, output_dim) — 通过将投影层应用于 Owlv2TextModel 的池化输出获得的文本嵌入。 - image_embeds (

torch.FloatTensor形状为(batch_size, output_dim) — 通过将投影层应用于 Owlv2VisionModel 的池化输出获得的图像嵌入。 - text_model_output (Tuple

BaseModelOutputWithPooling) — Owlv2TextModel 的输出。 - vision_model_output (

BaseModelOutputWithPooling) — Owlv2VisionModel 的输出。

Owlv2Model 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from PIL import Image

>>> import requests

>>> from transformers import AutoProcessor, Owlv2Model

>>> model = Owlv2Model.from_pretrained("google/owlv2-base-patch16-ensemble")

>>> processor = AutoProcessor.from_pretrained("google/owlv2-base-patch16-ensemble")

>>> url = "http://images.cocodataset.org/val2017/000000039769.jpg"

>>> image = Image.open(requests.get(url, stream=True).raw)

>>> inputs = processor(text=[["a photo of a cat", "a photo of a dog"]], images=image, return_tensors="pt")

>>> outputs = model(**inputs)

>>> logits_per_image = outputs.logits_per_image # this is the image-text similarity score

>>> probs = logits_per_image.softmax(dim=1) # we can take the softmax to get the label probabilitiesget_text_features

< source >( input_ids: typing.Optional[torch.Tensor] = None attention_mask: typing.Optional[torch.Tensor] = None output_attentions: typing.Optional[bool] = None output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None ) → 文本特征 (torch.FloatTensor 形状为 (batch_size, output_dim)

参数

- input_ids (

torch.LongTensorof shape(batch_size * num_max_text_queries, sequence_length)) — 词汇表中输入序列标记的索引。可以使用AutoTokenizer获取索引。详情请参见 PreTrainedTokenizer.encode() 和 PreTrainedTokenizer.call()。什么是输入ID? - attention_mask (

torch.Tensorof shape(batch_size, num_max_text_queries, sequence_length), optional) — 用于避免在填充标记索引上执行注意力的掩码。掩码值在[0, 1]中选择:- 1 表示 未掩码 的标记,

- 0 表示 掩码 的标记。 什么是注意力掩码?

- output_attentions (

bool, 可选) — 是否返回所有注意力层的注意力张量。有关更多详细信息,请参见返回张量中的attentions。 - output_hidden_states (

bool, optional) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量下的hidden_states。 - return_dict (

bool, 可选) — 是否返回一个 ModelOutput 而不是一个普通的元组。

返回

文本特征 (torch.FloatTensor 形状为 (batch_size, output_dim)

通过将投影层应用于Owlv2TextModel的池化输出获得的文本嵌入。

Owlv2Model 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from transformers import AutoProcessor, Owlv2Model

>>> model = Owlv2Model.from_pretrained("google/owlv2-base-patch16-ensemble")

>>> processor = AutoProcessor.from_pretrained("google/owlv2-base-patch16-ensemble")

>>> inputs = processor(

... text=[["a photo of a cat", "a photo of a dog"], ["photo of a astranaut"]], return_tensors="pt"

... )

>>> text_features = model.get_text_features(**inputs)get_image_features

< source >( pixel_values: typing.Optional[torch.FloatTensor] = None output_attentions: typing.Optional[bool] = None output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None ) → 图像特征 (torch.FloatTensor 形状为 (batch_size, output_dim)

参数

- pixel_values (

torch.FloatTensorof shape(batch_size, num_channels, height, width)) — 像素值. - output_attentions (

bool, 可选) — 是否返回所有注意力层的注意力张量。有关更多详细信息,请参见返回张量下的attentions。 - output_hidden_states (

bool, 可选) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量下的hidden_states。 - return_dict (

bool, 可选) — 是否返回一个ModelOutput而不是一个普通的元组。

返回

图像特征 (torch.FloatTensor 形状为 (batch_size, output_dim)

通过将投影层应用于Owlv2VisionModel的池化输出获得的图像嵌入。

Owlv2Model 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from PIL import Image

>>> import requests

>>> from transformers import AutoProcessor, Owlv2Model

>>> model = Owlv2Model.from_pretrained("google/owlv2-base-patch16-ensemble")

>>> processor = AutoProcessor.from_pretrained("google/owlv2-base-patch16-ensemble")

>>> url = "http://images.cocodataset.org/val2017/000000039769.jpg"

>>> image = Image.open(requests.get(url, stream=True).raw)

>>> inputs = processor(images=image, return_tensors="pt")

>>> image_features = model.get_image_features(**inputs)Owlv2TextModel

前进

< source >( input_ids: Tensor attention_mask: typing.Optional[torch.Tensor] = None output_attentions: typing.Optional[bool] = None output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None ) → transformers.modeling_outputs.BaseModelOutputWithPooling 或 tuple(torch.FloatTensor)

参数

- input_ids (

torch.LongTensor形状为(batch_size * num_max_text_queries, sequence_length)) — 词汇表中输入序列标记的索引。可以使用 AutoTokenizer 获取索引。详情请参见 PreTrainedTokenizer.encode() 和 PreTrainedTokenizer.call()。什么是输入ID? - attention_mask (

torch.Tensor形状为(batch_size, num_max_text_queries, sequence_length), 可选) — 用于避免在填充标记索引上执行注意力的掩码。掩码值在[0, 1]中选择:- 1 表示 未掩码 的标记,

- 0 表示 掩码 的标记。 什么是注意力掩码?

- output_attentions (

bool, 可选) — 是否返回所有注意力层的注意力张量。有关更多详细信息,请参见返回张量下的attentions。 - output_hidden_states (

bool, 可选) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量下的hidden_states。 - return_dict (

bool, 可选) — 是否返回一个 ModelOutput 而不是一个普通的元组。

返回

transformers.modeling_outputs.BaseModelOutputWithPooling 或 tuple(torch.FloatTensor)

一个 transformers.modeling_outputs.BaseModelOutputWithPooling 或一个由

torch.FloatTensor 组成的元组(如果传递了 return_dict=False 或当 config.return_dict=False 时),包含各种

元素,具体取决于配置(

-

last_hidden_state (

torch.FloatTensor形状为(batch_size, sequence_length, hidden_size)) — 模型最后一层输出的隐藏状态序列。 -

pooler_output (

torch.FloatTensor形状为(batch_size, hidden_size)) — 序列的第一个标记(分类标记)在经过用于辅助预训练任务的层进一步处理后的最后一层隐藏状态。例如,对于BERT系列模型,这返回经过线性层和tanh激活函数处理后的分类标记。线性层的权重是在预训练期间通过下一个句子预测(分类)目标训练的。 -

hidden_states (

tuple(torch.FloatTensor), 可选, 当传递了output_hidden_states=True或当config.output_hidden_states=True时返回) — 由torch.FloatTensor组成的元组(一个用于嵌入层的输出,如果模型有嵌入层,+ 一个用于每一层的输出)形状为(batch_size, sequence_length, hidden_size)。模型在每一层输出处的隐藏状态加上可选的初始嵌入输出。

-

attentions (

tuple(torch.FloatTensor), 可选, 当传递了output_attentions=True或当config.output_attentions=True时返回) — 由torch.FloatTensor组成的元组(每一层一个)形状为(batch_size, num_heads, sequence_length, sequence_length)。注意力权重在注意力softmax之后,用于计算自注意力头中的加权平均值。

Owlv2TextModel 的 forward 方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from transformers import AutoProcessor, Owlv2TextModel

>>> model = Owlv2TextModel.from_pretrained("google/owlv2-base-patch16")

>>> processor = AutoProcessor.from_pretrained("google/owlv2-base-patch16")

>>> inputs = processor(

... text=[["a photo of a cat", "a photo of a dog"], ["photo of a astranaut"]], return_tensors="pt"

... )

>>> outputs = model(**inputs)

>>> last_hidden_state = outputs.last_hidden_state

>>> pooled_output = outputs.pooler_output # pooled (EOS token) statesOwlv2VisionModel

前进

< source >( pixel_values: typing.Optional[torch.FloatTensor] = None output_attentions: typing.Optional[bool] = None output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None ) → transformers.modeling_outputs.BaseModelOutputWithPooling 或 tuple(torch.FloatTensor)

参数

- pixel_values (

torch.FloatTensorof shape(batch_size, num_channels, height, width)) — 像素值. - output_attentions (

bool, optional) — 是否返回所有注意力层的注意力张量。有关更多详细信息,请参见返回张量下的attentions。 - output_hidden_states (

bool, 可选) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量下的hidden_states。 - return_dict (

bool, 可选) — 是否返回一个ModelOutput而不是一个普通的元组。

返回

transformers.modeling_outputs.BaseModelOutputWithPooling 或 tuple(torch.FloatTensor)

一个 transformers.modeling_outputs.BaseModelOutputWithPooling 或一个由

torch.FloatTensor 组成的元组(如果传递了 return_dict=False 或当 config.return_dict=False 时),包含各种

元素,具体取决于配置(

-

last_hidden_state (

torch.FloatTensor形状为(batch_size, sequence_length, hidden_size)) — 模型最后一层输出的隐藏状态序列。 -

pooler_output (

torch.FloatTensor形状为(batch_size, hidden_size)) — 序列的第一个标记(分类标记)在经过用于辅助预训练任务的层进一步处理后的最后一层隐藏状态。例如,对于BERT系列模型,这返回经过线性层和tanh激活函数处理后的分类标记。线性层的权重是在预训练期间通过下一个句子预测(分类)目标训练的。 -

hidden_states (

tuple(torch.FloatTensor), 可选, 当传递output_hidden_states=True或当config.output_hidden_states=True时返回) — 由torch.FloatTensor组成的元组(一个用于嵌入层的输出,如果模型有嵌入层,+ 一个用于每一层的输出)形状为(batch_size, sequence_length, hidden_size)。模型在每一层输出处的隐藏状态加上可选的初始嵌入输出。

-

attentions (

tuple(torch.FloatTensor), 可选, 当传递output_attentions=True或当config.output_attentions=True时返回) — 由torch.FloatTensor组成的元组(每一层一个)形状为(batch_size, num_heads, sequence_length, sequence_length)。注意力softmax后的注意力权重,用于计算自注意力头中的加权平均值。

Owlv2VisionModel 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from PIL import Image

>>> import requests

>>> from transformers import AutoProcessor, Owlv2VisionModel

>>> model = Owlv2VisionModel.from_pretrained("google/owlv2-base-patch16")

>>> processor = AutoProcessor.from_pretrained("google/owlv2-base-patch16")

>>> url = "http://images.cocodataset.org/val2017/000000039769.jpg"

>>> image = Image.open(requests.get(url, stream=True).raw)

>>> inputs = processor(images=image, return_tensors="pt")

>>> outputs = model(**inputs)

>>> last_hidden_state = outputs.last_hidden_state

>>> pooled_output = outputs.pooler_output # pooled CLS statesOwlv2ForObjectDetection

前进

< source >( input_ids: Tensor pixel_values: FloatTensor attention_mask: typing.Optional[torch.Tensor] = None output_attentions: typing.Optional[bool] = None output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None ) → transformers.models.owlv2.modeling_owlv2.Owlv2ObjectDetectionOutput 或 tuple(torch.FloatTensor)

参数

- pixel_values (

torch.FloatTensorof shape(batch_size, num_channels, height, width)) — 像素值. - input_ids (

torch.LongTensorof shape(batch_size * num_max_text_queries, sequence_length), optional) — 词汇表中输入序列标记的索引。可以使用AutoTokenizer获取索引。详情请参见 PreTrainedTokenizer.encode() 和 PreTrainedTokenizer.call()。什么是输入ID?. - attention_mask (

torch.Tensorof shape(batch_size, num_max_text_queries, sequence_length), optional) — 用于避免在填充标记索引上执行注意力的掩码。掩码值在[0, 1]中选择:- 1 表示 未掩码 的标记,

- 0 表示 掩码 的标记。 什么是注意力掩码?

- output_hidden_states (

bool, optional) — 是否返回最后的隐藏状态。有关更多详细信息,请参阅返回的张量中的text_model_last_hidden_state和vision_model_last_hidden_state。 - return_dict (

bool, 可选) — 是否返回一个ModelOutput而不是一个普通的元组。

返回

transformers.models.owlv2.modeling_owlv2.Owlv2ObjectDetectionOutput 或 tuple(torch.FloatTensor)

一个 transformers.models.owlv2.modeling_owlv2.Owlv2ObjectDetectionOutput 或一个由 torch.FloatTensor 组成的元组(如果传递了 return_dict=False 或当 config.return_dict=False 时),包含根据配置(

- loss (

torch.FloatTensor形状为(1,),可选,当提供labels时返回) — 总损失,作为类别预测的负对数似然(交叉熵)和边界框损失的线性组合。后者定义为 L1 损失和广义尺度不变 IoU 损失的线性组合。 - loss_dict (

Dict,可选) — 包含各个损失的字典。用于记录日志。 - logits (

torch.FloatTensor形状为(batch_size, num_patches, num_queries)) — 所有查询的分类 logits(包括无对象)。 - objectness_logits (

torch.FloatTensor形状为(batch_size, num_patches, 1)) — 所有图像块的对象性 logits。OWL-ViT 将图像表示为一组图像块,其中总块数为 (image_size / patch_size)**2。 - pred_boxes (

torch.FloatTensor形状为(batch_size, num_patches, 4)) — 所有查询的归一化框坐标,表示为 (center_x, center_y, width, height)。这些值在 [0, 1] 范围内归一化,相对于批次中每个单独图像的大小(忽略可能的填充)。您可以使用 post_process_object_detection() 来检索未归一化的边界框。 - text_embeds (

torch.FloatTensor形状为(batch_size, num_max_text_queries, output_dim) — 通过将投影层应用于 Owlv2TextModel 的池化输出获得的文本嵌入。 - image_embeds (

torch.FloatTensor形状为(batch_size, patch_size, patch_size, output_dim) — Owlv2VisionModel 的池化输出。OWLv2 将图像表示为一组图像块,并计算每个块的图像嵌入。 - class_embeds (

torch.FloatTensor形状为(batch_size, num_patches, hidden_size)) — 所有图像块的类别嵌入。OWLv2 将图像表示为一组图像块,其中总块数为 (image_size / patch_size)**2。 - text_model_output (Tuple

BaseModelOutputWithPooling) — Owlv2TextModel 的输出。 - vision_model_output (

BaseModelOutputWithPooling) — Owlv2VisionModel 的输出。

Owlv2ForObjectDetection 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> import requests

>>> from PIL import Image

>>> import torch

>>> from transformers import AutoProcessor, Owlv2ForObjectDetection

>>> processor = AutoProcessor.from_pretrained("google/owlv2-base-patch16-ensemble")

>>> model = Owlv2ForObjectDetection.from_pretrained("google/owlv2-base-patch16-ensemble")

>>> url = "http://images.cocodataset.org/val2017/000000039769.jpg"

>>> image = Image.open(requests.get(url, stream=True).raw)

>>> texts = [["a photo of a cat", "a photo of a dog"]]

>>> inputs = processor(text=texts, images=image, return_tensors="pt")

>>> # forward pass

>>> with torch.no_grad():

... outputs = model(**inputs)

>>> target_sizes = torch.Tensor([image.size[::-1]])

>>> # Convert outputs (bounding boxes and class logits) to final bounding boxes and scores

>>> results = processor.post_process_object_detection(

... outputs=outputs, threshold=0.2, target_sizes=target_sizes

... )

>>> i = 0 # Retrieve predictions for the first image for the corresponding text queries

>>> text = texts[i]

>>> boxes, scores, labels = results[i]["boxes"], results[i]["scores"], results[i]["labels"]

>>> for box, score, label in zip(boxes, scores, labels):

... box = [round(i, 2) for i in box.tolist()]

... print(f"Detected {text[label]} with confidence {round(score.item(), 3)} at location {box}")

Detected a photo of a cat with confidence 0.614 at location [341.67, 23.39, 642.32, 371.35]

Detected a photo of a cat with confidence 0.665 at location [6.75, 51.96, 326.62, 473.13]image_guided_detection

< source >( pixel_values: FloatTensor query_pixel_values: typing.Optional[torch.FloatTensor] = None output_attentions: typing.Optional[bool] = None output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None ) → transformers.models.owlv2.modeling_owlv2.Owlv2ImageGuidedObjectDetectionOutput 或 tuple(torch.FloatTensor)

参数

- pixel_values (

torch.FloatTensorof shape(batch_size, num_channels, height, width)) — 像素值. - query_pixel_values (

torch.FloatTensorof shape(batch_size, num_channels, height, width)) — 要检测的查询图像的像素值。每个目标图像传入一个查询图像。 - output_attentions (

bool, 可选) — 是否返回所有注意力层的注意力张量。有关更多详细信息,请参见返回张量下的attentions。 - output_hidden_states (

bool, optional) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量下的hidden_states。 - return_dict (

bool, 可选) — 是否返回一个ModelOutput而不是一个普通的元组。

返回

transformers.models.owlv2.modeling_owlv2.Owlv2ImageGuidedObjectDetectionOutput 或 tuple(torch.FloatTensor)

一个 transformers.models.owlv2.modeling_owlv2.Owlv2ImageGuidedObjectDetectionOutput 或一个由 torch.FloatTensor 组成的元组(如果传递了 return_dict=False 或当 config.return_dict=False 时),包含各种元素,具体取决于配置(

- logits (

torch.FloatTensor形状为(batch_size, num_patches, num_queries)) — 所有查询的分类 logits(包括无对象)。 - target_pred_boxes (

torch.FloatTensor形状为(batch_size, num_patches, 4)) — 所有查询的归一化框坐标,表示为 (center_x, center_y, width, height)。这些值在 [0, 1] 范围内归一化,相对于批次中每个目标图像的大小(忽略可能的填充)。您可以使用 post_process_object_detection() 来检索未归一化的边界框。 - query_pred_boxes (

torch.FloatTensor形状为(batch_size, num_patches, 4)) — 所有查询的归一化框坐标,表示为 (center_x, center_y, width, height)。这些值在 [0, 1] 范围内归一化,相对于批次中每个查询图像的大小(忽略可能的填充)。您可以使用 post_process_object_detection() 来检索未归一化的边界框。 - image_embeds (

torch.FloatTensor形状为(batch_size, patch_size, patch_size, output_dim) — Owlv2VisionModel 的池化输出。OWLv2 将图像表示为一组图像块,并计算每个块的图像嵌入。 - query_image_embeds (

torch.FloatTensor形状为(batch_size, patch_size, patch_size, output_dim) — Owlv2VisionModel 的池化输出。OWLv2 将图像表示为一组图像块,并计算每个块的图像嵌入。 - class_embeds (

torch.FloatTensor形状为(batch_size, num_patches, hidden_size)) — 所有图像块的类别嵌入。OWLv2 将图像表示为一组图像块,其中总块数为 (image_size / patch_size)**2。 - text_model_output (Tuple

BaseModelOutputWithPooling) — Owlv2TextModel 的输出。 - vision_model_output (

BaseModelOutputWithPooling) — Owlv2VisionModel 的输出。

Owlv2ForObjectDetection 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> import requests

>>> from PIL import Image

>>> import torch

>>> from transformers import AutoProcessor, Owlv2ForObjectDetection

>>> processor = AutoProcessor.from_pretrained("google/owlv2-base-patch16-ensemble")

>>> model = Owlv2ForObjectDetection.from_pretrained("google/owlv2-base-patch16-ensemble")

>>> url = "http://images.cocodataset.org/val2017/000000039769.jpg"

>>> image = Image.open(requests.get(url, stream=True).raw)

>>> query_url = "http://images.cocodataset.org/val2017/000000001675.jpg"

>>> query_image = Image.open(requests.get(query_url, stream=True).raw)

>>> inputs = processor(images=image, query_images=query_image, return_tensors="pt")

>>> # forward pass

>>> with torch.no_grad():

... outputs = model.image_guided_detection(**inputs)

>>> target_sizes = torch.Tensor([image.size[::-1]])

>>> # Convert outputs (bounding boxes and class logits) to Pascal VOC format (xmin, ymin, xmax, ymax)

>>> results = processor.post_process_image_guided_detection(

... outputs=outputs, threshold=0.9, nms_threshold=0.3, target_sizes=target_sizes

... )

>>> i = 0 # Retrieve predictions for the first image

>>> boxes, scores = results[i]["boxes"], results[i]["scores"]

>>> for box, score in zip(boxes, scores):

... box = [round(i, 2) for i in box.tolist()]

... print(f"Detected similar object with confidence {round(score.item(), 3)} at location {box}")

Detected similar object with confidence 0.938 at location [327.31, 54.94, 547.39, 268.06]

Detected similar object with confidence 0.959 at location [5.78, 360.65, 619.12, 366.39]

Detected similar object with confidence 0.902 at location [2.85, 360.01, 627.63, 380.8]

Detected similar object with confidence 0.985 at location [176.98, -29.45, 672.69, 182.83]

Detected similar object with confidence 1.0 at location [6.53, 14.35, 624.87, 470.82]

Detected similar object with confidence 0.998 at location [579.98, 29.14, 615.49, 489.05]

Detected similar object with confidence 0.985 at location [206.15, 10.53, 247.74, 466.01]

Detected similar object with confidence 0.947 at location [18.62, 429.72, 646.5, 457.72]

Detected similar object with confidence 0.996 at location [523.88, 20.69, 586.84, 483.18]

Detected similar object with confidence 0.998 at location [3.39, 360.59, 617.29, 499.21]

Detected similar object with confidence 0.969 at location [4.47, 449.05, 614.5, 474.76]

Detected similar object with confidence 0.966 at location [31.44, 463.65, 654.66, 471.07]

Detected similar object with confidence 0.924 at location [30.93, 468.07, 635.35, 475.39]