SigLIP

概述

SigLIP模型由Xiaohua Zhai、Basil Mustafa、Alexander Kolesnikov和Lucas Beyer在Sigmoid Loss for Language Image Pre-Training中提出。SigLIP提出用简单的成对sigmoid损失函数替换CLIP中使用的损失函数。这导致在ImageNet上的零样本分类准确率方面表现更好。

论文的摘要如下:

我们提出了一种简单的成对Sigmoid损失函数用于语言-图像预训练(SigLIP)。与使用softmax归一化的标准对比学习不同,sigmoid损失仅作用于图像-文本对,并且不需要全局视角来归一化成对相似性。sigmoid损失同时允许进一步扩大批量大小,同时在较小的批量大小下表现更好。结合锁定图像调优,仅使用四个TPUv4芯片,我们训练了一个SigLiT模型,在两天内实现了84.5%的ImageNet零样本准确率。将批量大小与损失解耦进一步使我们能够研究样本与对以及负样本与正样本比例的影响。最后,我们将批量大小推向极端,达到一百万,发现增加批量大小的好处迅速减少,32k的批量大小已经足够合理。

使用提示

- SigLIP 的使用与 CLIP 类似。主要区别在于训练损失,它不需要对批次内所有图像和文本的成对相似性进行全局视图。需要对 logits 应用 sigmoid 激活函数,而不是 softmax。

- 支持训练但不使用

torch.distributed工具,这可能会限制批量大小的可扩展性。然而,DDP和FDSP在单节点多GPU设置上有效。 - 当使用独立的SiglipTokenizer或SiglipProcessor时,请确保传递

padding="max_length",因为这是模型训练的方式。 - 为了获得与管道相同的结果,应使用“这是一张{label}的照片。”的提示模板。

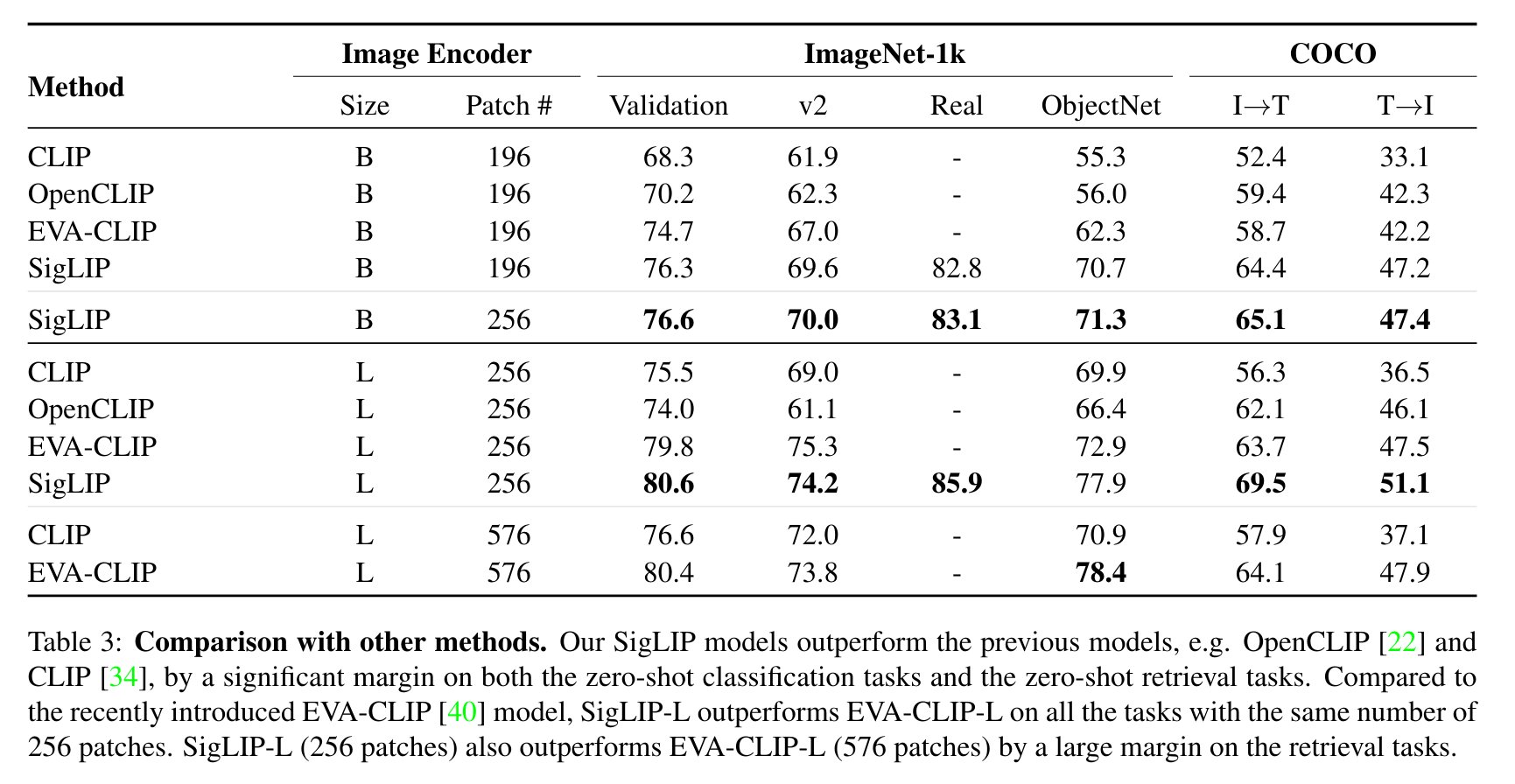

SigLIP evaluation results compared to CLIP. Taken from the original paper.

SigLIP evaluation results compared to CLIP. Taken from the original paper. 使用示例

使用 SigLIP 主要有两种方式:一种是使用 pipeline API,它会为你抽象掉所有的复杂性;另一种是自己使用 SiglipModel 类。

管道 API

管道允许在几行代码中使用模型:

>>> from transformers import pipeline

>>> from PIL import Image

>>> import requests

>>> # load pipe

>>> image_classifier = pipeline(task="zero-shot-image-classification", model="google/siglip-base-patch16-224")

>>> # load image

>>> url = 'http://images.cocodataset.org/val2017/000000039769.jpg'

>>> image = Image.open(requests.get(url, stream=True).raw)

>>> # inference

>>> candidate_labels = ["2 cats", "a plane", "a remote"]

>>> outputs = image_classifier(image, candidate_labels=candidate_labels)

>>> outputs = [{"score": round(output["score"], 4), "label": output["label"] } for output in outputs]

>>> print(outputs)

[{'score': 0.1979, 'label': '2 cats'}, {'score': 0.0, 'label': 'a remote'}, {'score': 0.0, 'label': 'a plane'}]自己使用模型

如果你想自己进行预处理和后处理,以下是操作方法:

>>> from PIL import Image

>>> import requests

>>> from transformers import AutoProcessor, AutoModel

>>> import torch

>>> model = AutoModel.from_pretrained("google/siglip-base-patch16-224")

>>> processor = AutoProcessor.from_pretrained("google/siglip-base-patch16-224")

>>> url = "http://images.cocodataset.org/val2017/000000039769.jpg"

>>> image = Image.open(requests.get(url, stream=True).raw)

>>> candidate_labels = ["2 cats", "2 dogs"]

# follows the pipeline prompt template to get same results

>>> texts = [f'This is a photo of {label}.' for label in candidate_labels]

>>> # important: we pass `padding=max_length` since the model was trained with this

>>> inputs = processor(text=texts, images=image, padding="max_length", return_tensors="pt")

>>> with torch.no_grad():

... outputs = model(**inputs)

>>> logits_per_image = outputs.logits_per_image

>>> probs = torch.sigmoid(logits_per_image) # these are the probabilities

>>> print(f"{probs[0][0]:.1%} that image 0 is '{candidate_labels[0]}'")

31.9% that image 0 is 'a photo of 2 cats'资源

以下是官方Hugging Face和社区(由🌎表示)提供的资源列表,帮助您开始使用SigLIP。

- 零样本图像分类任务指南

- SigLIP 的演示笔记本可以在 这里 找到。🌎

如果您有兴趣提交资源以包含在此处,请随时打开一个 Pull Request,我们将进行审核!理想情况下,资源应展示一些新内容,而不是重复现有资源。

结合 SigLIP 和 Flash Attention 2

首先,请确保安装最新版本的 Flash Attention 2。

pip install -U flash-attn --no-build-isolation

请确保您拥有与Flash-Attention 2兼容的硬件。更多信息请参阅flash-attn仓库的官方文档。同时,请确保以半精度加载您的模型(例如 `torch.float16`)。

要使用Flash Attention 2加载并运行模型,请参考以下代码片段:

>>> import torch

>>> import requests

>>> from PIL import Image

>>> from transformers import SiglipProcessor, SiglipModel

>>> device = "cuda" # the device to load the model onto

>>> model = SiglipModel.from_pretrained(

... "google/siglip-so400m-patch14-384",

... attn_implementation="flash_attention_2",

... torch_dtype=torch.float16,

... device_map=device,

... )

>>> processor = SiglipProcessor.from_pretrained("google/siglip-so400m-patch14-384")

>>> url = "http://images.cocodataset.org/val2017/000000039769.jpg"

>>> image = Image.open(requests.get(url, stream=True).raw)

>>> candidate_labels = ["2 cats", "2 dogs"]

# follows the pipeline prompt template to get same results

>>> texts = [f'This is a photo of {label}.' for label in candidate_labels]

# important: we pass `padding=max_length` since the model was trained with this

>>> inputs = processor(text=texts, images=image, padding="max_length", return_tensors="pt")

>>> inputs.to(device)

>>> with torch.no_grad():

... with torch.autocast(device):

... outputs = model(**inputs)

>>> logits_per_image = outputs.logits_per_image

>>> probs = torch.sigmoid(logits_per_image) # these are the probabilities

>>> print(f"{probs[0][0]:.1%} that image 0 is '{candidate_labels[0]}'")

51.3% that image 0 is 'This is a photo of 2 cats.'使用缩放点积注意力 (SDPA)

PyTorch 包含一个原生的缩放点积注意力(SDPA)操作符,作为 torch.nn.functional 的一部分。这个函数

包含了几种实现,可以根据输入和使用的硬件进行应用。更多信息请参阅

官方文档

或 GPU 推理

页面。

你可以在from_pretrained()中设置attn_implementation="sdpa"来明确请求使用SDPA。确保你有torch>=2.1.1。

>>> from transformers import SiglipModel

>>> model = SiglipModel.from_pretrained(

... "google/siglip-so400m-patch14-384",

... attn_implementation="sdpa",

... torch_dtype=torch.float16,

... device_map=device,

... )为了获得最佳加速效果,我们建议以半精度加载模型(例如 torch.float16 或 torch.bfloat16)。

预期的加速

下面是一个预期的加速图,比较了使用google/siglip-so400m-patch14-384检查点在float16精度下的transformers原生实现与使用不同批量大小的Flash Attention 2 / SDPA版本模型的推理时间。

SiglipConfig

类 transformers.SiglipConfig

< source >( text_config = None vision_config = None **kwargs )

参数

- text_config (

dict, 可选) — 用于初始化 SiglipTextConfig 的配置选项字典. - vision_config (

dict, 可选) — 用于初始化 SiglipVisionConfig 的配置选项字典。 - kwargs (可选) — 关键字参数字典。

SiglipConfig 是用于存储 SiglipModel 配置的配置类。它用于根据指定的参数实例化 Siglip 模型,定义文本模型和视觉模型的配置。使用默认值实例化配置将产生与 Siglip google/siglip-base-patch16-224 架构类似的配置。

配置对象继承自PretrainedConfig,可用于控制模型输出。阅读PretrainedConfig的文档以获取更多信息。

示例:

>>> from transformers import SiglipConfig, SiglipModel

>>> # Initializing a SiglipConfig with google/siglip-base-patch16-224 style configuration

>>> configuration = SiglipConfig()

>>> # Initializing a SiglipModel (with random weights) from the google/siglip-base-patch16-224 style configuration

>>> model = SiglipModel(configuration)

>>> # Accessing the model configuration

>>> configuration = model.config

>>> # We can also initialize a SiglipConfig from a SiglipTextConfig and a SiglipVisionConfig

>>> from transformers import SiglipTextConfig, SiglipVisionConfig

>>> # Initializing a SiglipText and SiglipVision configuration

>>> config_text = SiglipTextConfig()

>>> config_vision = SiglipVisionConfig()

>>> config = SiglipConfig.from_text_vision_configs(config_text, config_vision)from_text_vision_configs

< source >( text_config: SiglipTextConfig vision_config: SiglipVisionConfig **kwargs ) → SiglipConfig

从siglip文本模型配置和siglip视觉模型配置实例化一个SiglipConfig(或派生类)。

SiglipTextConfig

类 transformers.SiglipTextConfig

< source >( vocab_size = 32000 hidden_size = 768 intermediate_size = 3072 num_hidden_layers = 12 num_attention_heads = 12 max_position_embeddings = 64 hidden_act = 'gelu_pytorch_tanh' layer_norm_eps = 1e-06 attention_dropout = 0.0 pad_token_id = 1 bos_token_id = 49406 eos_token_id = 49407 **kwargs )

参数

- vocab_size (

int, 可选, 默认为 32000) — Siglip 文本模型的词汇量大小。定义了调用 SiglipModel 时传递的inputs_ids可以表示的不同标记的数量。 - hidden_size (

int, optional, 默认为 768) — 编码器层和池化层的维度。 - intermediate_size (

int, optional, 默认为 3072) — Transformer 编码器中“中间”(即前馈)层的维度。 - num_hidden_layers (

int, optional, 默认为 12) — Transformer 编码器中的隐藏层数量。 - num_attention_heads (

int, optional, 默认为 12) — Transformer 编码器中每个注意力层的注意力头数。 - max_position_embeddings (

int, optional, 默认为 64) — 此模型可能使用的最大序列长度。通常将其设置为较大的值以防万一(例如,512 或 1024 或 2048)。 - hidden_act (

str或function, 可选, 默认为"gelu_pytorch_tanh") — 编码器和池化器中的非线性激活函数(函数或字符串)。如果是字符串,支持"gelu","relu","selu"和"gelu_new""quick_gelu". - layer_norm_eps (

float, optional, defaults to 1e-06) — 层归一化层使用的epsilon值。 - attention_dropout (

float, optional, 默认为 0.0) — 注意力概率的丢弃比例。 - pad_token_id (

int, 可选, 默认为 1) — 词汇表中填充标记的ID。 - bos_token_id (

int, optional, defaults to 49406) — 词汇表中序列开始标记的id. - eos_token_id (

int, optional, defaults to 49407) — 词汇表中结束序列标记的id.

这是用于存储SiglipTextModel配置的配置类。它用于根据指定的参数实例化Siglip文本编码器,定义模型架构。使用默认值实例化配置将产生与Siglip文本编码器google/siglip-base-patch16-224架构类似的配置。

配置对象继承自PretrainedConfig,可用于控制模型输出。阅读PretrainedConfig的文档以获取更多信息。

示例:

>>> from transformers import SiglipTextConfig, SiglipTextModel

>>> # Initializing a SiglipTextConfig with google/siglip-base-patch16-224 style configuration

>>> configuration = SiglipTextConfig()

>>> # Initializing a SiglipTextModel (with random weights) from the google/siglip-base-patch16-224 style configuration

>>> model = SiglipTextModel(configuration)

>>> # Accessing the model configuration

>>> configuration = model.configSiglipVisionConfig

类 transformers.SiglipVisionConfig

< source >( hidden_size = 768 intermediate_size = 3072 num_hidden_layers = 12 num_attention_heads = 12 num_channels = 3 image_size = 224 patch_size = 16 hidden_act = 'gelu_pytorch_tanh' layer_norm_eps = 1e-06 attention_dropout = 0.0 **kwargs )

参数

- hidden_size (

int, optional, 默认为 768) — 编码器层和池化层的维度。 - intermediate_size (

int, optional, 默认为 3072) — Transformer 编码器中“中间”(即前馈)层的维度。 - num_hidden_layers (

int, optional, 默认为 12) — Transformer 编码器中的隐藏层数量。 - num_attention_heads (

int, optional, defaults to 12) — Transformer编码器中每个注意力层的注意力头数。 - num_channels (

int, optional, defaults to 3) — 输入图像中的通道数。 - image_size (

int, optional, defaults to 224) — 每张图片的大小(分辨率)。 - patch_size (

int, optional, defaults to 16) — 每个补丁的大小(分辨率)。 - hidden_act (

str或function, 可选, 默认为"gelu_pytorch_tanh") — 编码器和池化器中的非线性激活函数(函数或字符串)。如果是字符串,支持"gelu"、"relu"、"selu"和"gelu_new""quick_gelu"。 - layer_norm_eps (

float, optional, defaults to 1e-06) — 层归一化层使用的epsilon值。 - attention_dropout (

float, optional, defaults to 0.0) — 注意力概率的丢弃比率。

这是用于存储SiglipVisionModel配置的配置类。它用于根据指定的参数实例化Siglip视觉编码器,定义模型架构。使用默认值实例化配置将产生与Siglip视觉编码器google/siglip-base-patch16-224架构类似的配置。

配置对象继承自PretrainedConfig,可用于控制模型输出。阅读PretrainedConfig的文档以获取更多信息。

示例:

>>> from transformers import SiglipVisionConfig, SiglipVisionModel

>>> # Initializing a SiglipVisionConfig with google/siglip-base-patch16-224 style configuration

>>> configuration = SiglipVisionConfig()

>>> # Initializing a SiglipVisionModel (with random weights) from the google/siglip-base-patch16-224 style configuration

>>> model = SiglipVisionModel(configuration)

>>> # Accessing the model configuration

>>> configuration = model.configSiglipTokenizer

类 transformers.SiglipTokenizer

< source >( vocab_file eos_token = '' unk_token = '

参数

- vocab_file (

str) — SentencePiece 文件(通常具有 .spm 扩展名),包含实例化分词器所需的词汇表。 - eos_token (

str, optional, defaults to"") — 序列结束标记。 - unk_token (

str, optional, defaults to") — 未知标记。不在词汇表中的标记无法转换为ID,而是设置为该标记。" - pad_token (

str, optional, defaults to"") — 用于填充的标记,例如在对不同长度的序列进行批处理时使用。 - additional_special_tokens (

List[str], optional) — 分词器使用的额外特殊标记。 - sp_model_kwargs (

dict, optional) — Will be passed to theSentencePieceProcessor.__init__()method. The Python wrapper for SentencePiece can be used, among other things, to set:-

enable_sampling: 启用子词正则化。 -

nbest_size: 用于unigram的采样参数。对于BPE-Dropout无效。nbest_size = {0,1}: No sampling is performed.nbest_size > 1: samples from the nbest_size results.nbest_size < 0: assuming that nbest_size is infinite and samples from the all hypothesis (lattice) using forward-filtering-and-backward-sampling algorithm.

-

alpha: 用于单字采样的平滑参数,以及BPE-dropout的合并操作丢弃概率。

-

- model_max_length (

int, optional, defaults to 64) — 模型输入的最大长度(以标记数计)。 - do_lower_case (

bool, optional, defaults toTrue) — 是否在分词时将输入转换为小写。

构建一个Siglip分词器。基于SentencePiece。

此分词器继承自PreTrainedTokenizer,其中包含了大部分主要方法。用户应参考此超类以获取有关这些方法的更多信息。

build_inputs_with_special_tokens

< source >( token_ids_0: typing.List[int] token_ids_1: typing.Optional[typing.List[int]] = None ) → List[int]

通过连接和添加特殊标记,从序列或序列对构建序列分类任务的模型输入。序列的格式如下:

- 单个序列:

X - 序列对:

A B

get_special_tokens_mask

< source >( token_ids_0: typing.List[int] token_ids_1: typing.Optional[typing.List[int]] = None already_has_special_tokens: bool = False ) → List[int]

从没有添加特殊标记的标记列表中检索序列ID。当使用标记器的prepare_for_model方法添加特殊标记时,会调用此方法。

create_token_type_ids_from_sequences

< source >( token_ids_0: typing.List[int] token_ids_1: typing.Optional[typing.List[int]] = None ) → List[int]

从传递给序列对分类任务的两个序列中创建一个掩码。T5不使用标记类型ID,因此返回一个零列表。

SiglipImageProcessor

类 transformers.SiglipImageProcessor

< source >( do_resize: bool = True size: typing.Dict[str, int] = None resample: Resampling =

参数

- do_resize (

bool, 可选, 默认为True) — 是否将图像的(高度,宽度)尺寸调整为指定的size。可以在preprocess方法中通过do_resize覆盖此设置。 - size (

Dict[str, int]可选, 默认为{"height" -- 224, "width": 224}): 调整大小后的图像尺寸。可以在preprocess方法中通过size覆盖此设置。 - resample (

PILImageResampling, 可选, 默认为Resampling.BICUBIC) — 如果调整图像大小,使用的重采样过滤器。可以在preprocess方法中通过resample覆盖。 - do_rescale (

bool, 可选, 默认为True) — 是否通过指定的比例rescale_factor来重新缩放图像。可以在preprocess方法中被do_rescale覆盖。 - rescale_factor (

int或float, 可选, 默认为1/255) — 如果重新缩放图像,则使用的缩放因子。可以在preprocess方法中被rescale_factor覆盖。 - do_normalize (

bool, optional, defaults toTrue) — 是否通过指定的均值和标准差对图像进行归一化。可以在preprocess方法中通过do_normalize进行覆盖。 - image_mean (

float或List[float], 可选, 默认为[0.5, 0.5, 0.5]) — 如果对图像进行归一化,则使用的均值。这是一个浮点数或与图像通道数长度相同的浮点数列表。可以通过preprocess方法中的image_mean参数进行覆盖。 - image_std (

float或List[float], 可选, 默认为[0.5, 0.5, 0.5]) — 如果对图像进行归一化,则使用的标准差。这是一个浮点数或与图像通道数长度相同的浮点数列表。可以在preprocess方法中通过image_std参数覆盖。 可以在preprocess方法中通过image_std参数覆盖。 - do_convert_rgb (

bool, 可选, 默认为True) — 是否将图像转换为RGB.

构建一个SigLIP图像处理器。

预处理

< source >( images: typing.Union[ForwardRef('PIL.Image.Image'), numpy.ndarray, ForwardRef('torch.Tensor'), typing.List[ForwardRef('PIL.Image.Image')], typing.List[numpy.ndarray], typing.List[ForwardRef('torch.Tensor')]] do_resize: bool = None size: typing.Dict[str, int] = None resample: Resampling = None do_rescale: bool = None rescale_factor: float = None do_normalize: bool = None image_mean: typing.Union[float, typing.List[float], NoneType] = None image_std: typing.Union[float, typing.List[float], NoneType] = None return_tensors: typing.Union[str, transformers.utils.generic.TensorType, NoneType] = None data_format: typing.Optional[transformers.image_utils.ChannelDimension] =

参数

- 图像 (

ImageInput) — 要预处理的图像。期望输入单个或批量的图像,像素值范围从0到255。如果传入的图像像素值在0到1之间,请设置do_rescale=False. - do_resize (

bool, optional, defaults toself.do_resize) — 是否调整图像大小. - size (

Dict[str, int], optional, defaults toself.size) — 调整大小后的图像尺寸。 - resample (

int, 可选, 默认为self.resample) — 如果调整图像大小,则使用的重采样过滤器。这可以是枚举PILImageResampling中的一个。只有在do_resize设置为True时才会生效。 - do_rescale (

bool, optional, defaults toself.do_rescale) — 是否对图像进行重新缩放. - rescale_factor (

float, optional, defaults toself.rescale_factor) — 如果do_rescale设置为True,则用于重新缩放图像的重新缩放因子。 - do_normalize (

bool, optional, defaults toself.do_normalize) — 是否对图像进行归一化处理。 - image_mean (

float或List[float], 可选, 默认为self.image_mean) — 用于归一化的图像均值。仅在do_normalize设置为True时有效。 - image_std (

float或List[float], 可选, 默认为self.image_std) — 用于归一化的图像标准差。仅在do_normalize设置为True时有效。 - return_tensors (

str或TensorType, 可选) — 返回的张量类型。可以是以下之一:- 未设置:返回一个

np.ndarray列表。 TensorType.TENSORFLOW或'tf':返回一个类型为tf.Tensor的批次。TensorType.PYTORCH或'pt':返回一个类型为torch.Tensor的批次。TensorType.NUMPY或'np':返回一个类型为np.ndarray的批次。TensorType.JAX或'jax':返回一个类型为jax.numpy.ndarray的批次。

- 未设置:返回一个

- data_format (

ChannelDimension或str, 可选, 默认为ChannelDimension.FIRST) — 输出图像的通道维度格式。可以是以下之一:"channels_first"或ChannelDimension.FIRST: 图像格式为 (num_channels, height, width)。"channels_last"或ChannelDimension.LAST: 图像格式为 (height, width, num_channels)。- 未设置:使用输入图像的通道维度格式。

- input_data_format (

ChannelDimension或str, 可选) — 输入图像的通道维度格式。如果未设置,则从输入图像推断通道维度格式。可以是以下之一:"channels_first"或ChannelDimension.FIRST: 图像格式为 (num_channels, height, width)。"channels_last"或ChannelDimension.LAST: 图像格式为 (height, width, num_channels)。"none"或ChannelDimension.NONE: 图像格式为 (height, width)。

- do_convert_rgb (

bool, optional, defaults toself.do_convert_rgb) — 是否将图像转换为RGB.

预处理一张图像或一批图像。

SiglipProcessor

类 transformers.SiglipProcessor

< source >( image_processor tokenizer )

参数

- image_processor (SiglipImageProcessor) — 图像处理器是一个必需的输入。

- tokenizer (SiglipTokenizer) — tokenizer 是一个必需的输入。

构建一个Siglip处理器,它将Siglip图像处理器和Siglip分词器封装成一个单一的处理器。

SiglipProcessor 提供了 SiglipImageProcessor 和 SiglipTokenizer 的所有功能。更多信息请参见

__call__() 和 decode()。

此方法将其所有参数转发给SiglipTokenizer的batch_decode()。请参考该方法的文档字符串以获取更多信息。

此方法将其所有参数转发给SiglipTokenizer的decode()。请参考该方法的文档字符串以获取更多信息。

SiglipModel

类 transformers.SiglipModel

< source >( config: SiglipConfig )

参数

- config (SiglipConfig) — 包含模型所有参数的模型配置类。 使用配置文件初始化不会加载与模型相关的权重,只会加载配置。查看 from_pretrained() 方法以加载模型权重。

该模型继承自PreTrainedModel。请查看超类文档以了解库为其所有模型实现的通用方法(如下载或保存、调整输入嵌入的大小、修剪头部等)。

该模型也是一个PyTorch torch.nn.Module 子类。 将其作为常规的PyTorch模块使用,并参考PyTorch文档以获取与一般使用和行为相关的所有信息。

前进

< source >( input_ids: typing.Optional[torch.LongTensor] = None pixel_values: typing.Optional[torch.FloatTensor] = None attention_mask: typing.Optional[torch.Tensor] = None position_ids: typing.Optional[torch.LongTensor] = None return_loss: typing.Optional[bool] = None output_attentions: typing.Optional[bool] = None output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None interpolate_pos_encoding: bool = False ) → transformers.models.siglip.modeling_siglip.SiglipOutput 或 tuple(torch.FloatTensor)

参数

- input_ids (

torch.LongTensorof shape(batch_size, sequence_length)) — Indices of input sequence tokens in the vocabulary. Padding will be ignored by default should you provide it.可以使用AutoTokenizer获取索引。详情请参见PreTrainedTokenizer.encode()和 PreTrainedTokenizer.call()。

- attention_mask (

torch.Tensorof shape(batch_size, sequence_length), optional) — Mask to avoid performing attention on padding token indices. Mask values selected in[0, 1]:- 1 for tokens that are not masked,

- 0 for tokens that are masked.

- position_ids (

torch.LongTensorof shape(batch_size, sequence_length), optional) — Indices of positions of each input sequence tokens in the position embeddings. Selected in the range[0, config.max_position_embeddings - 1]. - pixel_values (

torch.FloatTensorof shape(batch_size, num_channels, height, width)) — 像素值。默认情况下,如果您提供了填充,它将被忽略。可以使用 AutoImageProcessor获取像素值。有关详细信息,请参见CLIPImageProcessor.call(). - return_loss (

bool, optional) — 是否返回对比损失。 - output_attentions (

bool, 可选) — 是否返回所有注意力层的注意力张量。有关更多详细信息,请参见返回张量中的attentions。 - output_hidden_states (

bool, 可选) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量下的hidden_states。 - interpolate_pos_encoding (

bool, optional, defaults toFalse) — 是否插值预训练的位置编码. - return_dict (

bool, 可选) — 是否返回一个ModelOutput而不是一个普通的元组。

返回

transformers.models.siglip.modeling_siglip.SiglipOutput 或 tuple(torch.FloatTensor)

一个 transformers.models.siglip.modeling_siglip.SiglipOutput 或一个由 torch.FloatTensor 组成的元组(如果传递了 return_dict=False 或当 config.return_dict=False 时),包含各种元素,具体取决于配置(

- loss (

torch.FloatTensor形状为(1,),可选,当return_loss为True时返回) — 图像-文本相似度的对比损失。 - logits_per_image (

torch.FloatTensor形状为(image_batch_size, text_batch_size)) —image_embeds和text_embeds之间的缩放点积分数。这表示图像-文本相似度分数。 - logits_per_text (

torch.FloatTensor形状为(text_batch_size, image_batch_size)) —text_embeds和image_embeds之间的缩放点积分数。这表示文本-图像相似度分数。 - text_embeds (

torch.FloatTensor形状为(batch_size, output_dim) — 通过将投影层应用于 SiglipTextModel 的池化输出获得的文本嵌入。 - image_embeds (

torch.FloatTensor形状为(batch_size, output_dim) — 通过将投影层应用于 SiglipVisionModel 的池化输出获得的图像嵌入。 - text_model_output (

BaseModelOutputWithPooling) — SiglipTextModel 的输出。 - vision_model_output (

BaseModelOutputWithPooling) — SiglipVisionModel 的输出。

SiglipModel 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from PIL import Image

>>> import requests

>>> from transformers import AutoProcessor, AutoModel

>>> import torch

>>> model = AutoModel.from_pretrained("google/siglip-base-patch16-224")

>>> processor = AutoProcessor.from_pretrained("google/siglip-base-patch16-224")

>>> url = "http://images.cocodataset.org/val2017/000000039769.jpg"

>>> image = Image.open(requests.get(url, stream=True).raw)

>>> texts = ["a photo of 2 cats", "a photo of 2 dogs"]

>>> # important: we pass `padding=max_length` since the model was trained with this

>>> inputs = processor(text=texts, images=image, padding="max_length", return_tensors="pt")

>>> with torch.no_grad():

... outputs = model(**inputs)

>>> logits_per_image = outputs.logits_per_image

>>> probs = torch.sigmoid(logits_per_image) # these are the probabilities

>>> print(f"{probs[0][0]:.1%} that image 0 is '{texts[0]}'")

31.9% that image 0 is 'a photo of 2 cats'get_text_features

< source >( input_ids: typing.Optional[torch.Tensor] = None attention_mask: typing.Optional[torch.Tensor] = None position_ids: typing.Optional[torch.Tensor] = None output_attentions: typing.Optional[bool] = None output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None ) → 文本特征 (torch.FloatTensor 形状为 (batch_size, output_dim)

参数

- input_ids (

torch.LongTensorof shape(batch_size, sequence_length)) — Indices of input sequence tokens in the vocabulary. Padding will be ignored by default should you provide it.可以使用AutoTokenizer获取索引。详情请参见PreTrainedTokenizer.encode()和 PreTrainedTokenizer.call()。

- attention_mask (

torch.Tensorof shape(batch_size, sequence_length), optional) — Mask to avoid performing attention on padding token indices. Mask values selected in[0, 1]:- 1 for tokens that are not masked,

- 0 for tokens that are masked.

- position_ids (

torch.LongTensorof shape(batch_size, sequence_length), optional) — Indices of positions of each input sequence tokens in the position embeddings. Selected in the range[0, config.max_position_embeddings - 1]. - output_attentions (

bool, 可选) — 是否返回所有注意力层的注意力张量。有关更多详细信息,请参见返回张量下的attentions。 - output_hidden_states (

bool, 可选) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量下的hidden_states。 - return_dict (

bool, 可选) — 是否返回一个 ModelOutput 而不是一个普通的元组。

返回

文本特征 (torch.FloatTensor 形状为 (batch_size, output_dim)

通过将投影层应用于SiglipTextModel的池化输出获得的文本嵌入。

SiglipModel 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from transformers import AutoTokenizer, AutoModel

>>> import torch

>>> model = AutoModel.from_pretrained("google/siglip-base-patch16-224")

>>> tokenizer = AutoTokenizer.from_pretrained("google/siglip-base-patch16-224")

>>> # important: make sure to set padding="max_length" as that's how the model was trained

>>> inputs = tokenizer(["a photo of a cat", "a photo of a dog"], padding="max_length", return_tensors="pt")

>>> with torch.no_grad():

... text_features = model.get_text_features(**inputs)get_image_features

< source >( pixel_values: typing.Optional[torch.FloatTensor] = None output_attentions: typing.Optional[bool] = None output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None interpolate_pos_encoding: bool = False ) → 图像特征 (torch.FloatTensor 形状为 (batch_size, output_dim)

参数

- pixel_values (

torch.FloatTensorof shape(batch_size, num_channels, height, width)) — 像素值。默认情况下,如果您提供了填充,它将被忽略。像素值可以使用 AutoImageProcessor获取。详情请参见CLIPImageProcessor.call(). - output_attentions (

bool, 可选) — 是否返回所有注意力层的注意力张量。有关更多详细信息,请参见返回张量中的attentions。 - output_hidden_states (

bool, 可选) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量下的hidden_states。 - interpolate_pos_encoding (

bool, optional, defaults toFalse) — 是否插值预训练的位置编码. - return_dict (

bool, 可选) — 是否返回一个 ModelOutput 而不是一个普通的元组。

返回

图像特征 (torch.FloatTensor 形状为 (batch_size, output_dim)

通过将投影层应用于SiglipVisionModel的池化输出获得的图像嵌入。

SiglipModel 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from PIL import Image

>>> import requests

>>> from transformers import AutoProcessor, AutoModel

>>> import torch

>>> model = AutoModel.from_pretrained("google/siglip-base-patch16-224")

>>> processor = AutoProcessor.from_pretrained("google/siglip-base-patch16-224")

>>> url = "http://images.cocodataset.org/val2017/000000039769.jpg"

>>> image = Image.open(requests.get(url, stream=True).raw)

>>> inputs = processor(images=image, return_tensors="pt")

>>> with torch.no_grad():

... image_features = model.get_image_features(**inputs)SiglipTextModel

类 transformers.SiglipTextModel

< source >( config: SiglipTextConfig )

参数

- config (SiglipConfig) — 包含模型所有参数的模型配置类。 使用配置文件初始化不会加载与模型相关的权重,只会加载配置。查看 from_pretrained() 方法以加载模型权重。

来自SigLIP的文本模型,没有任何头部或顶部的投影。 该模型继承自PreTrainedModel。请查看超类文档以了解库为其所有模型实现的通用方法(如下载或保存、调整输入嵌入的大小、修剪头部等)。

该模型也是一个PyTorch torch.nn.Module 子类。 将其作为常规的PyTorch模块使用,并参考PyTorch文档以获取与一般使用和行为相关的所有信息。

前进

< source >( input_ids: typing.Optional[torch.Tensor] = None attention_mask: typing.Optional[torch.Tensor] = None position_ids: typing.Optional[torch.Tensor] = None output_attentions: typing.Optional[bool] = None output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None ) → transformers.modeling_outputs.BaseModelOutputWithPooling 或 tuple(torch.FloatTensor)

参数

- input_ids (

torch.LongTensorof shape(batch_size, sequence_length)) — Indices of input sequence tokens in the vocabulary. Padding will be ignored by default should you provide it.可以使用AutoTokenizer获取索引。详情请参见PreTrainedTokenizer.encode()和 PreTrainedTokenizer.call()。

- attention_mask (

torch.Tensorof shape(batch_size, sequence_length), optional) — Mask to avoid performing attention on padding token indices. Mask values selected in[0, 1]:- 1 for tokens that are not masked,

- 0 for tokens that are masked.

- position_ids (

torch.LongTensorof shape(batch_size, sequence_length), optional) — Indices of positions of each input sequence tokens in the position embeddings. Selected in the range[0, config.max_position_embeddings - 1]. - output_attentions (

bool, optional) — 是否返回所有注意力层的注意力张量。有关更多详细信息,请参见返回张量中的attentions。 - output_hidden_states (

bool, 可选) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量下的hidden_states。 - return_dict (

bool, 可选) — 是否返回一个 ModelOutput 而不是一个普通的元组。

返回

transformers.modeling_outputs.BaseModelOutputWithPooling 或 tuple(torch.FloatTensor)

一个 transformers.modeling_outputs.BaseModelOutputWithPooling 或一个由

torch.FloatTensor 组成的元组(如果传递了 return_dict=False 或当 config.return_dict=False 时),包含各种

元素,具体取决于配置(

-

last_hidden_state (

torch.FloatTensor形状为(batch_size, sequence_length, hidden_size)) — 模型最后一层输出的隐藏状态序列。 -

pooler_output (

torch.FloatTensor形状为(batch_size, hidden_size)) — 序列的第一个标记(分类标记)在经过用于辅助预训练任务的层进一步处理后的最后一层隐藏状态。例如,对于BERT系列模型,这返回经过线性层和tanh激活函数处理后的分类标记。线性层的权重是在预训练期间通过下一个句子预测(分类)目标训练的。 -

hidden_states (

tuple(torch.FloatTensor), 可选, 当传递了output_hidden_states=True或当config.output_hidden_states=True时返回) — 由torch.FloatTensor组成的元组(一个用于嵌入层的输出,如果模型有嵌入层,+ 一个用于每一层的输出)形状为(batch_size, sequence_length, hidden_size)。模型在每一层输出处的隐藏状态加上可选的初始嵌入输出。

-

attentions (

tuple(torch.FloatTensor), 可选, 当传递了output_attentions=True或当config.output_attentions=True时返回) — 由torch.FloatTensor组成的元组(每一层一个)形状为(batch_size, num_heads, sequence_length, sequence_length)。注意力softmax后的注意力权重,用于计算自注意力头中的加权平均值。

SiglipTextModel 的 forward 方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from transformers import AutoTokenizer, SiglipTextModel

>>> model = SiglipTextModel.from_pretrained("google/siglip-base-patch16-224")

>>> tokenizer = AutoTokenizer.from_pretrained("google/siglip-base-patch16-224")

>>> # important: make sure to set padding="max_length" as that's how the model was trained

>>> inputs = tokenizer(["a photo of a cat", "a photo of a dog"], padding="max_length", return_tensors="pt")

>>> outputs = model(**inputs)

>>> last_hidden_state = outputs.last_hidden_state

>>> pooled_output = outputs.pooler_output # pooled (EOS token) statesSiglipVisionModel

类 transformers.SiglipVisionModel

< source >( config: SiglipVisionConfig )

参数

- config (SiglipConfig) — 包含模型所有参数的模型配置类。 使用配置文件初始化不会加载与模型相关的权重,只会加载配置。查看 from_pretrained() 方法以加载模型权重。

来自SigLIP的视觉模型,没有任何头部或顶部的投影。 该模型继承自PreTrainedModel。请查看超类文档,了解库为其所有模型实现的通用方法(如下载或保存、调整输入嵌入的大小、修剪头部等)。

该模型也是一个PyTorch torch.nn.Module 子类。 将其作为常规的PyTorch模块使用,并参考PyTorch文档以获取与一般使用和行为相关的所有信息。

前进

< source >( pixel_values output_attentions: typing.Optional[bool] = None output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None interpolate_pos_encoding: bool = False ) → transformers.modeling_outputs.BaseModelOutputWithPooling 或 tuple(torch.FloatTensor)

参数

- pixel_values (

torch.FloatTensorof shape(batch_size, num_channels, height, width)) — 像素值。默认情况下,如果您提供了填充,它将被忽略。可以使用 AutoImageProcessor获取像素值。详情请参见CLIPImageProcessor.call(). - output_attentions (

bool, 可选) — 是否返回所有注意力层的注意力张量。有关更多详细信息,请参见返回张量下的attentions。 - output_hidden_states (

bool, 可选) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量下的hidden_states。 - interpolate_pos_encoding (

bool, optional, defaults toFalse) — 是否插值预训练的位置编码. - return_dict (

bool, 可选) — 是否返回一个 ModelOutput 而不是一个普通的元组。

返回

transformers.modeling_outputs.BaseModelOutputWithPooling 或 tuple(torch.FloatTensor)

一个 transformers.modeling_outputs.BaseModelOutputWithPooling 或一个由

torch.FloatTensor 组成的元组(如果传递了 return_dict=False 或当 config.return_dict=False 时),包含各种

元素,具体取决于配置(

-

last_hidden_state (

torch.FloatTensor形状为(batch_size, sequence_length, hidden_size)) — 模型最后一层的隐藏状态序列。 -

pooler_output (

torch.FloatTensor形状为(batch_size, hidden_size)) — 序列的第一个标记(分类标记)在经过用于辅助预训练任务的层进一步处理后的最后一层隐藏状态。例如,对于BERT系列模型,这返回经过线性层和tanh激活函数处理后的分类标记。线性层的权重是在预训练期间通过下一个句子预测(分类)目标训练的。 -

hidden_states (

tuple(torch.FloatTensor), 可选, 当传递了output_hidden_states=True或当config.output_hidden_states=True时返回) — 由torch.FloatTensor组成的元组(一个用于嵌入层的输出,如果模型有嵌入层,+ 一个用于每一层的输出)形状为(batch_size, sequence_length, hidden_size)。模型在每一层输出处的隐藏状态加上可选的初始嵌入输出。

-

attentions (

tuple(torch.FloatTensor), 可选, 当传递了output_attentions=True或当config.output_attentions=True时返回) — 由torch.FloatTensor组成的元组(每一层一个)形状为(batch_size, num_heads, sequence_length, sequence_length)。注意力权重在注意力softmax之后,用于计算自注意力头中的加权平均值。

SiglipVisionModel 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from PIL import Image

>>> import requests

>>> from transformers import AutoProcessor, SiglipVisionModel

>>> model = SiglipVisionModel.from_pretrained("google/siglip-base-patch16-224")

>>> processor = AutoProcessor.from_pretrained("google/siglip-base-patch16-224")

>>> url = "http://images.cocodataset.org/val2017/000000039769.jpg"

>>> image = Image.open(requests.get(url, stream=True).raw)

>>> inputs = processor(images=image, return_tensors="pt")

>>> outputs = model(**inputs)

>>> last_hidden_state = outputs.last_hidden_state

>>> pooled_output = outputs.pooler_output # pooled featuresSiglipForImageClassification

类 transformers.SiglipForImageClassification

< source >( config: SiglipConfig )

参数

- config (SiglipConfig) — 包含模型所有参数的模型配置类。 使用配置文件初始化不会加载与模型相关的权重,只会加载配置。查看 from_pretrained() 方法以加载模型权重。

SigLIP视觉编码器,顶部带有图像分类头(在补丁标记的最终隐藏状态池化后的线性层),例如用于ImageNet。

该模型继承自PreTrainedModel。请查看超类文档以了解库为其所有模型实现的通用方法(如下载或保存、调整输入嵌入的大小、修剪头部等)。

该模型也是一个PyTorch torch.nn.Module 子类。 将其作为常规的PyTorch模块使用,并参考PyTorch文档以获取与一般使用和行为相关的所有信息。

前进

< source >( pixel_values: typing.Optional[torch.Tensor] = None labels: typing.Optional[torch.Tensor] = None output_attentions: typing.Optional[bool] = None output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None interpolate_pos_encoding: bool = False ) → transformers.modeling_outputs.ImageClassifierOutput 或 tuple(torch.FloatTensor)

参数

- input_ids (

torch.LongTensorof shape(batch_size, sequence_length)) — Indices of input sequence tokens in the vocabulary. Padding will be ignored by default should you provide it.可以使用AutoTokenizer获取索引。详情请参见PreTrainedTokenizer.encode()和 PreTrainedTokenizer.call()。

- attention_mask (

torch.Tensorof shape(batch_size, sequence_length), optional) — Mask to avoid performing attention on padding token indices. Mask values selected in[0, 1]:- 1 for tokens that are not masked,

- 0 for tokens that are masked.

- position_ids (

torch.LongTensorof shape(batch_size, sequence_length), optional) — Indices of positions of each input sequence tokens in the position embeddings. Selected in the range[0, config.max_position_embeddings - 1]. - pixel_values (

torch.FloatTensorof shape(batch_size, num_channels, height, width)) — 像素值。默认情况下,如果您提供了填充,它将被忽略。像素值可以使用 AutoImageProcessor获取。详情请参见CLIPImageProcessor.call(). - return_loss (

bool, optional) — 是否返回对比损失。 - output_attentions (

bool, 可选) — 是否返回所有注意力层的注意力张量。有关更多详细信息,请参见返回张量下的attentions。 - output_hidden_states (

bool, optional) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量下的hidden_states。 - interpolate_pos_encoding (

bool, optional, defaults toFalse) — 是否插值预训练的位置编码。 - return_dict (

bool, 可选) — 是否返回一个ModelOutput而不是一个普通的元组。 - labels (

torch.LongTensorof shape(batch_size,), optional) — 用于计算图像分类/回归损失的标签。索引应在[0, ..., config.num_labels - 1]范围内。如果config.num_labels == 1,则计算回归损失(均方损失),如果config.num_labels > 1,则计算分类损失(交叉熵)。

返回

transformers.modeling_outputs.ImageClassifierOutput 或 tuple(torch.FloatTensor)

一个 transformers.modeling_outputs.ImageClassifierOutput 或一个由

torch.FloatTensor 组成的元组(如果传递了 return_dict=False 或当 config.return_dict=False 时),包含各种

元素,具体取决于配置(SiglipConfig)和输入。

-

loss (

torch.FloatTensor形状为(1,),可选,当提供labels时返回) — 分类(或回归,如果 config.num_labels==1)损失。 -

logits (

torch.FloatTensor形状为(batch_size, config.num_labels)) — 分类(或回归,如果 config.num_labels==1)得分(在 SoftMax 之前)。 -

hidden_states (

tuple(torch.FloatTensor),可选,当传递output_hidden_states=True或当config.output_hidden_states=True时返回) — 由torch.FloatTensor组成的元组(一个用于嵌入层的输出,如果模型有嵌入层,+ 一个用于每个阶段的输出)形状为(batch_size, sequence_length, hidden_size)。模型在每个阶段输出的隐藏状态 (也称为特征图)。 -

attentions (

tuple(torch.FloatTensor),可选,当传递output_attentions=True或当config.output_attentions=True时返回) — 由torch.FloatTensor组成的元组(每个层一个)形状为(batch_size, num_heads, patch_size, sequence_length)。注意力 softmax 后的注意力权重,用于计算自注意力头中的加权平均值。

SiglipForImageClassification 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from transformers import AutoImageProcessor, SiglipForImageClassification

>>> import torch

>>> from PIL import Image

>>> import requests

>>> torch.manual_seed(3)

>>> url = "http://images.cocodataset.org/val2017/000000039769.jpg"

>>> image = Image.open(requests.get(url, stream=True).raw)

>>> # note: we are loading a `SiglipModel` from the hub here,

>>> # so the head will be randomly initialized, hence the predictions will be random if seed is not set above.

>>> image_processor = AutoImageProcessor.from_pretrained("google/siglip-base-patch16-224")

>>> model = SiglipForImageClassification.from_pretrained("google/siglip-base-patch16-224")

>>> inputs = image_processor(images=image, return_tensors="pt")

>>> outputs = model(**inputs)

>>> logits = outputs.logits

>>> # model predicts one of the two classes

>>> predicted_class_idx = logits.argmax(-1).item()

>>> print("Predicted class:", model.config.id2label[predicted_class_idx])

Predicted class: LABEL_1