ViLT

概述

ViLT模型由Wonjae Kim、Bokyung Son和Ildoo Kim在ViLT: Vision-and-Language Transformer Without Convolution or Region Supervision中提出。ViLT将文本嵌入整合到视觉Transformer(ViT)中,使其在视觉与语言预训练(VLP)中具有极简的设计。

论文的摘要如下:

视觉与语言预训练(VLP)在各种联合视觉与语言下游任务中提高了性能。当前的VLP方法严重依赖于图像特征提取过程,其中大多数涉及区域监督(例如,物体检测)和卷积架构(例如,ResNet)。尽管在文献中被忽视,我们发现这在(1)效率/速度方面存在问题,即仅仅提取输入特征就需要比多模态交互步骤更多的计算;以及(2)表达能力方面,因为它受限于视觉嵌入器及其预定义视觉词汇的表达能力。在本文中,我们提出了一个最小的VLP模型,视觉与语言Transformer(ViLT),在某种意义上,视觉输入的处理被极大地简化为与处理文本输入相同的无卷积方式。我们展示了ViLT比以前的VLP模型快数十倍,但在下游任务性能上具有竞争力或更好。

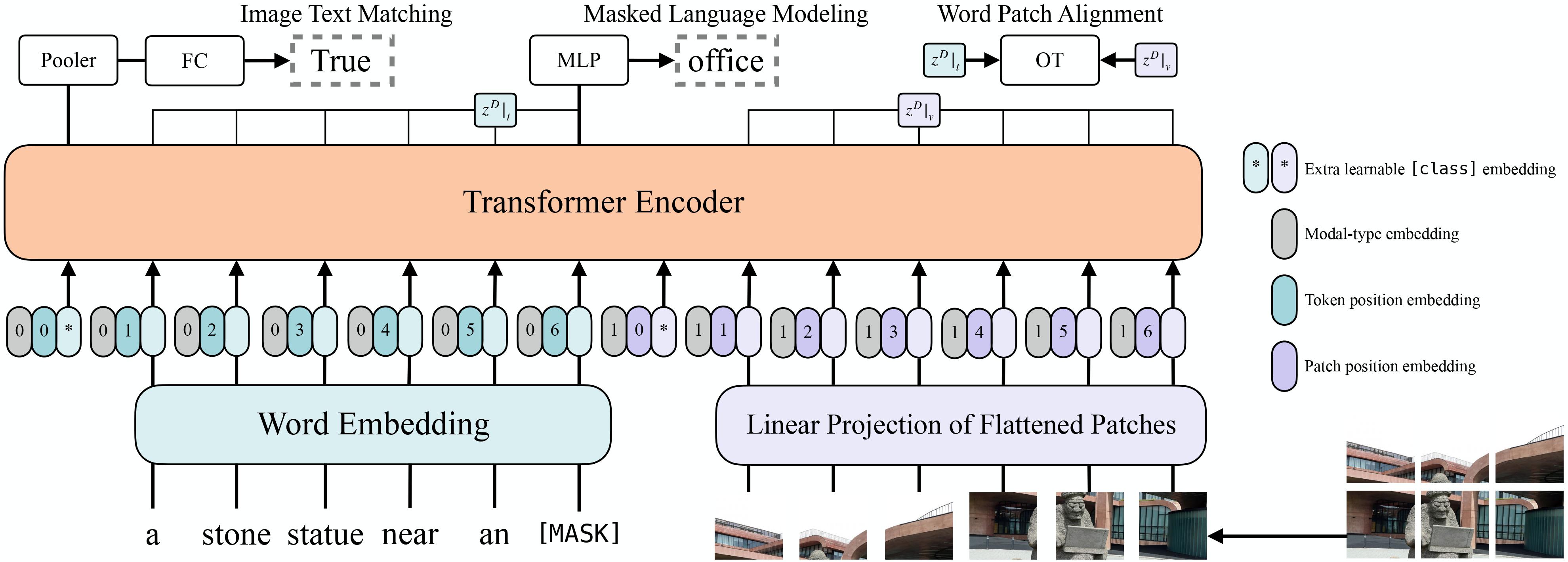

ViLT architecture. Taken from the original paper.

ViLT architecture. Taken from the original paper. 使用提示

- 开始使用ViLT的最快方法是查看示例笔记本 (其中展示了在自定义数据上的推理和微调)。

- ViLT 是一个接受

pixel_values和input_ids作为输入的模型。可以使用 ViltProcessor 来为模型准备数据。 该处理器将图像处理器(用于图像模态)和分词器(用于语言模态)封装在一起。 - ViLT 使用各种尺寸的图像进行训练:作者将输入图像的较短边调整为384,并将较长边限制在640以下,同时保持宽高比。为了使图像的批处理成为可能,作者使用了一个

pixel_mask,用于指示哪些像素值是真实的,哪些是填充的。ViltProcessor 会自动为您创建这个。 - ViLT的设计与标准的视觉Transformer(ViT)非常相似。唯一的区别是该模型包含了额外的语言模态嵌入层。

- 此模型的PyTorch版本仅在torch 1.10及更高版本中可用。

ViltConfig

类 transformers.ViltConfig

< source >( vocab_size = 30522 type_vocab_size = 2 modality_type_vocab_size = 2 max_position_embeddings = 40 hidden_size = 768 num_hidden_layers = 12 num_attention_heads = 12 intermediate_size = 3072 hidden_act = 'gelu' hidden_dropout_prob = 0.0 attention_probs_dropout_prob = 0.0 initializer_range = 0.02 layer_norm_eps = 1e-12 image_size = 384 patch_size = 32 num_channels = 3 qkv_bias = True max_image_length = -1 tie_word_embeddings = False num_images = -1 **kwargs )

参数

- vocab_size (

int, 可选, 默认为 30522) — 模型的文本部分的词汇量。定义了调用 ViltModel 时传递的inputs_ids可以表示的不同标记的数量。 - type_vocab_size (

int, 可选, 默认为 2) — 调用 ViltModel 时传递的token_type_ids的词汇量大小。这在编码文本时使用。 - modality_type_vocab_size (

int, 可选, 默认为 2) — 在调用 ViltModel 时传递的模态词汇表大小。这是在连接文本和图像模态的嵌入之后使用的。 - max_position_embeddings (

int, optional, 默认为 40) — 此模型可能使用的最大序列长度。 - hidden_size (

int, optional, 默认为 768) — 编码器层和池化层的维度。 - num_hidden_layers (

int, optional, 默认为 12) — Transformer 编码器中的隐藏层数量。 - num_attention_heads (

int, optional, defaults to 12) — Transformer编码器中每个注意力层的注意力头数。 - intermediate_size (

int, optional, 默认为 3072) — Transformer 编码器中“中间”(即前馈)层的维度。 - hidden_act (

str或function, 可选, 默认为"gelu") — 编码器和池化器中的非线性激活函数(函数或字符串)。如果是字符串,支持"gelu"、"relu"、"selu"和"gelu_new"。 - hidden_dropout_prob (

float, optional, 默认为 0.0) — 嵌入层、编码器和池化器中所有全连接层的 dropout 概率。 - attention_probs_dropout_prob (

float, optional, defaults to 0.0) — 注意力概率的丢弃比率。 - initializer_range (

float, 可选, 默认为 0.02) — 用于初始化所有权重矩阵的 truncated_normal_initializer 的标准差。 - layer_norm_eps (

float, optional, defaults to 1e-12) — 层归一化层使用的epsilon值。 - image_size (

int, optional, 默认为 384) — 每张图像的尺寸(分辨率)。 - patch_size (

int, optional, defaults to 32) — 每个补丁的大小(分辨率)。 - num_channels (

int, optional, defaults to 3) — 输入通道的数量。 - qkv_bias (

bool, optional, defaults toTrue) — 是否在查询、键和值中添加偏置。 - max_image_length (

int, 可选, 默认为 -1) — Transformer编码器输入的最大补丁数量。如果设置为正整数, 编码器将最多采样max_image_length个补丁。如果设置为-1,将不考虑此限制。 - num_images (

int, 可选, 默认为 -1) — 用于自然语言视觉推理的图像数量。如果设置为正整数,将被 ViltForImagesAndTextClassification 用于定义分类器头。

这是用于存储ViLTModel配置的配置类。它用于根据指定的参数实例化ViLT模型,定义模型架构。使用默认值实例化配置将产生类似于ViLT dandelin/vilt-b32-mlm架构的配置。

配置对象继承自PretrainedConfig,可用于控制模型输出。阅读PretrainedConfig的文档以获取更多信息。

示例:

>>> from transformers import ViLTModel, ViLTConfig

>>> # Initializing a ViLT dandelin/vilt-b32-mlm style configuration

>>> configuration = ViLTConfig()

>>> # Initializing a model from the dandelin/vilt-b32-mlm style configuration

>>> model = ViLTModel(configuration)

>>> # Accessing the model configuration

>>> configuration = model.configViltFeatureExtractor

预处理一张图像或一批图像。

ViltImageProcessor

类 transformers.ViltImageProcessor

< source >( do_resize: bool = True size: typing.Dict[str, int] = None size_divisor: int = 32 resample: Resampling =

参数

- do_resize (

bool, 可选, 默认为True) — 是否将图像的(高度,宽度)尺寸调整为指定的size。可以在preprocess方法中通过do_resize参数覆盖此设置。 - size (

Dict[str, int]可选, 默认为{"shortest_edge" -- 384}): 将输入的较短边调整为size["shortest_edge"]。较长边将被限制在int((1333 / 800) * size["shortest_edge"])以下,同时保持宽高比。仅在do_resize设置为True时有效。可以通过preprocess方法中的size参数覆盖此设置。 - size_divisor (

int, 可选, 默认为 32) — 确保高度和宽度都可以被整除的大小。仅在do_resize设置为True时有效。可以通过preprocess方法中的size_divisor参数进行覆盖。 - resample (

PILImageResampling, 可选, 默认为Resampling.BICUBIC) — 如果调整图像大小,则使用的重采样过滤器。仅在do_resize设置为True时有效。可以通过preprocess方法中的resample参数进行覆盖。 - do_rescale (

bool, 可选, 默认为True) — 是否通过指定的比例rescale_factor来重新缩放图像。可以在preprocess方法中通过do_rescale参数进行覆盖。 - rescale_factor (

int或float, 可选, 默认为1/255) — 如果重新缩放图像,则使用的缩放因子。仅在do_rescale设置为True时有效。可以被preprocess方法中的rescale_factor参数覆盖。 - do_normalize (

bool, 可选, 默认为True) — 是否对图像进行归一化。可以在preprocess方法中通过do_normalize参数进行覆盖。可以在preprocess方法中通过do_normalize参数进行覆盖。 - image_mean (

float或List[float], 可选, 默认为IMAGENET_STANDARD_MEAN) — 如果对图像进行归一化,则使用的均值。这是一个浮点数或与图像通道数长度相同的浮点数列表。可以在preprocess方法中通过image_mean参数覆盖。可以在preprocess方法中通过image_mean参数覆盖。 - image_std (

float或List[float], 可选, 默认为IMAGENET_STANDARD_STD) — 如果对图像进行归一化,则使用的标准差。这是一个浮点数或与图像通道数长度相同的浮点数列表。可以在preprocess方法中通过image_std参数覆盖。 可以在preprocess方法中通过image_std参数覆盖。 - do_pad (

bool, 可选, 默认为True) — 是否将图像填充到批次中图像的(max_height, max_width)。可以通过preprocess方法中的do_pad参数进行覆盖。

构建一个ViLT图像处理器。

预处理

< source >( images: typing.Union[ForwardRef('PIL.Image.Image'), numpy.ndarray, ForwardRef('torch.Tensor'), typing.List[ForwardRef('PIL.Image.Image')], typing.List[numpy.ndarray], typing.List[ForwardRef('torch.Tensor')]] do_resize: typing.Optional[bool] = None size: typing.Optional[typing.Dict[str, int]] = None size_divisor: typing.Optional[int] = None resample: Resampling = None do_rescale: typing.Optional[bool] = None rescale_factor: typing.Optional[float] = None do_normalize: typing.Optional[bool] = None image_mean: typing.Union[float, typing.List[float], NoneType] = None image_std: typing.Union[float, typing.List[float], NoneType] = None do_pad: typing.Optional[bool] = None return_tensors: typing.Union[str, transformers.utils.generic.TensorType, NoneType] = None data_format: ChannelDimension =

参数

- 图像 (

ImageInput) — 要预处理的图像。期望输入单个或批量的图像,像素值范围在0到255之间。如果传入的图像像素值在0到1之间,请设置do_rescale=False. - do_resize (

bool, optional, defaults toself.do_resize) — 是否调整图像大小. - size (

Dict[str, int], 可选, 默认为self.size) — 控制调整大小后图像的尺寸。图像的最短边将调整为size["shortest_edge"],同时保持宽高比。如果调整大小后的图像的最长边 大于int(size["shortest_edge"] * (1333 / 800)),则图像将再次调整大小,使最长边 等于int(size["shortest_edge"] * (1333 / 800)). - size_divisor (

int, optional, defaults toself.size_divisor) — 图像被调整为这个值的倍数大小。 - resample (

PILImageResampling, 可选, 默认为self.resample) — 如果调整图像大小,则使用的重采样过滤器。仅在do_resize设置为True时有效。 - do_rescale (

bool, optional, defaults toself.do_rescale) — 是否将图像值缩放到 [0 - 1] 之间。 - rescale_factor (

float, optional, defaults toself.rescale_factor) — 如果do_rescale设置为True,则用于重新缩放图像的重新缩放因子。 - do_normalize (

bool, optional, defaults toself.do_normalize) — 是否对图像进行归一化处理。 - image_mean (

float或List[float], 可选, 默认为self.image_mean) — 如果do_normalize设置为True,则用于归一化图像的图像均值。 - image_std (

float或List[float], 可选, 默认为self.image_std) — 如果do_normalize设置为True,则用于归一化图像的标准差。 - do_pad (

bool, 可选, 默认为self.do_pad) — 是否将图像填充到批次中的 (max_height, max_width)。如果为True,还会创建并返回一个像素掩码。 - return_tensors (

str或TensorType, 可选) — 返回的张量类型。可以是以下之一:- 未设置:返回一个

np.ndarray列表。 TensorType.TENSORFLOW或'tf':返回一个类型为tf.Tensor的批次。TensorType.PYTORCH或'pt':返回一个类型为torch.Tensor的批次。TensorType.NUMPY或'np':返回一个类型为np.ndarray的批次。TensorType.JAX或'jax':返回一个类型为jax.numpy.ndarray的批次。

- 未设置:返回一个

- data_format (

ChannelDimension或str, 可选, 默认为ChannelDimension.FIRST) — 输出图像的通道维度格式。可以是以下之一:ChannelDimension.FIRST: 图像格式为 (num_channels, height, width)。ChannelDimension.LAST: 图像格式为 (height, width, num_channels)。

- input_data_format (

ChannelDimension或str, 可选) — 输入图像的通道维度格式。如果未设置,则从输入图像推断通道维度格式。可以是以下之一:"channels_first"或ChannelDimension.FIRST: 图像格式为 (num_channels, height, width)。"channels_last"或ChannelDimension.LAST: 图像格式为 (height, width, num_channels)。"none"或ChannelDimension.NONE: 图像格式为 (height, width)。

预处理一张图像或一批图像。

ViltProcessor

类 transformers.ViltProcessor

< source >( image_processor = 无 tokenizer = 无 **kwargs )

参数

- image_processor (

ViltImageProcessor, optional) — 一个 ViltImageProcessor 的实例。图像处理器是一个必需的输入。 - tokenizer (

BertTokenizerFast, 可选) — [‘BertTokenizerFast`] 的一个实例。tokenizer 是一个必需的输入。

构建一个ViLT处理器,它将BERT分词器和ViLT图像处理器封装成一个单一的处理器。

ViltProcessor 提供了 ViltImageProcessor 和 BertTokenizerFast 的所有功能。更多信息请参见 call() 和 decode() 的文档字符串。

__call__

< source >( images text: typing.Union[str, typing.List[str], typing.List[typing.List[str]]] = None add_special_tokens: bool = True padding: typing.Union[bool, str, transformers.utils.generic.PaddingStrategy] = False truncation: typing.Union[bool, str, transformers.tokenization_utils_base.TruncationStrategy] = None max_length: typing.Optional[int] = None stride: int = 0 pad_to_multiple_of: typing.Optional[int] = None return_token_type_ids: typing.Optional[bool] = None return_attention_mask: typing.Optional[bool] = None return_overflowing_tokens: bool = False return_special_tokens_mask: bool = False return_offsets_mapping: bool = False return_length: bool = False verbose: bool = True return_tensors: typing.Union[str, transformers.utils.generic.TensorType, NoneType] = None **kwargs )

此方法使用ViltImageProcessor.call()方法来为模型准备图像,并使用BertTokenizerFast.call()来为模型准备文本。

请参考上述两个方法的文档字符串以获取更多信息。

ViltModel

类 transformers.ViltModel

< source >( config add_pooling_layer = True )

参数

- config (ViltConfig) — 包含模型所有参数的模型配置类。 使用配置文件初始化不会加载与模型相关的权重,只会加载配置。查看 from_pretrained() 方法以加载模型权重。

裸的ViLT模型转换器输出原始隐藏状态,没有任何特定的头部。

该模型是PyTorch torch.nn.Module _ 的子类。将其用作常规的PyTorch模块,并参考PyTorch文档以获取与一般使用和行为相关的所有信息。

前进

< source >( input_ids: typing.Optional[torch.LongTensor] = None attention_mask: typing.Optional[torch.FloatTensor] = None token_type_ids: typing.Optional[torch.LongTensor] = None pixel_values: typing.Optional[torch.FloatTensor] = None pixel_mask: typing.Optional[torch.LongTensor] = None head_mask: typing.Optional[torch.FloatTensor] = None inputs_embeds: typing.Optional[torch.FloatTensor] = None image_embeds: typing.Optional[torch.FloatTensor] = None image_token_type_idx: typing.Optional[int] = None output_attentions: typing.Optional[bool] = None output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None ) → transformers.modeling_outputs.BaseModelOutputWithPooling 或 tuple(torch.FloatTensor)

参数

- input_ids (

torch.LongTensorof shape({0})) — 词汇表中输入序列标记的索引。可以使用AutoTokenizer获取索引。详情请参见 PreTrainedTokenizer.encode() 和 PreTrainedTokenizer.call()。什么是输入ID? - attention_mask (

torch.FloatTensorof shape({0}), optional) — 用于避免在填充标记索引上执行注意力的掩码。掩码值在[0, 1]中选择:- 1 表示 未掩码 的标记,

- 0 表示 掩码 的标记。 什么是注意力掩码?

- token_type_ids (

torch.LongTensorof shape({0}), optional) — 用于指示输入的第一部分和第二部分的段标记索引。索引在[0, 1]中选择:- 0 对应于 句子 A 的标记,

- 1 对应于 句子 B 的标记。 什么是标记类型 ID?

- pixel_values (

torch.FloatTensorof shape(batch_size, num_channels, height, width)) — 像素值。像素值可以使用AutoImageProcessor获取。详情请参见 ViltImageProcessor.call(). - pixel_mask (

torch.LongTensor形状为(batch_size, height, width), 可选) — 用于避免对填充像素值执行注意力操作的掩码。掩码值在[0, 1]中选择:- 1 表示真实的像素(即 未掩码),

- 0 表示填充的像素(即 掩码)。

什么是注意力掩码? <../glossary.html#attention-mask>__

- head_mask (

torch.FloatTensor形状为(num_heads,)或(num_layers, num_heads), 可选) — 用于屏蔽自注意力模块中选定的头部的掩码。掩码值在[0, 1]中选择:- 1 表示头部 未被屏蔽,

- 0 表示头部 被屏蔽.

- inputs_embeds (

torch.FloatTensorof shape({0}, hidden_size), 可选) — 可选地,您可以选择直接传递嵌入表示,而不是传递input_ids。如果您希望对如何将input_ids索引转换为相关向量有更多控制权,而不是使用模型的内部嵌入查找矩阵,这将非常有用。 - image_embeds (

torch.FloatTensorof shape(batch_size, num_patches, hidden_size), optional) — 可选地,您可以选择直接传递嵌入表示,而不是传递pixel_values。 如果您希望对如何将pixel_values转换为补丁嵌入有更多控制,这将非常有用。 - output_attentions (

bool, 可选) — 是否返回所有注意力层的注意力张量。有关更多详细信息,请参见返回张量下的attentions。 - output_hidden_states (

bool, 可选) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量下的hidden_states。 - return_dict (

bool, 可选) — 是否返回一个 ModelOutput 而不是一个普通的元组。

返回

transformers.modeling_outputs.BaseModelOutputWithPooling 或 tuple(torch.FloatTensor)

一个 transformers.modeling_outputs.BaseModelOutputWithPooling 或一个由

torch.FloatTensor 组成的元组(如果传递了 return_dict=False 或当 config.return_dict=False 时),包含各种

元素,具体取决于配置(ViltConfig)和输入。

-

last_hidden_state (

torch.FloatTensor形状为(batch_size, sequence_length, hidden_size)) — 模型最后一层输出的隐藏状态序列。 -

pooler_output (

torch.FloatTensor形状为(batch_size, hidden_size)) — 序列的第一个标记(分类标记)在经过用于辅助预训练任务的层进一步处理后的最后一层隐藏状态。例如,对于BERT系列模型,这返回经过线性层和tanh激活函数处理后的分类标记。线性层的权重是在预训练期间通过下一个句子预测(分类)目标训练的。 -

hidden_states (

tuple(torch.FloatTensor), 可选, 当传递了output_hidden_states=True或当config.output_hidden_states=True时返回) — 由torch.FloatTensor组成的元组(一个用于嵌入层的输出,如果模型有嵌入层,+ 一个用于每一层的输出)形状为(batch_size, sequence_length, hidden_size)。模型在每一层输出处的隐藏状态加上可选的初始嵌入输出。

-

attentions (

tuple(torch.FloatTensor), 可选, 当传递了output_attentions=True或当config.output_attentions=True时返回) — 由torch.FloatTensor组成的元组(每一层一个)形状为(batch_size, num_heads, sequence_length, sequence_length)。注意力softmax后的注意力权重,用于计算自注意力头中的加权平均值。

ViltModel 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from transformers import ViltProcessor, ViltModel

>>> from PIL import Image

>>> import requests

>>> # prepare image and text

>>> url = "http://images.cocodataset.org/val2017/000000039769.jpg"

>>> image = Image.open(requests.get(url, stream=True).raw)

>>> text = "hello world"

>>> processor = ViltProcessor.from_pretrained("dandelin/vilt-b32-mlm")

>>> model = ViltModel.from_pretrained("dandelin/vilt-b32-mlm")

>>> inputs = processor(image, text, return_tensors="pt")

>>> outputs = model(**inputs)

>>> last_hidden_states = outputs.last_hidden_stateViltForMaskedLM

类 transformers.ViltForMaskedLM

< source >( config )

参数

- config (ViltConfig) — 包含模型所有参数的模型配置类。 使用配置文件初始化不会加载与模型相关的权重,只会加载配置。查看 from_pretrained() 方法以加载模型权重。

ViLT 模型,顶部带有语言建模头,如预训练期间所做的那样。

该模型是一个PyTorch torch.nn.Module _ 子类。将其作为常规的PyTorch模块使用,并参考PyTorch文档以获取与一般使用和行为相关的所有信息。

前进

< source >( input_ids: typing.Optional[torch.LongTensor] = None attention_mask: typing.Optional[torch.FloatTensor] = None token_type_ids: typing.Optional[torch.LongTensor] = None pixel_values: typing.Optional[torch.FloatTensor] = None pixel_mask: typing.Optional[torch.LongTensor] = None head_mask: typing.Optional[torch.FloatTensor] = None inputs_embeds: typing.Optional[torch.FloatTensor] = None image_embeds: typing.Optional[torch.FloatTensor] = None labels: typing.Optional[torch.LongTensor] = None output_attentions: typing.Optional[bool] = None output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None ) → transformers.modeling_outputs.MaskedLMOutput 或 tuple(torch.FloatTensor)

参数

- input_ids (

torch.LongTensorof shape(batch_size, sequence_length)) — 词汇表中输入序列标记的索引。可以使用AutoTokenizer获取索引。详情请参见 PreTrainedTokenizer.encode() 和 PreTrainedTokenizer.call()。什么是输入 ID? - attention_mask (

torch.FloatTensorof shape(batch_size, sequence_length), optional) — 用于避免在填充标记索引上执行注意力的掩码。掩码值在[0, 1]中选择:- 1 表示未被掩码的标记,

- 0 表示被掩码的标记。 什么是注意力掩码?

- token_type_ids (

torch.LongTensorof shape(batch_size, sequence_length), optional) — 用于指示输入的第一部分和第二部分的段标记索引。索引在[0, 1]中选择:- 0 对应于 句子 A 的标记,

- 1 对应于 句子 B 的标记。 什么是标记类型 ID?

- pixel_values (

torch.FloatTensorof shape(batch_size, num_channels, height, width)) — 像素值。像素值可以使用AutoImageProcessor获取。详情请参见 ViltImageProcessor.call(). - pixel_mask (

torch.LongTensor形状为(batch_size, height, width), 可选) — 用于避免对填充像素值执行注意力操作的掩码。掩码值在[0, 1]中选择:- 1 表示真实的像素(即 未掩码),

- 0 表示填充的像素(即 掩码)。

什么是注意力掩码? <../glossary.html#attention-mask>__

- head_mask (

torch.FloatTensor形状为(num_heads,)或(num_layers, num_heads), 可选) — 用于屏蔽自注意力模块中选定的头部的掩码。掩码值在[0, 1]中选择:- 1 表示头部 未被屏蔽,

- 0 表示头部 被屏蔽.

- inputs_embeds (

torch.FloatTensorof shape(batch_size, sequence_length, hidden_size), optional) — 可选地,您可以选择直接传递嵌入表示,而不是传递input_ids。如果您希望对如何将input_ids索引转换为相关向量有更多控制,而不是使用模型的内部嵌入查找矩阵,这将非常有用。 - image_embeds (

torch.FloatTensor形状为(batch_size, num_patches, hidden_size), 可选) — 可选地,您可以选择直接传递嵌入表示,而不是传递pixel_values。 如果您希望对如何将pixel_values转换为补丁嵌入有更多控制,这将非常有用。 - output_attentions (

bool, 可选) — 是否返回所有注意力层的注意力张量。有关更多详细信息,请参见返回张量下的attentions。 - output_hidden_states (

bool, 可选) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量下的hidden_states。 - return_dict (

bool, 可选) — 是否返回一个ModelOutput而不是一个普通的元组。 - labels (torch.LongTensor of shape (batch_size, sequence_length), optional) — 用于计算掩码语言建模损失的标签。索引应在 [-100, 0, …, config.vocab_size] 范围内(参见 input_ids 文档字符串)。索引设置为 -100 的标记将被忽略(掩码), 损失仅针对标签在 [0, …, config.vocab_size] 范围内的标记计算

返回

transformers.modeling_outputs.MaskedLMOutput 或 tuple(torch.FloatTensor)

一个 transformers.modeling_outputs.MaskedLMOutput 或一个由

torch.FloatTensor 组成的元组(如果传递了 return_dict=False 或当 config.return_dict=False 时),包含各种

元素,具体取决于配置(ViltConfig)和输入。

-

loss (

torch.FloatTensor形状为(1,),可选,当提供labels时返回) — 掩码语言建模(MLM)损失。 -

logits (

torch.FloatTensor形状为(batch_size, sequence_length, config.vocab_size)) — 语言建模头的预测分数(SoftMax 之前每个词汇标记的分数)。 -

hidden_states (

tuple(torch.FloatTensor),可选,当传递output_hidden_states=True或当config.output_hidden_states=True时返回) — 由torch.FloatTensor组成的元组(一个用于嵌入层的输出,如果模型有嵌入层,+ 一个用于每层的输出)形状为(batch_size, sequence_length, hidden_size)。模型在每层输出处的隐藏状态加上可选的初始嵌入输出。

-

attentions (

tuple(torch.FloatTensor),可选,当传递output_attentions=True或当config.output_attentions=True时返回) — 由torch.FloatTensor组成的元组(每层一个)形状为(batch_size, num_heads, sequence_length, sequence_length)。注意力 softmax 后的注意力权重,用于计算自注意力头中的加权平均值。

ViltForMaskedLM 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from transformers import ViltProcessor, ViltForMaskedLM

>>> import requests

>>> from PIL import Image

>>> import re

>>> import torch

>>> url = "http://images.cocodataset.org/val2017/000000039769.jpg"

>>> image = Image.open(requests.get(url, stream=True).raw)

>>> text = "a bunch of [MASK] laying on a [MASK]."

>>> processor = ViltProcessor.from_pretrained("dandelin/vilt-b32-mlm")

>>> model = ViltForMaskedLM.from_pretrained("dandelin/vilt-b32-mlm")

>>> # prepare inputs

>>> encoding = processor(image, text, return_tensors="pt")

>>> # forward pass

>>> outputs = model(**encoding)

>>> tl = len(re.findall("\[MASK\]", text))

>>> inferred_token = [text]

>>> # gradually fill in the MASK tokens, one by one

>>> with torch.no_grad():

... for i in range(tl):

... encoded = processor.tokenizer(inferred_token)

... input_ids = torch.tensor(encoded.input_ids)

... encoded = encoded["input_ids"][0][1:-1]

... outputs = model(input_ids=input_ids, pixel_values=encoding.pixel_values)

... mlm_logits = outputs.logits[0] # shape (seq_len, vocab_size)

... # only take into account text features (minus CLS and SEP token)

... mlm_logits = mlm_logits[1 : input_ids.shape[1] - 1, :]

... mlm_values, mlm_ids = mlm_logits.softmax(dim=-1).max(dim=-1)

... # only take into account text

... mlm_values[torch.tensor(encoded) != 103] = 0

... select = mlm_values.argmax().item()

... encoded[select] = mlm_ids[select].item()

... inferred_token = [processor.decode(encoded)]

>>> selected_token = ""

>>> encoded = processor.tokenizer(inferred_token)

>>> output = processor.decode(encoded.input_ids[0], skip_special_tokens=True)

>>> print(output)

a bunch of cats laying on a couch.ViltForQuestionAnswering

类 transformers.ViltForQuestionAnswering

< source >( config )

参数

- config (ViltConfig) — 包含模型所有参数的模型配置类。 使用配置文件初始化不会加载与模型相关的权重,只会加载配置。查看 from_pretrained() 方法以加载模型权重。

Vilt 模型转换器,顶部带有分类器头(在 [CLS] 标记的最终隐藏状态之上的线性层),用于视觉问答,例如 VQAv2。

该模型是一个PyTorch torch.nn.Module _ 子类。将其作为常规的PyTorch模块使用,并参考PyTorch文档以获取与一般使用和行为相关的所有信息。

前进

< source >( input_ids: typing.Optional[torch.LongTensor] = None attention_mask: typing.Optional[torch.FloatTensor] = None token_type_ids: typing.Optional[torch.LongTensor] = None pixel_values: typing.Optional[torch.FloatTensor] = None pixel_mask: typing.Optional[torch.LongTensor] = None head_mask: typing.Optional[torch.FloatTensor] = None inputs_embeds: typing.Optional[torch.FloatTensor] = None image_embeds: typing.Optional[torch.FloatTensor] = None labels: typing.Optional[torch.LongTensor] = None output_attentions: typing.Optional[bool] = None output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None ) → transformers.modeling_outputs.SequenceClassifierOutput 或 tuple(torch.FloatTensor)

参数

- input_ids (

torch.LongTensorof shape({0})) — 词汇表中输入序列标记的索引。可以使用AutoTokenizer获取索引。详情请参见 PreTrainedTokenizer.encode() 和 PreTrainedTokenizer.call()。什么是输入ID? - attention_mask (

torch.FloatTensorof shape({0}), optional) — 用于避免在填充标记索引上执行注意力的掩码。掩码值在[0, 1]中选择:- 1 表示 未掩码 的标记,

- 0 表示 掩码 的标记。 什么是注意力掩码?

- token_type_ids (

torch.LongTensorof shape({0}), optional) — 用于指示输入的第一部分和第二部分的段标记索引。索引在[0, 1]中选择:- 0 对应于 句子 A 的标记,

- 1 对应于 句子 B 的标记。 什么是标记类型 ID?

- pixel_values (

torch.FloatTensorof shape(batch_size, num_channels, height, width)) — 像素值。像素值可以使用AutoImageProcessor获取。详情请参见 ViltImageProcessor.call(). - pixel_mask (

torch.LongTensor形状为(batch_size, height, width), 可选) — 用于避免对填充像素值执行注意力操作的掩码。掩码值在[0, 1]中选择:- 1 表示真实的像素(即 未掩码),

- 0 表示填充的像素(即 掩码)。

什么是注意力掩码? <../glossary.html#attention-mask>__

- head_mask (

torch.FloatTensor形状为(num_heads,)或(num_layers, num_heads), 可选) — 用于屏蔽自注意力模块中选定的头部的掩码。掩码值在[0, 1]中选择:- 1 表示头部 未被屏蔽,

- 0 表示头部 被屏蔽.

- inputs_embeds (

torch.FloatTensorof shape({0}, hidden_size), optional) — 可选地,您可以选择直接传递嵌入表示,而不是传递input_ids。如果您希望对如何将input_ids索引转换为相关向量有更多控制,而不是使用模型的内部嵌入查找矩阵,这将非常有用。 - image_embeds (

torch.FloatTensorof shape(batch_size, num_patches, hidden_size), optional) — 可选地,您可以选择直接传递嵌入表示,而不是传递pixel_values。 如果您希望对如何将pixel_values转换为补丁嵌入有更多控制,这将非常有用。 - output_attentions (

bool, 可选) — 是否返回所有注意力层的注意力张量。有关更多详细信息,请参见返回张量下的attentions。 - output_hidden_states (

bool, 可选) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量下的hidden_states。 - return_dict (

bool, 可选) — 是否返回一个 ModelOutput 而不是一个普通的元组。 - labels (

torch.FloatTensorof shape(batch_size, num_labels), optional) — 用于计算视觉问答损失的标签。此张量必须是对批次中给定示例适用的所有答案的独热编码,或者是表示哪些答案适用的软编码,其中1.0是最高分。

返回

transformers.modeling_outputs.SequenceClassifierOutput 或 tuple(torch.FloatTensor)

一个 transformers.modeling_outputs.SequenceClassifierOutput 或一个由

torch.FloatTensor 组成的元组(如果传递了 return_dict=False 或当 config.return_dict=False 时),包含各种

元素,具体取决于配置(ViltConfig)和输入。

-

loss (

torch.FloatTensor形状为(1,),可选,当提供labels时返回) — 分类(或回归,如果 config.num_labels==1)损失。 -

logits (

torch.FloatTensor形状为(batch_size, config.num_labels)) — 分类(或回归,如果 config.num_labels==1)得分(在 SoftMax 之前)。 -

hidden_states (

tuple(torch.FloatTensor),可选,当传递output_hidden_states=True或当config.output_hidden_states=True时返回) — 由torch.FloatTensor组成的元组(一个用于嵌入层的输出,如果模型有嵌入层,+ 一个用于每一层的输出)形状为(batch_size, sequence_length, hidden_size)。模型在每一层输出处的隐藏状态加上可选的初始嵌入输出。

-

attentions (

tuple(torch.FloatTensor),可选,当传递output_attentions=True或当config.output_attentions=True时返回) — 由torch.FloatTensor组成的元组(每一层一个)形状为(batch_size, num_heads, sequence_length, sequence_length)。注意力 softmax 后的注意力权重,用于计算自注意力头中的加权平均值。

ViltForQuestionAnswering 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from transformers import ViltProcessor, ViltForQuestionAnswering

>>> import requests

>>> from PIL import Image

>>> url = "http://images.cocodataset.org/val2017/000000039769.jpg"

>>> image = Image.open(requests.get(url, stream=True).raw)

>>> text = "How many cats are there?"

>>> processor = ViltProcessor.from_pretrained("dandelin/vilt-b32-finetuned-vqa")

>>> model = ViltForQuestionAnswering.from_pretrained("dandelin/vilt-b32-finetuned-vqa")

>>> # prepare inputs

>>> encoding = processor(image, text, return_tensors="pt")

>>> # forward pass

>>> outputs = model(**encoding)

>>> logits = outputs.logits

>>> idx = logits.argmax(-1).item()

>>> print("Predicted answer:", model.config.id2label[idx])

Predicted answer: 2ViltForImagesAndTextClassification

类 transformers.ViltForImagesAndTextClassification

< source >( config )

参数

- input_ids (

torch.LongTensorof shape({0})) — 词汇表中输入序列标记的索引。可以使用AutoTokenizer获取索引。详情请参见 PreTrainedTokenizer.encode() 和 PreTrainedTokenizer.call()。什么是输入ID? - attention_mask (

torch.FloatTensorof shape({0}), optional) — 用于避免在填充标记索引上执行注意力的掩码。掩码值在[0, 1]中选择:- 1 表示 未掩码 的标记,

- 0 表示 掩码 的标记。 什么是注意力掩码?

- token_type_ids (

torch.LongTensorof shape({0}), optional) — 用于指示输入的第一部分和第二部分的段标记索引。索引在[0, 1]中选择:- 0 对应于 句子 A 的标记,

- 1 对应于 句子 B 的标记。 什么是标记类型 ID?

- pixel_values (

torch.FloatTensorof shape(batch_size, num_images, num_channels, height, width)) — 像素值。像素值可以使用AutoImageProcessor获取。详情请参见 ViltImageProcessor.call(). - pixel_mask (

torch.LongTensorof shape(batch_size, num_images, height, width), optional) — 用于避免对填充像素值执行注意力操作的掩码。掩码值在[0, 1]中选择:- 1 表示真实的像素(即 未掩码),

- 0 表示填充的像素(即 掩码)。

什么是注意力掩码? <../glossary.html#attention-mask>__

- head_mask (

torch.FloatTensor形状为(num_heads,)或(num_layers, num_heads), 可选) — 用于屏蔽自注意力模块中选定的头部的掩码。掩码值在[0, 1]中选择:- 1 表示头部 未被屏蔽,

- 0 表示头部 被屏蔽.

- inputs_embeds (

torch.FloatTensorof shape({0}, hidden_size), optional) — 可选地,您可以选择直接传递嵌入表示,而不是传递input_ids。如果您希望对如何将input_ids索引转换为相关向量有更多控制,而不是使用模型的内部嵌入查找矩阵,这将非常有用。 - image_embeds (

torch.FloatTensor形状为(batch_size, num_images, num_patches, hidden_size), 可选) — 可选地,您可以选择直接传递嵌入表示,而不是传递pixel_values。 如果您希望对如何将pixel_values转换为补丁嵌入有更多控制,这将非常有用。 - output_attentions (

bool, 可选) — 是否返回所有注意力层的注意力张量。有关更多详细信息,请参见返回张量下的attentions。 - output_hidden_states (

bool, 可选) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量下的hidden_states。 - return_dict (

bool, 可选) — 是否返回一个ModelOutput而不是一个普通的元组。

Vilt 模型转换器,顶部带有分类器头,用于自然语言视觉推理,例如 NLVR2。

前进

< source >( input_ids: typing.Optional[torch.LongTensor] = None attention_mask: typing.Optional[torch.FloatTensor] = None token_type_ids: typing.Optional[torch.LongTensor] = None pixel_values: typing.Optional[torch.FloatTensor] = None pixel_mask: typing.Optional[torch.LongTensor] = None head_mask: typing.Optional[torch.FloatTensor] = None inputs_embeds: typing.Optional[torch.FloatTensor] = None image_embeds: typing.Optional[torch.FloatTensor] = None labels: typing.Optional[torch.LongTensor] = None output_attentions: typing.Optional[bool] = None output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None ) → transformers.models.vilt.modeling_vilt.ViltForImagesAndTextClassificationOutput 或 tuple(torch.FloatTensor)

参数

- input_ids (

torch.LongTensorof shape({0})) — 词汇表中输入序列标记的索引。可以使用AutoTokenizer获取索引。详情请参见 PreTrainedTokenizer.encode() 和 PreTrainedTokenizer.call()。什么是输入ID? - attention_mask (

torch.FloatTensorof shape({0}), optional) — 用于避免在填充标记索引上执行注意力的掩码。掩码值在[0, 1]中选择:- 1 表示 未掩码 的标记,

- 0 表示 掩码 的标记。 什么是注意力掩码?

- token_type_ids (

torch.LongTensorof shape({0}), optional) — 用于指示输入的第一部分和第二部分的段标记索引。索引在[0, 1]中选择:- 0 对应于 句子 A 的标记,

- 1 对应于 句子 B 的标记。 什么是标记类型 ID?

- pixel_values (

torch.FloatTensorof shape(batch_size, num_channels, height, width)) — 像素值。像素值可以使用AutoImageProcessor获取。详情请参见 ViltImageProcessor.call(). - pixel_mask (

torch.LongTensor形状为(batch_size, height, width), 可选) — 用于避免对填充像素值执行注意力的掩码。掩码值在[0, 1]中选择:- 1 表示真实的像素(即 未掩码),

- 0 表示填充的像素(即 掩码)。

什么是注意力掩码? <../glossary.html#attention-mask>__

- head_mask (

torch.FloatTensor形状为(num_heads,)或(num_layers, num_heads), 可选) — 用于屏蔽自注意力模块中选定的头部的掩码。掩码值在[0, 1]中选择:- 1 表示头部 未被屏蔽,

- 0 表示头部 被屏蔽.

- inputs_embeds (

torch.FloatTensorof shape({0}, hidden_size), optional) — 可选地,您可以选择直接传递嵌入表示,而不是传递input_ids。如果您希望对如何将input_ids索引转换为相关向量有更多控制,而不是使用模型的内部嵌入查找矩阵,这将非常有用。 - image_embeds (

torch.FloatTensor形状为(batch_size, num_patches, hidden_size), 可选) — 可选地,您可以选择直接传递嵌入表示,而不是传递pixel_values。 如果您希望对如何将pixel_values转换为补丁嵌入有更多控制,这将非常有用。 - output_attentions (

bool, 可选) — 是否返回所有注意力层的注意力张量。有关更多详细信息,请参见返回张量下的attentions。 - output_hidden_states (

bool, 可选) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量下的hidden_states。 - return_dict (

bool, 可选) — 是否返回一个 ModelOutput 而不是一个普通的元组。 - labels (

torch.LongTensorof shape(batch_size,), optional) — 二分类标签.

返回

transformers.models.vilt.modeling_vilt.ViltForImagesAndTextClassificationOutput 或 tuple(torch.FloatTensor)

一个 transformers.models.vilt.modeling_vilt.ViltForImagesAndTextClassificationOutput 或一个由

torch.FloatTensor 组成的元组(如果传递了 return_dict=False 或当 config.return_dict=False 时),包含各种

元素,具体取决于配置(ViltConfig)和输入。

- loss (

torch.FloatTensor形状为(1,),可选,当提供labels时返回) — 分类(或回归,如果 config.num_labels==1)损失。 - logits (

torch.FloatTensor形状为(batch_size, config.num_labels)) — 分类(或回归,如果 config.num_labels==1)得分(在 SoftMax 之前)。 - hidden_states (

List[tuple(torch.FloatTensor)],可选,当传递output_hidden_states=True或当config.output_hidden_states=True时返回) — 由torch.FloatTensor组成的元组列表(每个图像-文本对一个元组,每个元组包含嵌入的输出 + 每层的输出),形状为(batch_size, sequence_length, hidden_size)。 模型在每层输出处的隐藏状态加上初始嵌入输出。 - attentions (

List[tuple(torch.FloatTensor)],可选,当传递output_attentions=True或当config.output_attentions=True时返回) — 由torch.FloatTensor组成的元组列表(每个图像-文本对一个元组,每个元组包含注意力权重,形状为(batch_size, num_heads, sequence_length, sequence_length)。注意力 softmax 后的注意力权重,用于计算自注意力头中的加权平均值。

ViltForImagesAndTextClassification 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from transformers import ViltProcessor, ViltForImagesAndTextClassification

>>> import requests

>>> from PIL import Image

>>> image1 = Image.open(requests.get("https://lil.nlp.cornell.edu/nlvr/exs/ex0_0.jpg", stream=True).raw)

>>> image2 = Image.open(requests.get("https://lil.nlp.cornell.edu/nlvr/exs/ex0_1.jpg", stream=True).raw)

>>> text = "The left image contains twice the number of dogs as the right image."

>>> processor = ViltProcessor.from_pretrained("dandelin/vilt-b32-finetuned-nlvr2")

>>> model = ViltForImagesAndTextClassification.from_pretrained("dandelin/vilt-b32-finetuned-nlvr2")

>>> # prepare inputs

>>> encoding = processor([image1, image2], text, return_tensors="pt")

>>> # forward pass

>>> outputs = model(input_ids=encoding.input_ids, pixel_values=encoding.pixel_values.unsqueeze(0))

>>> logits = outputs.logits

>>> idx = logits.argmax(-1).item()

>>> print("Predicted answer:", model.config.id2label[idx])

Predicted answer: TrueViltForImageAndTextRetrieval

类 transformers.ViltForImageAndTextRetrieval

< source >( config )

参数

- config (ViltConfig) — 包含模型所有参数的模型配置类。 使用配置文件初始化不会加载与模型相关的权重,只会加载配置。查看 from_pretrained() 方法以加载模型权重。

Vilt 模型转换器,顶部带有分类器头(在 [CLS] 标记的最终隐藏状态之上的线性层),用于图像到文本或文本到图像的检索,例如 MSCOCO 和 F30K。

该模型是一个PyTorch torch.nn.Module _ 子类。将其作为常规的PyTorch模块使用,并参考PyTorch文档以获取与一般使用和行为相关的所有信息。

前进

< source >( input_ids: typing.Optional[torch.LongTensor] = None attention_mask: typing.Optional[torch.FloatTensor] = None token_type_ids: typing.Optional[torch.LongTensor] = None pixel_values: typing.Optional[torch.FloatTensor] = None pixel_mask: typing.Optional[torch.LongTensor] = None head_mask: typing.Optional[torch.FloatTensor] = None inputs_embeds: typing.Optional[torch.FloatTensor] = None image_embeds: typing.Optional[torch.FloatTensor] = None labels: typing.Optional[torch.LongTensor] = None output_attentions: typing.Optional[bool] = None output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None ) → transformers.modeling_outputs.SequenceClassifierOutput 或 tuple(torch.FloatTensor)

参数

- input_ids (

torch.LongTensorof shape({0})) — 词汇表中输入序列标记的索引。可以使用AutoTokenizer获取索引。详情请参见 PreTrainedTokenizer.encode() 和 PreTrainedTokenizer.call()。什么是输入ID? - attention_mask (

torch.FloatTensorof shape({0}), optional) — 用于避免在填充标记索引上执行注意力的掩码。掩码值在[0, 1]中选择:- 1 表示 未掩码 的标记,

- 0 表示 掩码 的标记。 什么是注意力掩码?

- token_type_ids (

torch.LongTensorof shape({0}), 可选) — 用于指示输入的第一部分和第二部分的段标记索引。索引在[0, 1]中选择:- 0 对应于 句子 A 的标记,

- 1 对应于 句子 B 的标记。 什么是标记类型 ID?

- pixel_values (

torch.FloatTensorof shape(batch_size, num_channels, height, width)) — 像素值。像素值可以使用AutoImageProcessor获取。详情请参见 ViltImageProcessor.call(). - pixel_mask (

torch.LongTensorof shape(batch_size, height, width), optional) — 用于避免对填充像素值执行注意力的掩码。掩码值在[0, 1]中选择:- 1 表示真实的像素(即 未掩码),

- 0 表示填充的像素(即 掩码)。

什么是注意力掩码? <../glossary.html#attention-mask>__

- head_mask (

torch.FloatTensor形状为(num_heads,)或(num_layers, num_heads), 可选) — 用于屏蔽自注意力模块中选定的头部的掩码。掩码值在[0, 1]中选择:- 1 表示头部 未被屏蔽,

- 0 表示头部 被屏蔽.

- inputs_embeds (

torch.FloatTensor形状为({0}, hidden_size), 可选) — 可选地,您可以选择直接传递嵌入表示,而不是传递input_ids。如果您希望对如何将input_ids索引转换为相关向量有更多控制,而不是使用模型的内部嵌入查找矩阵,这将非常有用。 - image_embeds (

torch.FloatTensor形状为(batch_size, num_patches, hidden_size), 可选) — 可选地,您可以选择直接传递嵌入表示,而不是传递pixel_values。 如果您希望对如何将pixel_values转换为补丁嵌入有更多控制,这将非常有用。 - output_attentions (

bool, 可选) — 是否返回所有注意力层的注意力张量。有关更多详细信息,请参见返回张量下的attentions。 - output_hidden_states (

bool, 可选) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量下的hidden_states。 - return_dict (

bool, optional) — 是否返回一个ModelOutput而不是一个普通的元组。 - labels (

torch.LongTensorof shape(batch_size,), optional) — 目前不支持标签。

返回

transformers.modeling_outputs.SequenceClassifierOutput 或 tuple(torch.FloatTensor)

一个 transformers.modeling_outputs.SequenceClassifierOutput 或一个由

torch.FloatTensor 组成的元组(如果传递了 return_dict=False 或当 config.return_dict=False 时),包含各种

元素,具体取决于配置(ViltConfig)和输入。

-

loss (

torch.FloatTensor形状为(1,),可选,当提供labels时返回) — 分类(或回归,如果 config.num_labels==1)损失。 -

logits (

torch.FloatTensor形状为(batch_size, config.num_labels)) — 分类(或回归,如果 config.num_labels==1)得分(在 SoftMax 之前)。 -

hidden_states (

tuple(torch.FloatTensor),可选,当传递output_hidden_states=True或当config.output_hidden_states=True时返回) — 由torch.FloatTensor组成的元组(一个用于嵌入层的输出,如果模型有嵌入层,+ 一个用于每一层的输出)形状为(batch_size, sequence_length, hidden_size)。模型在每一层输出处的隐藏状态加上可选的初始嵌入输出。

-

attentions (

tuple(torch.FloatTensor),可选,当传递output_attentions=True或当config.output_attentions=True时返回) — 由torch.FloatTensor组成的元组(每一层一个)形状为(batch_size, num_heads, sequence_length, sequence_length)。注意力 softmax 后的注意力权重,用于计算自注意力头中的加权平均值。

ViltForImageAndTextRetrieval 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。

示例:

>>> from transformers import ViltProcessor, ViltForImageAndTextRetrieval

>>> import requests

>>> from PIL import Image

>>> url = "http://images.cocodataset.org/val2017/000000039769.jpg"

>>> image = Image.open(requests.get(url, stream=True).raw)

>>> texts = ["An image of two cats chilling on a couch", "A football player scoring a goal"]

>>> processor = ViltProcessor.from_pretrained("dandelin/vilt-b32-finetuned-coco")

>>> model = ViltForImageAndTextRetrieval.from_pretrained("dandelin/vilt-b32-finetuned-coco")

>>> # forward pass

>>> scores = dict()

>>> for text in texts:

... # prepare inputs

... encoding = processor(image, text, return_tensors="pt")

... outputs = model(**encoding)

... scores[text] = outputs.logits[0, :].item()ViltForTokenClassification

类 transformers.ViltForTokenClassification

< source >( config )

参数

- config (ViltConfig) — 包含模型所有参数的模型配置类。 使用配置文件初始化不会加载与模型相关的权重,只会加载配置。查看 from_pretrained() 方法以加载模型权重。

ViLT 模型,顶部带有标记分类头(在文本标记的最终隐藏状态之上的线性层),例如用于命名实体识别(NER)任务。

该模型是一个PyTorch torch.nn.Module _ 子类。将其作为常规的PyTorch模块使用,并参考PyTorch文档以获取与一般使用和行为相关的所有信息。

前进

< source >( input_ids: typing.Optional[torch.LongTensor] = None attention_mask: typing.Optional[torch.FloatTensor] = None token_type_ids: typing.Optional[torch.LongTensor] = None pixel_values: typing.Optional[torch.FloatTensor] = None pixel_mask: typing.Optional[torch.LongTensor] = None head_mask: typing.Optional[torch.FloatTensor] = None inputs_embeds: typing.Optional[torch.FloatTensor] = None image_embeds: typing.Optional[torch.FloatTensor] = None labels: typing.Optional[torch.LongTensor] = None output_attentions: typing.Optional[bool] = None output_hidden_states: typing.Optional[bool] = None return_dict: typing.Optional[bool] = None ) → transformers.modeling_outputs.TokenClassifierOutput 或 tuple(torch.FloatTensor)

参数

- input_ids (

torch.LongTensorof shape({0})) — 词汇表中输入序列标记的索引。可以使用AutoTokenizer获取索引。详情请参见 PreTrainedTokenizer.encode() 和 PreTrainedTokenizer.call()。什么是输入ID? - attention_mask (

torch.FloatTensorof shape({0}), optional) — 用于避免在填充标记索引上执行注意力的掩码。掩码值在[0, 1]中选择:- 1 表示 未掩码 的标记,

- 0 表示 掩码 的标记。 什么是注意力掩码?

- token_type_ids (

torch.LongTensorof shape({0}), optional) — 用于指示输入的第一部分和第二部分的段标记索引。索引在[0, 1]中选择:- 0 对应于 句子 A 的标记,

- 1 对应于 句子 B 的标记。 什么是标记类型 ID?

- pixel_values (

torch.FloatTensorof shape(batch_size, num_channels, height, width)) — 像素值。像素值可以使用AutoImageProcessor获取。详情请参见 ViltImageProcessor.call(). - pixel_mask (

torch.LongTensor形状为(batch_size, height, width), 可选) — 用于避免对填充像素值执行注意力操作的掩码。掩码值在[0, 1]中选择:- 1 表示真实的像素(即 未掩码),

- 0 表示填充的像素(即 掩码)。

什么是注意力掩码? <../glossary.html#attention-mask>__

- head_mask (

torch.FloatTensor形状为(num_heads,)或(num_layers, num_heads), 可选) — 用于屏蔽自注意力模块中选定的头部的掩码。掩码值在[0, 1]中选择:- 1 表示头部 未被屏蔽,

- 0 表示头部 被屏蔽.

- inputs_embeds (

torch.FloatTensorof shape({0}, hidden_size), optional) — 可选地,您可以选择直接传递嵌入表示,而不是传递input_ids。如果您希望对如何将input_ids索引转换为相关向量有更多控制,而不是使用模型的内部嵌入查找矩阵,这将非常有用。 - image_embeds (

torch.FloatTensorof shape(batch_size, num_patches, hidden_size), optional) — 可选地,您可以选择直接传递嵌入表示,而不是传递pixel_values。 如果您希望对如何将pixel_values转换为补丁嵌入有更多控制,这将非常有用。 - output_attentions (

bool, 可选) — 是否返回所有注意力层的注意力张量。有关更多详细信息,请参见返回张量中的attentions。 - output_hidden_states (

bool, 可选) — 是否返回所有层的隐藏状态。有关更多详细信息,请参见返回张量下的hidden_states。 - return_dict (

bool, 可选) — 是否返回一个 ModelOutput 而不是一个普通的元组。 - labels (

torch.LongTensorof shape(batch_size, text_sequence_length), optional) — 用于计算标记分类损失的标签。索引应在[0, ..., config.num_labels - 1]范围内。

返回

transformers.modeling_outputs.TokenClassifierOutput 或 tuple(torch.FloatTensor)

一个 transformers.modeling_outputs.TokenClassifierOutput 或一个由

torch.FloatTensor 组成的元组(如果传递了 return_dict=False 或当 config.return_dict=False 时),包含各种

元素,具体取决于配置(ViltConfig)和输入。

-

loss (

torch.FloatTensor形状为(1,), 可选, 当提供labels时返回) — 分类损失。 -

logits (

torch.FloatTensor形状为(batch_size, sequence_length, config.num_labels)) — 分类分数(在 SoftMax 之前)。 -

hidden_states (

tuple(torch.FloatTensor), 可选, 当传递output_hidden_states=True或当config.output_hidden_states=True时返回) — 由torch.FloatTensor组成的元组(一个用于嵌入层的输出,如果模型有嵌入层,+ 一个用于每一层的输出)形状为(batch_size, sequence_length, hidden_size)。模型在每一层输出处的隐藏状态加上可选的初始嵌入输出。

-

attentions (

tuple(torch.FloatTensor), 可选, 当传递output_attentions=True或当config.output_attentions=True时返回) — 由torch.FloatTensor组成的元组(每一层一个)形状为(batch_size, num_heads, sequence_length, sequence_length)。注意力 softmax 后的注意力权重,用于计算自注意力头中的加权平均值。

ViltForTokenClassification 的前向方法,重写了 __call__ 特殊方法。

尽管前向传递的配方需要在此函数内定义,但之后应该调用Module实例而不是这个,因为前者负责运行预处理和后处理步骤,而后者会默默地忽略它们。